A Cerebras Systems, startup que se tornou um dos nomes mais observados no ecossistema de hardware para inteligência artificial, deu um passo decisivo em sua trajetória ao buscar captar até US$ 3,5 bilhões em uma oferta pública inicial (IPO) nos Estados Unidos. Segundo reportagem da Bloomberg, o movimento ocorre em um momento de intensa pressão competitiva, onde a empresa tenta converter sua tecnologia proprietária de chips de escala wafer em uma alternativa escalável e eficiente frente ao domínio absoluto da Nvidia.

Este IPO não é apenas uma busca por capital, mas um teste de mercado sobre a viabilidade de arquiteturas de computação que divergem do modelo tradicional de GPUs. Enquanto o setor de semicondutores vive uma corrida sem precedentes por capacidade de processamento, a Cerebras tenta provar que seu design — que utiliza wafers inteiros de silício em vez de chips individuais interconectados — oferece vantagens de latência e eficiência energética cruciais para o treinamento de modelos de linguagem de grande porte, os chamados LLMs.

A arquitetura wafer-scale como diferencial competitivo

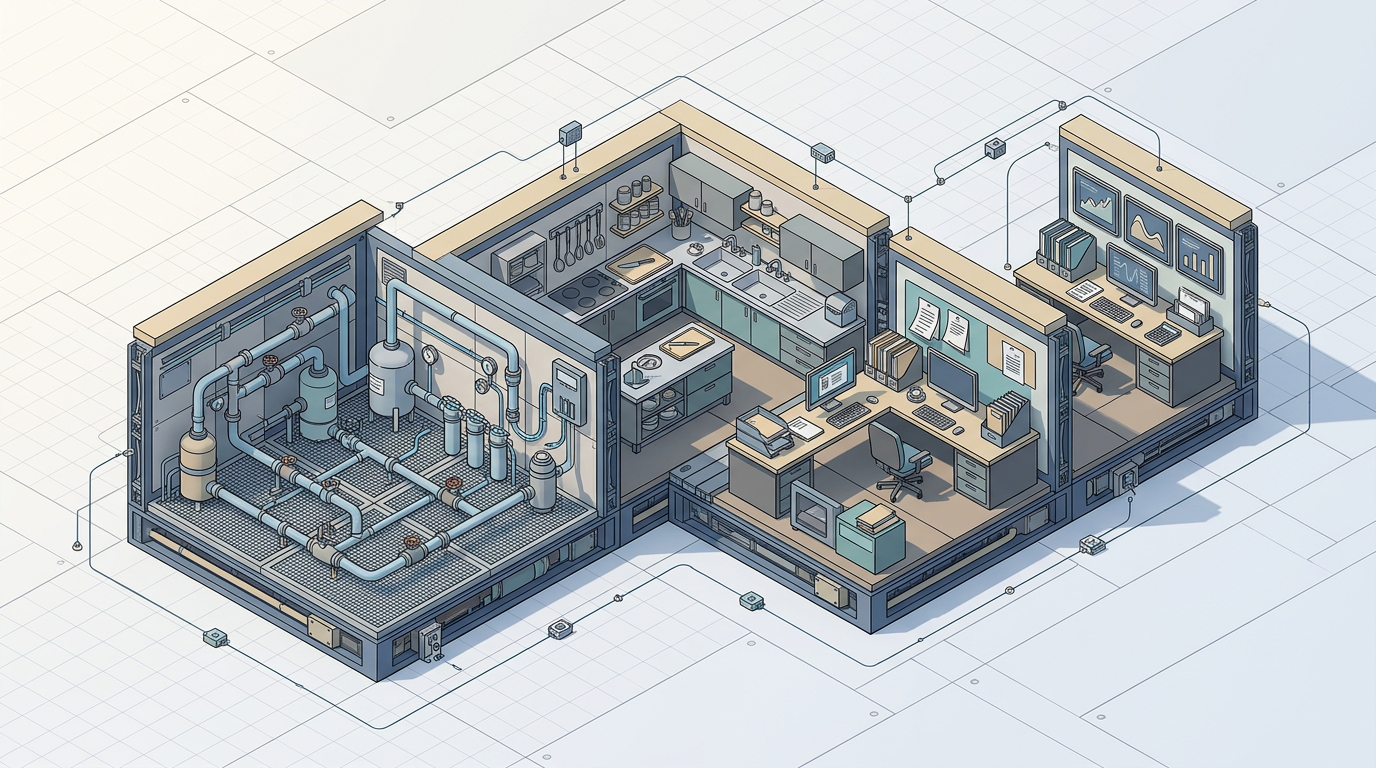

A proposta central da Cerebras reside na sua unidade de processamento wafer-scale (WSE). Ao contrário da indústria convencional, que corta o wafer em centenas de pequenos chips, a Cerebras mantém o wafer de silício quase intacto, criando um processador gigantesco com milhões de núcleos otimizados para IA. Essa abordagem técnica visa resolver o principal gargalo da computação moderna: a movimentação de dados entre chips distintos, um processo que consome energia e tempo em data centers massivos.

Historicamente, a complexidade de fabricar e resfriar componentes desse tamanho impedia que essa tecnologia saísse dos laboratórios de pesquisa. A Cerebras, contudo, investiu pesadamente em engenharia de software e hardware para tornar essa arquitetura não apenas funcional, mas comercialmente viável. O sucesso da empresa depende da capacidade de demonstrar que essa infraestrutura pode ser integrada em data centers de hiperescala sem exigir uma reconfiguração completa das pilhas de software já otimizadas para o ecossistema CUDA da Nvidia.

O dilema do ecossistema e a barreira da Nvidia

A competição no mercado de chips para IA não se resume apenas ao hardware ou à capacidade bruta de processamento. A Nvidia, por meio da plataforma CUDA, construiu um fosso competitivo profundo que vai muito além dos seus chips H100 ou Blackwell. Desenvolvedores e engenheiros de IA ao redor do mundo foram treinados para otimizar seus modelos dentro desse ambiente, tornando a migração para qualquer arquitetura concorrente um custo operacional e de tempo significativo para as empresas.

Para a Cerebras, o desafio é convencer os grandes provedores de nuvem e laboratórios de pesquisa de que o ganho de performance justifica o esforço de adaptação. A empresa tem buscado parcerias estratégicas para oferecer seus processadores como serviço, contornando a necessidade de venda direta de hardware para clientes que não possuem a capacidade de infraestrutura para operar sistemas de escala wafer. A estratégia é clara: tornar a arquitetura da Cerebras uma commodity de alto desempenho, acessível via nuvem, para diminuir a fricção de adoção por parte dos desenvolvedores.

Implicações para o mercado e stakeholders

O IPO da Cerebras sinaliza um momento de maturação para o setor de hardware de IA, que começa a se dividir entre os líderes estabelecidos e os desafiantes com arquiteturas especializadas. Reguladores e investidores de venture capital observam atentamente, pois o sucesso de uma oferta dessa magnitude pode abrir as portas para uma nova onda de financiamento para empresas de semicondutores que focam em nichos de performance, desafiando a consolidação do mercado sob poucas empresas gigantes.

Para o ecossistema brasileiro de tecnologia, que ainda carece de infraestrutura própria de computação de alta performance, a democratização ou a diversificação das opções de chips de IA é um tema de interesse estratégico. A possibilidade de acessar tecnologias alternativas via nuvem pode, em tese, reduzir a dependência de fornecedores únicos e permitir que startups locais treinem modelos complexos com custos mais competitivos, embora a viabilidade econômica dessa transição dependa de uma série de fatores logísticos e de conectividade que ainda estão em desenvolvimento.

Perspectivas e incertezas no horizonte

A questão central que permanece é se a Cerebras conseguirá escalar a produção de seus wafers de forma consistente e com margens que atraiam investidores de longo prazo. O mercado de capitais tem sido volátil em relação a empresas de tecnologia que demandam alto dispêndio de capital (CapEx) antes de atingir uma escala que justifique a lucratividade. O sucesso da empresa dependerá de sua capacidade de manter o ritmo de inovação sem queimar o caixa antes de estabelecer uma base de clientes recorrentes.

Além disso, o cenário macroeconômico de juros e a disposição dos investidores em financiar o desenvolvimento de hardware de ponta serão determinantes. Acompanhar a adoção dos sistemas de segunda e terceira geração da Cerebras nos próximos trimestres oferecerá uma métrica clara sobre a eficácia da arquitetura wafer-scale frente à evolução constante das GPUs da Nvidia, que continuam a estabelecer o padrão de performance para o mercado global.

O mercado de semicondutores para IA está entrando em uma fase de maior complexidade técnica, onde a eficiência na movimentação de dados se torna tão importante quanto a velocidade de processamento individual. A Cerebras aposta que sua solução de escala wafer é o caminho para o futuro da computação, mas a transição dependerá de uma combinação de aceitação de mercado, suporte de software e, acima de tudo, resiliência financeira frente aos incumbentes.

Com reportagem de Bloomberg

Source · Bloomberg — Technology