A DeepInfra, plataforma especializada em infraestrutura de inferência para inteligência artificial, anunciou o fechamento de uma rodada de financiamento Série B no valor de US$ 107 milhões. O aporte, que conta com a participação estratégica da Nvidia e da Samsung, sublinha o crescente interesse do mercado em soluções que prometem otimizar a execução de modelos de linguagem e outras aplicações de IA generativa em escala. A notícia, reportada pela Bloomberg, destaca como o ecossistema tecnológico está redirecionando o capital para resolver os gargalos operacionais que surgem após o treinamento massivo de modelos.

O movimento da Nvidia não é apenas um investimento financeiro, mas um alinhamento tático fundamental. Enquanto a empresa consolidou sua hegemonia no fornecimento de unidades de processamento gráfico (GPUs) para o treinamento de modelos, a fase de inferência — o momento em que a IA efetivamente responde a consultas — tornou-se o novo campo de batalha. Ao apoiar a DeepInfra, a Nvidia busca garantir que sua arquitetura de hardware seja suportada por camadas de software capazes de maximizar a eficiência e reduzir a latência, elementos cruciais para a adoção comercial em larga escala de serviços baseados em modelos complexos.

O gargalo da inferência e a mudança de paradigma

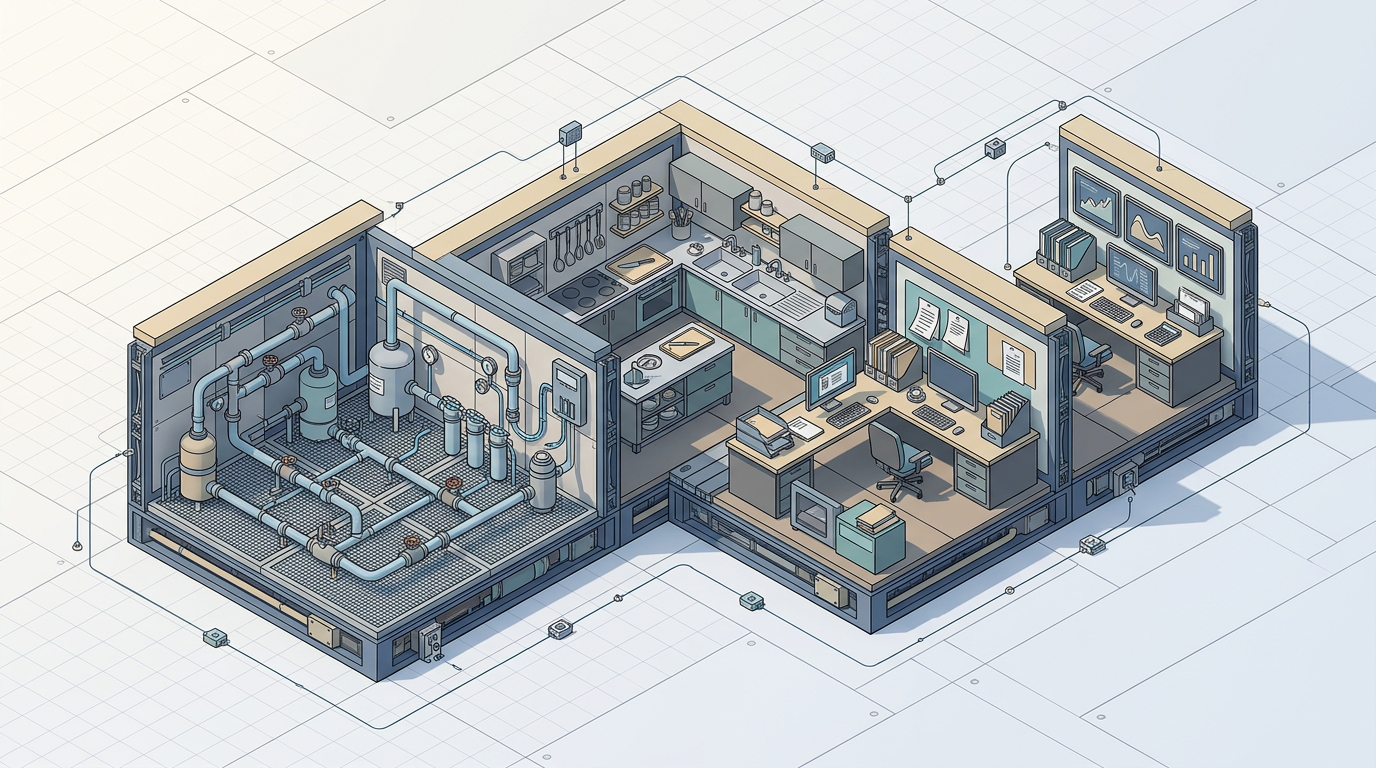

A indústria de inteligência artificial atravessa uma transição estrutural clara. Durante os últimos anos, a narrativa foi dominada pela capacidade computacional necessária para treinar modelos cada vez maiores, um processo que consome recursos massivos e exige investimentos bilionários em hardware. Contudo, à medida que a tecnologia migra da fase experimental para a implementação corporativa, o foco desloca-se para a inferência: a capacidade de executar esses modelos de forma rápida, barata e confiável. É aqui que empresas como a DeepInfra encontram seu valor, atuando como uma camada de abstração que permite às companhias acessar poder computacional de forma otimizada.

A complexidade técnica da inferência reside na necessidade de equilibrar custos operacionais com a performance exigida pelo usuário final. Sem uma camada de infraestrutura eficiente, o custo de manter modelos robustos em produção torna-se proibitivo para a maioria das empresas. A DeepInfra propõe uma solução que visa democratizar o acesso a essa computação, permitindo que desenvolvedores ignorem a complexidade da gestão de hardware e foquem na aplicação. Esse modelo de negócio, muitas vezes referido como 'serverless' para IA, é o que atrai investidores como a Nvidia e a Samsung, que veem na eficiência da ponta a chave para a sustentabilidade do ecossistema de IA.

A estratégia da Nvidia no controle da cadeia de valor

Para a Nvidia, o investimento na DeepInfra é um movimento de defesa e expansão de mercado. Ao financiar plataformas que facilitam a adoção de seus chips em ambientes de produção, a empresa assegura que o software que roda sobre seu hardware seja o mais eficiente possível. Isso cria um ciclo virtuoso: quanto melhor a performance da inferência, maior a demanda por mais modelos e, consequentemente, por mais chips da Nvidia. A empresa está, na prática, verticalizando sua influência, garantindo que a experiência do desenvolvedor seja indissociável de seu ecossistema de hardware.

Além disso, a presença de investidores como a Samsung indica uma preocupação com a diversificação da cadeia de suprimentos e com a integração de hardware especializado. O setor de semicondutores e infraestrutura em nuvem está se tornando cada vez mais interdependente. A capacidade de processar dados em tempo real, com baixo consumo de energia e alta precisão, é o que diferenciará as plataformas de IA que sobreviverão à consolidação do mercado. A Nvidia, ao posicionar-se como o motor por trás de várias dessas inovações, mantém sua posição central, mesmo que a competição em chips de inferência comece a se intensificar com a entrada de novos players e soluções customizadas.

Implicações para o mercado e stakeholders

Para os desenvolvedores e empresas que utilizam IA, essa movimentação sugere uma redução gradual na barreira de entrada para o uso de modelos de ponta. A padronização da infraestrutura de inferência, promovida por rodadas de financiamento como a da DeepInfra, tende a reduzir os custos marginais de operação, permitindo que startups e corporações brasileiras, por exemplo, acessem tecnologias que antes exigiam equipes de engenharia de infraestrutura altamente especializadas. A democratização da computação de IA é um passo essencial para que o Brasil consiga integrar soluções de inteligência artificial em setores tradicionais, como agricultura e serviços financeiros, com maior agilidade.

Contudo, a centralização de poder em torno de poucas empresas que controlam tanto o hardware quanto as camadas de infraestrutura de software levanta questões sobre soberania tecnológica e dependência. Reguladores globais e locais devem observar se esse movimento de verticalização cria barreiras anticompetitivas, onde apenas aqueles que utilizam o ecossistema da Nvidia conseguem atingir a eficiência necessária para competir. Para o mercado brasileiro, o desafio é equilibrar a adoção dessas tecnologias de ponta com o desenvolvimento de capacidades locais que não dependam exclusivamente de um único fornecedor global de infraestrutura.

Perspectivas e o futuro da computação em nuvem

O que permanece incerto é como a arquitetura de inferência evoluirá diante de inovações como a computação de borda, ou 'edge computing', onde o processamento ocorre mais próximo ao usuário. Se a tendência de descentralização do processamento ganhar força, plataformas como a DeepInfra precisarão adaptar-se para gerir recursos de forma ainda mais distribuída, o que pode alterar a dinâmica atual de investimento em grandes centros de dados centralizados.

Também será fundamental observar se a eficiência prometida pela otimização de software conseguirá acompanhar o crescimento exponencial da demanda por inferência. A história da computação sugere que, à medida que o custo de processamento cai, a demanda por novas aplicações tende a explodir, o que pode manter a pressão sobre a infraestrutura em níveis elevados por um longo período. O setor de IA entra agora em uma fase de maturação onde a eficiência operacional será tão valorizada quanto a inovação algorítmica, e o sucesso da DeepInfra será um termômetro dessa nova realidade.

A corrida pela eficiência na inferência é apenas o início de uma reconfiguração mais ampla sobre como a inteligência artificial será entregue e consumida globalmente. À medida que as empresas buscam converter o hype em valor financeiro tangível, a infraestrutura que sustenta essa transição tornar-se-á o ativo mais crítico de todo o ecossistema tecnológico, ditando quem lidera e quem apenas observa a próxima onda de transformação digital.

Com reportagem de Bloomberg

Source · Bloomberg — Technology