A onipresença das plataformas digitais na vida cotidiana não é um fenômeno neutro, mas sim o resultado de uma engenharia comportamental deliberada. Segundo reportagem publicada pela The Economist, a capacidade das grandes empresas de tecnologia em direcionar o comportamento dos usuários atingiu um ponto de inflexão, onde a conveniência do serviço frequentemente se confunde com uma restrição sutil, porém eficaz, da autonomia individual. O debate, que ganha força nos círculos regulatórios globais, questiona se o design das interfaces e a lógica dos algoritmos de recomendação estão servindo aos interesses dos usuários ou, fundamentalmente, aos imperativos de engajamento e monetização das corporações.

Esta discussão não é nova, mas ganha contornos de urgência à medida que a integração entre Inteligência Artificial e análise de dados comportamentais se torna mais profunda. A tese central é que o modelo de negócios baseado na economia da atenção cria incentivos perversos para que as plataformas explorem vulnerabilidades cognitivas, conduzindo os usuários a decisões que, sob reflexão, eles provavelmente não tomariam. A questão, portanto, transcende a mera privacidade de dados e toca no cerne da agência humana em um ecossistema digital projetado para ser, em última análise, preditivo e persuasivo.

A economia da atenção e o design de escolha

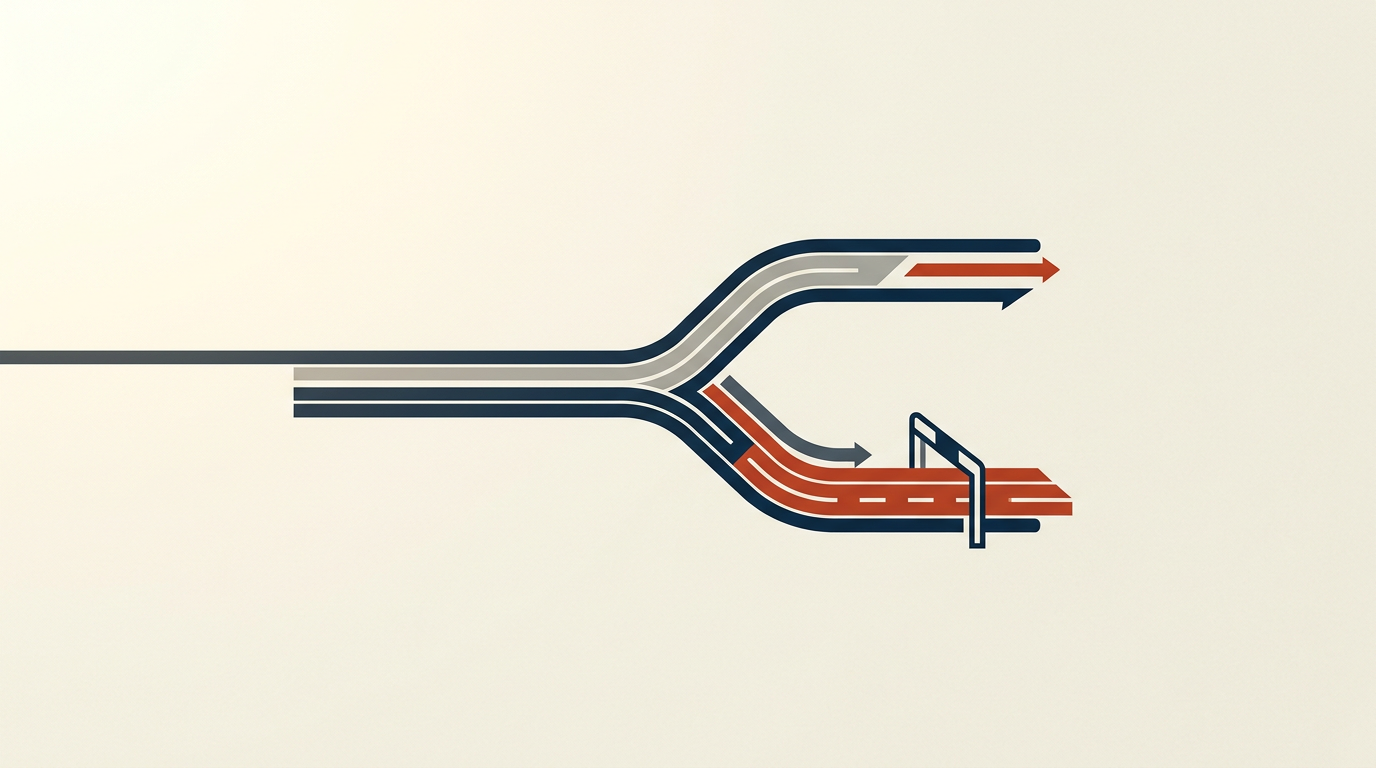

Historicamente, o design de interfaces sempre buscou facilitar o uso, mas a evolução para o que se convencionou chamar de "arquitetura de escolha" alterou o equilíbrio de poder. Ao organizar as informações de maneira a guiar o usuário para caminhos específicos, as plataformas exercem um controle que muitas vezes é invisível. Esse fenômeno é potencializado por algoritmos que aprendem não apenas o que o usuário gosta, mas como ele reage a estímulos específicos, criando um ciclo de retroalimentação que reforça padrões de comportamento muitas vezes prejudiciais ao bem-estar do indivíduo.

O problema estrutural reside no desalinhamento de incentivos. Enquanto o usuário busca utilidade, informação ou entretenimento, a plataforma busca maximizar o tempo de permanência e a coleta de dados para alimentar modelos publicitários. Essa divergência de objetivos não é um erro do sistema, mas uma característica fundamental do modelo de negócios dominante. Quando o design é otimizado para a retenção, a autonomia do usuário torna-se um custo a ser minimizado em favor da eficiência operacional da plataforma.

Mecanismos de influência algorítmica

O funcionamento dessa influência baseia-se em mecanismos de reforço positivo e na exploração de vieses cognitivos. Técnicas como o scroll infinito, notificações otimizadas e sistemas de recomendação que priorizam conteúdo de alta carga emocional são ferramentas de precisão para manter o usuário engajado. Não se trata apenas de oferecer o que o usuário deseja, mas de moldar o desejo do usuário através de um fluxo constante de estímulos que contornam o pensamento crítico e ativam sistemas de resposta automática.

Empiricamente, observamos que essa dinâmica cria um ambiente onde a escolha livre é severamente limitada pelo que o algoritmo decide exibir. A personalização excessiva, embora pareça um benefício, pode confinar o usuário em bolhas informacionais que reforçam preconceitos e diminuem a exposição a perspectivas divergentes. O mecanismo é, portanto, de fechamento: a plataforma conhece o usuário melhor do que ele mesmo, e utiliza esse conhecimento para fechar o leque de possibilidades, tornando a navegação previsível e altamente lucrativa para quem detém o controle dos dados.

Implicações para o ecossistema e regulação

Para os reguladores, o desafio é complexo: como proteger a autonomia individual sem sufocar a inovação ou criar uma burocracia que impeça o funcionamento de serviços digitais essenciais? A resposta tem passado pela exigência de maior transparência algorítmica e pelo fortalecimento de direitos de portabilidade de dados. No entanto, essas medidas, embora necessárias, podem ser insuficientes se não atacarem a raiz do problema: a estrutura de incentivos que torna a manipulação comportamental a estratégia mais rentável para as grandes empresas de tecnologia.

No Brasil, este debate ressoa com força, especialmente dada a alta penetração de redes sociais e plataformas digitais na população. A necessidade de uma regulação que considere não apenas o conteúdo, mas a arquitetura das plataformas, coloca em xeque a atuação das Big Techs no país. Concorrentes menores, que operam com modelos de negócios diferentes, encontram dificuldade em competir em um mercado onde a retenção baseada em manipulação algorítmica define as regras do jogo. A tensão entre o direito à inovação e a proteção da esfera cognitiva do cidadão será um dos pilares das discussões legislativas nos próximos anos.

O horizonte de incertezas e a responsabilidade

O que permanece incerto é a capacidade das instituições em acompanhar a velocidade da evolução tecnológica. À medida que novas interfaces, como a realidade aumentada e a integração de assistentes de IA, se tornam mais comuns, a fronteira entre a sugestão algorítmica e a manipulação direta tende a se tornar ainda mais tênue. A questão fundamental é se a sociedade será capaz de definir limites éticos para a engenharia comportamental ou se a dependência tecnológica tornará qualquer tentativa de regulação tardia.

Deve-se observar, nos próximos anos, como as empresas de tecnologia reagirão às pressões regulatórias. Algumas podem optar por um modelo de "design ético" como diferencial competitivo, enquanto outras buscarão formas mais sofisticadas e menos detectáveis de influência. A vigilância sobre o impacto dessas tecnologias não deve ser apenas estatal, mas também acadêmica e civil, garantindo que o desenvolvimento tecnológico não ocorra à custa da erosão da capacidade de escolha do indivíduo.

A tecnologia, em sua essência, deveria servir como uma ferramenta de expansão das capacidades humanas, não como um mecanismo de redução da nossa autonomia. O debate atual não é uma cruzada contra a inovação, mas um chamado para que o design digital seja submetido a princípios éticos que respeitem a integridade das decisões humanas, garantindo que o futuro digital seja um ambiente de liberdade, e não de confinamento comportamental.

Com reportagem de The Economist

Source · Hacker News