A ascensão da inteligência artificial não apenas altera a produtividade econômica ou a eficiência operacional; ela atinge o cerne da própria definição de quem somos enquanto agentes morais. Durante séculos, a tradição ocidental consolidou a ideia de que a autonomia é uma faculdade intrínseca do ser humano: a capacidade de um indivíduo racional de legislar sobre si mesmo, livre de influências externas. Contudo, essa visão, que remonta a Immanuel Kant e fundamenta grande parte da arquitetura jurídica e ética das democracias liberais, parece cada vez mais desconectada da realidade de uma ecologia cognitiva onde humanos e máquinas coevoluem em simbiose.

Segundo reportagem da Noema Magazine, o desafio contemporâneo exige que abandonemos a fantasia da soberania absoluta do "eu" em favor de uma compreensão da autonomia como um processo contínuo, frágil e profundamente dependente do ambiente em que estamos inseridos. Ao reconhecer que nossas escolhas não ocorrem em um vácuo, mas em cenários desenhados por algoritmos, passamos a entender que a preservação da autonomia não depende apenas da proteção de direitos individuais, mas da governança das condições estruturais que moldam o comportamento humano.

A ilusão da soberania individual

O conceito moderno de autonomia está enraizado na ideia de um "eu" independente, capaz de agir conforme razões próprias. No entanto, a neurociência e a psicologia experimental têm sistematicamente desafiado essa premissa. Experimentos clássicos, como os de Benjamin Libet, sugerem que o cérebro inicia processos de decisão antes mesmo que a consciência tome conhecimento da intenção de agir. Essas evidências não invalidam a agência humana, mas revelam que a nossa sensação de autoria é frequentemente uma narrativa construída a posteriori para explicar ações que já haviam sido desencadeadas por processos subconscientes.

Além disso, críticos como Michel Sandel e teóricas feministas, como Carol Gilligan, apontaram que a visão do "sujeito desimpedido" — aquele que existe independentemente de laços sociais ou contextos — é uma ficção que negligencia nossa natureza relacional. Ao tratar a autonomia como uma característica fixa e interna, ignoramos que nossa capacidade de self-mastery é, na verdade, moldada por um substrato cognitivo estendido. A autonomia, portanto, não é um estado de independência absoluta, mas uma propriedade emergente que flutua conforme as variáveis do ambiente e as interações com outros agentes, sejam eles humanos ou máquinas.

O mecanismo da influência algorítmica

Na era da inteligência artificial, a autonomia é desafiada por sistemas que operam abaixo do limiar da percepção consciente. A prática do "hypernudging", descrita por especialistas como Karen Yeung, exemplifica como o ecossistema digital atual utiliza perfis preditivos e dados em tempo real para moldar escolhas. Diferente de uma persuasão clássica, que apela à deliberação, esses sistemas visam o Sistema 1 de Kahneman — o modo de pensamento rápido, associativo e automático —, induzindo comportamentos antes que a reflexão deliberada possa intervir.

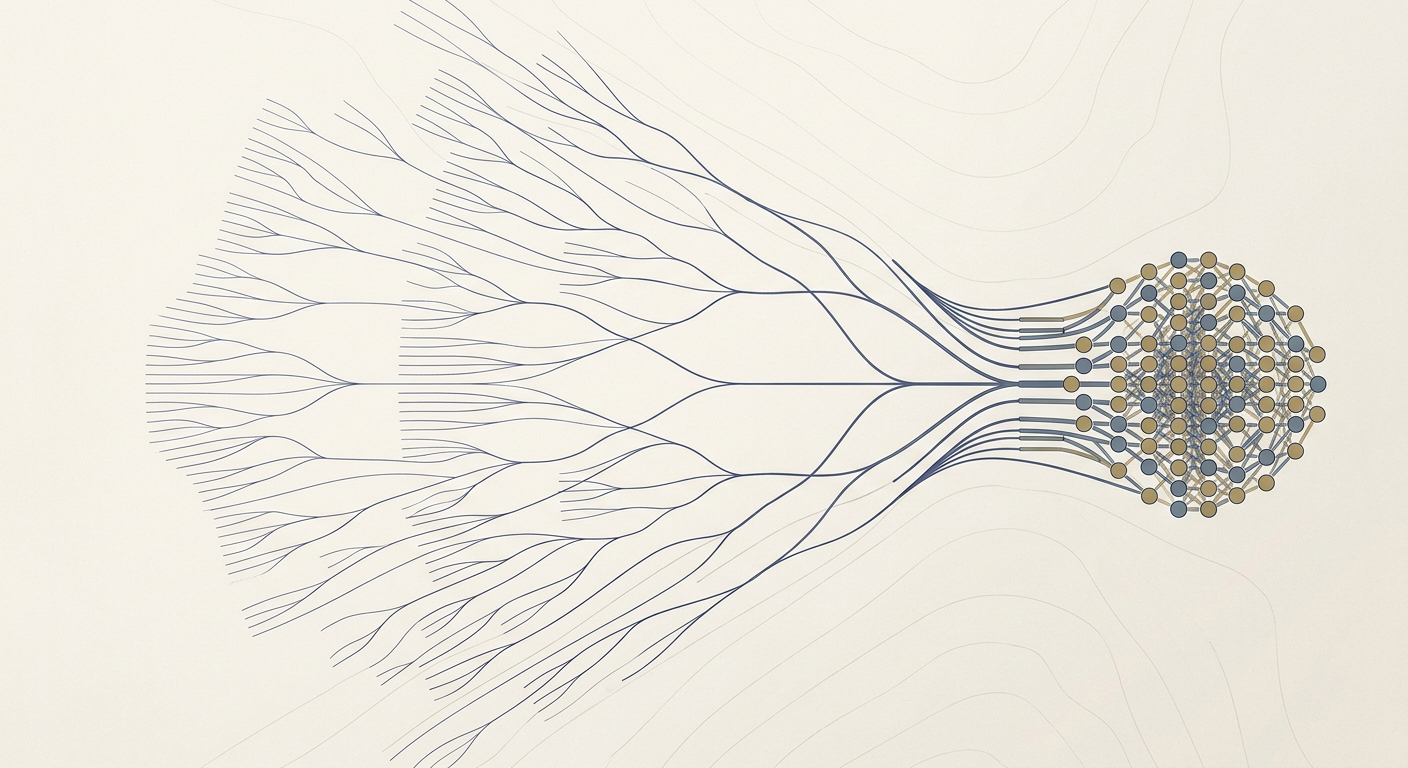

O perigo reside na invisibilidade dessa influência. Quando algoritmos de recomendação organizam o fluxo de informações, eles não apenas preveem preferências, mas as roteirizam. Esse processo de "gamificação da especificação" otimiza metas de engajamento que podem entrar em conflito direto com o desenvolvimento cognitivo humano. A tecnologia, neste contexto, deixa de ser um acessório e se torna uma parte integrante do processo de autopoiesis — o mecanismo de auto-organização biológica descrito por Francisco Varela — que define nossa identidade. Ao nos tornarmos parte de um sistema circular de feedback com a máquina, perdemos a clareza sobre onde termina a nossa agência e onde começa o design algorítmico.

Implicações para o ecossistema normativo

Para o ecossistema brasileiro de tecnologia e regulação, essa mudança de paradigma é fundamental. Se a autonomia é "ambientalmente estruturada", a proteção do cidadão não pode se limitar a leis de privacidade de dados ou consentimento informado, que pressupõem um usuário plenamente capaz de discernir riscos em tempo real. O debate precisa evoluir para a regulação dos ambientes de escolha e a transparência sobre os mecanismos de influência que operam nos bastidores de plataformas digitais.

Para os desenvolvedores e empresas de tecnologia, isso impõe uma responsabilidade ética que vai além da conformidade técnica. O desafio é projetar sistemas que não apenas maximizem métricas de curto prazo, mas que respeitem a integridade do processo de deliberação humana. Reguladores, por sua vez, devem considerar que a autonomia é um "ideal regulativo" necessário para a democracia, exigindo que as instituições sejam desenhadas como se os indivíduos fossem autônomos, mesmo quando reconhecemos que essa autonomia é, em última análise, uma conquista a ser defendida, não um dado absoluto da natureza.

Perspectivas e incertezas

A questão que permanece em aberto é se estamos dispostos a reformular nossas estruturas jurídicas para acomodar essa visão de um sujeito "poroso". A transição de uma autonomia baseada em direitos individuais abstratos para uma autonomia baseada na integridade do ambiente cognitivo exigirá uma nova linguagem política. O que observaremos nos próximos anos será o embate entre a conveniência da automação e a necessidade de preservar espaços de não-interferência algorítmica, essenciais para a manutenção da nossa própria humanidade.

Ainda não sabemos se a tecnologia servirá como um "pharmakon" — remédio e veneno simultâneos — ou se a balança penderá definitivamente para o controle. A resposta dependerá da nossa capacidade de integrar a compreensão da nossa fragilidade biológica com a sofisticação da nossa inovação técnica, garantindo que o progresso tecnológico não signifique a erosão silenciosa da nossa capacidade de ser, verdadeiramente, autores de nossas próprias vidas.

O debate sobre a autonomia não está encerrado; ele está apenas começando a ser traduzido da filosofia para a prática do design e da regulação. A complexidade dessa transição sugere que a solução não virá de definições estáticas, mas de uma vigilância constante sobre como as ferramentas que construímos moldam, dia após dia, a nossa própria estrutura de pensamento.

Com reportagem de Noema Magazine

Source · Noema Magazine