A integração de capacidades de geração de imagens diretamente nos grandes modelos de linguagem (LLMs) tornou-se a nova fronteira na disputa pela produtividade digital. Recentemente, a OpenAI aprimorou as ferramentas visuais dentro do ChatGPT, enquanto o Google continua a refinar a performance do Gemini. Esta evolução não é apenas uma questão de fidelidade estética, mas de como esses sistemas interpretam intenções complexas e as traduzem em ativos visuais úteis para o cotidiano corporativo.

Segundo reportagem do t3n, a experiência de uso revela que a escolha entre as duas plataformas não é óbvia. Enquanto o ChatGPT tem se destacado pela capacidade de seguir instruções detalhadas e oferecer templates de design, o Gemini apresenta vantagens em contextos específicos de integração com o ecossistema Google. A análise editorial sugere que, para o profissional que busca eficiência, a escolha da ferramenta deve estar ancorada na natureza do projeto e na necessidade de refinamento posterior.

A evolução da interface multimodal

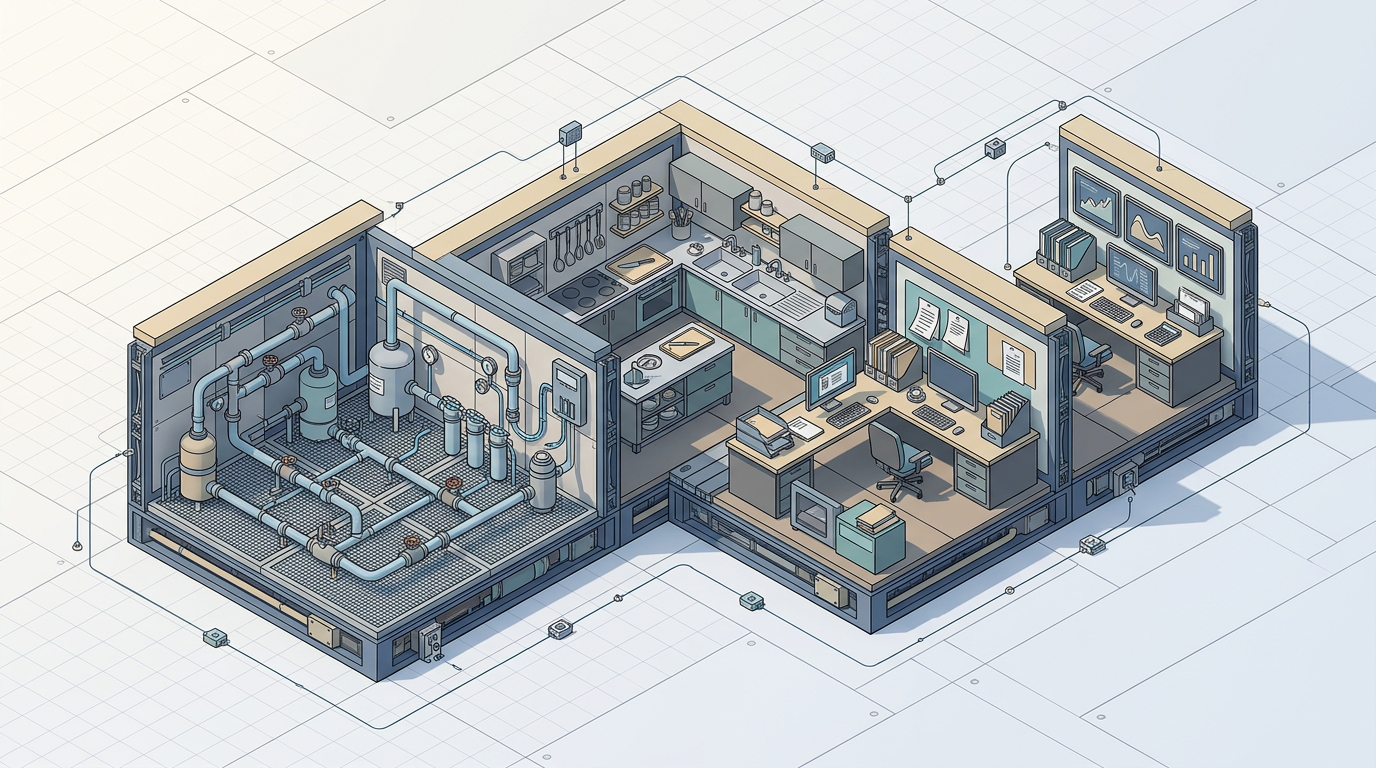

A transição dos LLMs puros para modelos multimodais nativos alterou drasticamente a forma como interagimos com a IA generativa. Historicamente, a geração de imagens era um domínio isolado, restrito a ferramentas especializadas que exigiam conhecimento técnico em engenharia de prompts. Com a incorporação dessas capacidades ao ChatGPT e ao Gemini, a barreira de entrada foi reduzida, permitindo que usuários não técnicos integrem imagens em seus fluxos de trabalho de texto sem a necessidade de alternar entre diferentes softwares.

Essa convergência levanta questões sobre a especialização versus a generalização. Embora modelos dedicados ainda possam oferecer maior controle sobre parâmetros técnicos, a conveniência de ter uma IA que compreende o contexto de um documento e gera a imagem correspondente é um diferencial competitivo inegável. A capacidade de iterar sobre o resultado, mantendo o histórico da conversa, transforma a geração de imagens de um evento único em um processo contínuo de design assistido.

Mecanismos de interpretação e fidelidade

O cerne da diferença entre ChatGPT e Gemini reside na forma como cada motor processa a linguagem natural para construir a imagem. O ChatGPT, ao utilizar modelos como o DALL-E, demonstra uma habilidade superior em seguir instruções complexas e manter a consistência estilística quando solicitado. Isso se torna evidente em testes de usabilidade, onde a capacidade de ajustar detalhes específicos após a primeira geração é superior, permitindo um refinamento que se aproxima de um processo de design real.

Por outro lado, o Gemini, alavancado pela infraestrutura do Google, tende a ser mais ágil em contextos que exigem integração com dados em tempo real ou busca de referências externas. A arquitetura do Google prioriza a velocidade e a contextualização, o que pode ser preferível em cenários de criação rápida de conteúdo para mídias digitais. No entanto, a precisão na renderização de elementos complexos, como texto dentro de imagens ou composições anatômicas, ainda varia significativamente entre os dois, exigindo que o usuário compreenda as limitações intrínsecas de cada arquitetura.

Stakeholders e o impacto no mercado

Para o mercado brasileiro, que tem adotado ferramentas de IA com alta velocidade, essa disputa impacta diretamente desde agências de publicidade até pequenas empresas que buscam otimizar custos de produção criativa. Reguladores e especialistas em direitos autorais observam com atenção como essas ferramentas lidam com a procedência dos dados de treinamento, uma preocupação que transcende a eficácia técnica da geração de imagens. Para os concorrentes, o desafio é manter a relevância em um ecossistema onde a integração é o principal valor agregado.

Os consumidores, por sua vez, beneficiam-se da redução de custos e do tempo de entrega de projetos visuais. No entanto, existe uma tensão latente sobre a padronização estética. À medida que essas ferramentas se tornam onipresentes, o risco de uma homogeneização visual cresce, forçando profissionais criativos a buscarem diferenciação através de curadoria e intervenção humana, e não apenas pela capacidade de gerar imagens a partir de comandos de texto.

O futuro da criação assistida

O que permanece incerto é a direção da próxima onda de inovações. Será que veremos uma especialização ainda maior, onde modelos de linguagem se tornarão apenas orquestradores de ferramentas visuais ultra-especializadas, ou caminharemos para uma integração total onde a distinção entre texto, imagem e vídeo desaparecerá completamente? A capacidade de manter a consistência de personagens e estilos em longos projetos continua sendo um desafio técnico que ainda não foi totalmente resolvido por nenhum dos dois gigantes.

Além disso, o papel da curadoria humana está em constante mutação. À medida que a IA se torna mais capaz, a habilidade de formular o problema e avaliar a qualidade do resultado torna-se mais valiosa do que a própria execução técnica da imagem. Observar como essas plataformas evoluirão para permitir um controle mais granular sobre a edição de imagens será fundamental para entender se a IA se tornará um parceiro criativo pleno ou se permanecerá como um gerador de ativos de uso imediato.

O cenário atual aponta para uma democratização sem precedentes da criação visual, mas também para uma dependência crescente de plataformas fechadas. O equilíbrio entre a facilidade de uso e a soberania sobre o output final continuará a ser o ponto de fricção que definirá os vencedores desta corrida tecnológica. A adoção dessas ferramentas exige, portanto, não apenas habilidade técnica, mas um senso crítico apurado sobre o valor e a originalidade do que está sendo produzido.

Com reportagem de t3n

Source · t3n