A recente divulgação da OpenAI sobre a reestruturação de sua pilha tecnológica de WebRTC oferece uma visão privilegiada sobre os desafios de engenharia necessários para tornar a inteligência artificial conversacional algo natural e imediato. Em um cenário onde a latência é o maior obstáculo para a adoção de interfaces de voz, a empresa detalhou como reformulou seus protocolos de comunicação para garantir que as trocas de turno entre humano e máquina ocorram sem os hiatos que, até pouco tempo atrás, caracterizavam a experiência com assistentes virtuais de primeira geração.

Segundo reportagem do blog da OpenAI, o esforço concentrou-se em otimizar a camada de transporte de dados para sustentar conversas em tempo real com escala global. Esta mudança não é apenas uma melhoria incremental de desempenho, mas uma alteração estrutural necessária para que a IA deixe de ser um sistema de comando e resposta e passe a atuar como um interlocutor capaz de interrupções, entonações e pausas naturais, elementos fundamentais para a percepção de inteligência em uma interação humana.

O desafio da latência na comunicação em tempo real

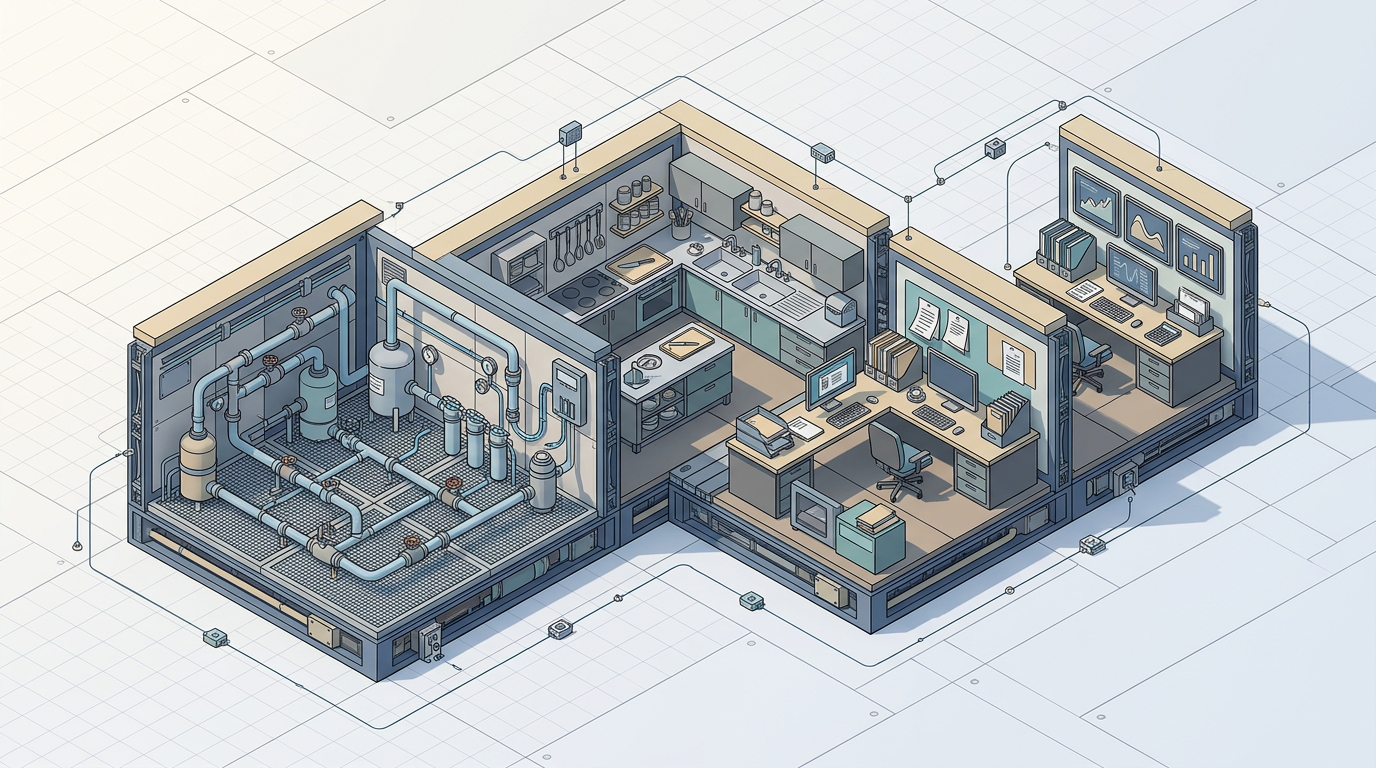

Historicamente, o protocolo WebRTC, desenvolvido para viabilizar a comunicação de vídeo e áudio em navegadores, nunca foi concebido para lidar com a carga computacional exigida por modelos de linguagem de grande escala (LLMs). A latência em sistemas de voz baseados em IA não é apenas um problema de rede; ela é o somatório do tempo de processamento do modelo, da codificação do áudio e da transmissão de pacotes. Quando esse tempo total ultrapassa algumas centenas de milissegundos, a fluidez do diálogo é irremediavelmente comprometida, gerando a sensação de desconexão que usuários sentiram durante anos com assistentes convencionais.

Para contornar essas limitações, a OpenAI precisou redesenhar a forma como os pacotes de áudio são priorizados dentro de sua rede global. A transição para uma infraestrutura que permite o processamento paralelo de sinais e uma gestão de buffer muito mais eficiente foi o ponto de inflexão. Ao reduzir o tempo de 'turn-taking' — o momento em que a IA decide que é sua vez de falar ou que deve interromper o usuário —, a empresa conseguiu aproximar a experiência de uso da latência natural de uma conversa telefônica, superando um gargalo que parecia intransponível para modelos que dependem de inferência pesada em nuvem.

Mecanismos de otimização e a infraestrutura de rede

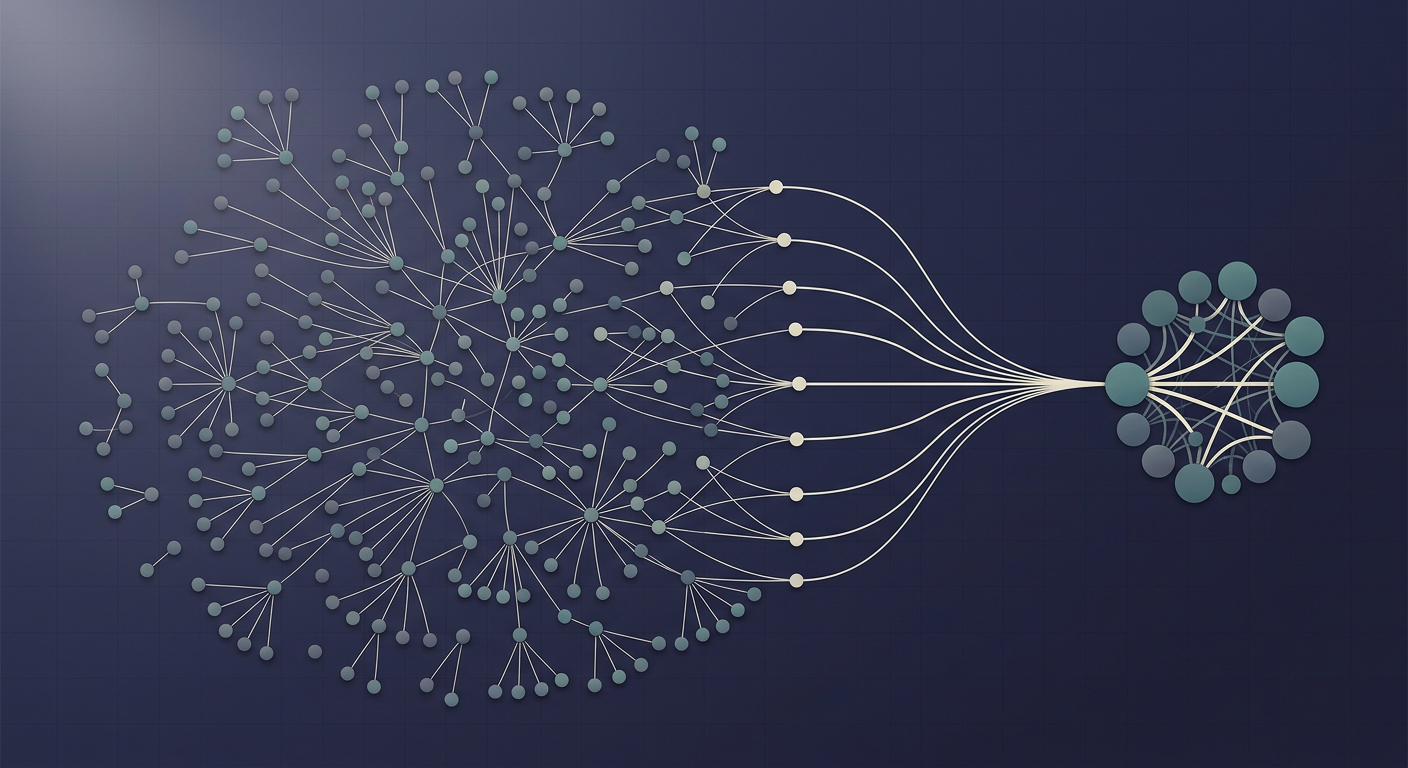

O cerne da inovação reside na integração profunda entre a camada de aplicação e a camada de transporte. Ao contrário de aplicações de voz tradicionais, que tratam o áudio como um fluxo contínuo e estático, a nova implementação da OpenAI trata a voz como um fluxo de dados dinâmico, onde a prioridade é ajustada em milissegundos baseada no contexto da conversa. Isso significa que, se o sistema detecta uma interrupção, o fluxo anterior é descartado instantaneamente em favor da nova entrada, um mecanismo que exige um controle de rede extremamente sofisticado para não causar artefatos sonoros ou instabilidade na conexão.

Além disso, a distribuição geográfica dos nós de processamento desempenha um papel crucial. A OpenAI utilizou técnicas de roteamento inteligente para minimizar a distância física entre o usuário e o servidor de inferência. Ao otimizar o caminho dos dados através de uma rede privada de alta performance, a empresa conseguiu reduzir o jitter e a perda de pacotes, que são os principais vilões da qualidade de voz em conexões instáveis. Esse nível de controle sobre a 'última milha' da conexão é o que permite que a IA mantenha a consistência mesmo sob condições de rede não ideais, um requisito básico para qualquer serviço de consumo de massa.

Implicações para o ecossistema de voz e stakeholders

Para o mercado de tecnologia, essa evolução sinaliza que a corrida pela IA não se limita mais apenas à capacidade dos modelos em raciocinar, mas à capacidade de entregar esse raciocínio no tempo do pensamento humano. Concorrentes que dependem de infraestruturas de terceiros ou de protocolos de rede padrão podem enfrentar dificuldades crescentes para igualar a qualidade da experiência oferecida pela OpenAI. Isso coloca uma pressão considerável sobre provedores de nuvem e empresas de telecomunicações, que agora precisam oferecer latências cada vez menores para suportar aplicações de voz de nova geração.

No Brasil, onde a infraestrutura de rede ainda enfrenta desafios de estabilidade em diversas regiões, essas inovações destacam a importância de investimentos em edge computing e redes de distribuição de conteúdo (CDNs) mais inteligentes. Desenvolvedores locais que buscam integrar capacidades de voz em seus produtos precisarão estar atentos a essas arquiteturas. A capacidade de entregar uma experiência de voz 'zero-lag' será, em breve, o divisor de águas entre produtos que se tornam parte do cotidiano do usuário e aqueles que são abandonados pela frustração de uso.

O horizonte da voz como interface primária

O que permanece incerto é se essa otimização de infraestrutura será suficiente para sustentar o crescimento massivo da base de usuários sem degradar o desempenho. O aumento do tráfego de voz em tempo real impõe uma carga computacional exponencialmente maior do que o processamento de texto, exigindo uma eficiência de escala que ainda não foi totalmente testada sob carga máxima em todos os mercados globais.

Além disso, a questão da privacidade e da soberania dos dados de voz ganha relevância à medida que essas interações se tornam mais frequentes e profundas. Observar como a OpenAI lidará com o equilíbrio entre a necessidade de processamento local (para baixa latência) e a centralização necessária para a manutenção dos modelos será fundamental para entender a próxima fase da evolução das interfaces de voz. A tecnologia está pronta para o uso, mas a infraestrutura global ainda é um organismo em constante adaptação.

A busca por essa latência mínima redefine as expectativas dos usuários, que, uma vez acostumados a interações instantâneas, dificilmente aceitarão retroceder para interfaces mais lentas. A infraestrutura de rede, antes vista como uma commodity, torna-se agora o diferencial competitivo mais crítico para a próxima onda de produtos de inteligência artificial.

Com reportagem de OpenAI Blog

Source · OpenAI Blog