A trajetória do NotebookLM dentro do ecossistema de inteligência artificial do Google é um estudo de caso sobre como a utilidade prática pode superar o frenesi em torno de modelos de linguagem de grande escala. Após quase duzentos artigos analisando as atualizações incrementais da plataforma, a pergunta fundamental sobre a eficácia da ferramenta finalmente encontrou resposta nos bastidores: como os próprios criadores utilizam o sistema no seu fluxo de trabalho diário?

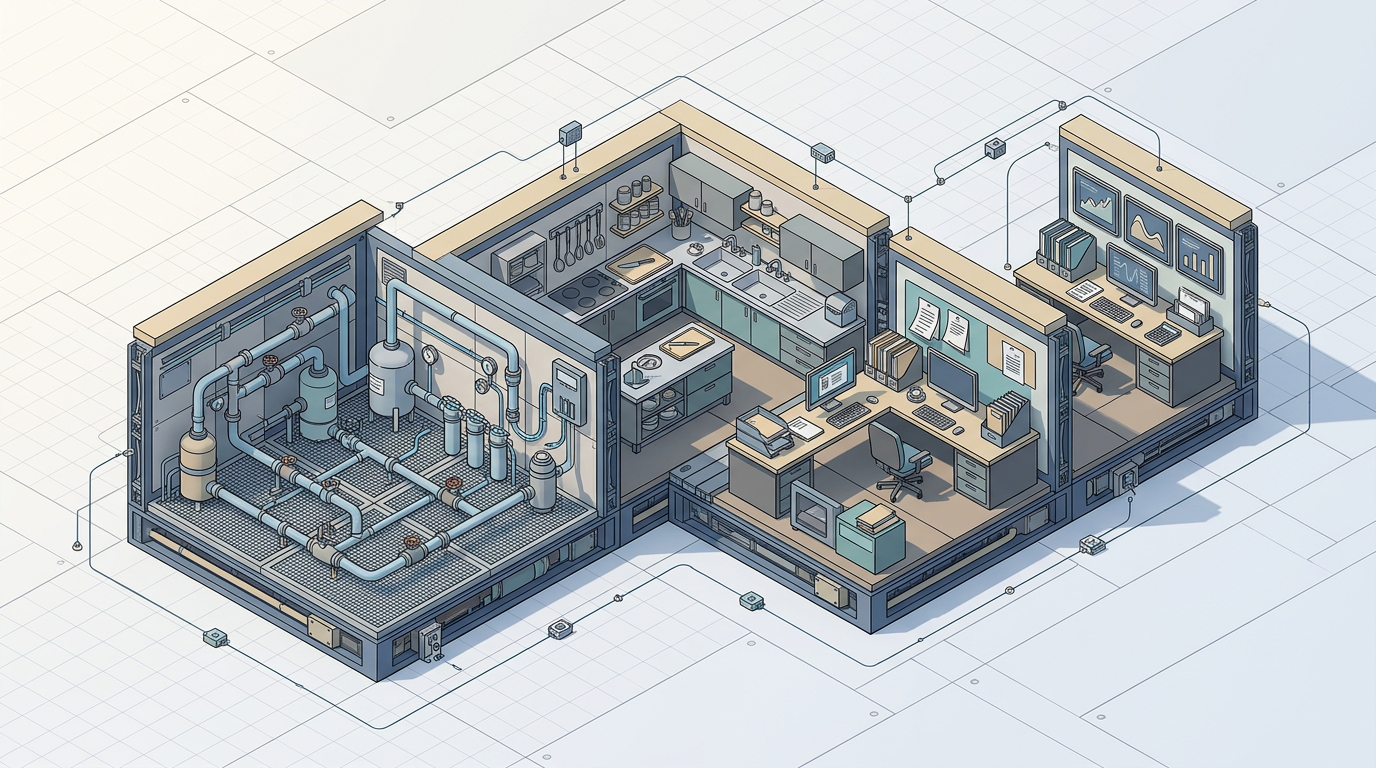

Segundo reportagem do XDA Developers, a essência do NotebookLM não reside apenas na capacidade técnica de processar grandes volumes de dados, mas na arquitetura de interface que permite ao usuário estabelecer uma curadoria ativa. Ao observar o setup de engenharia por trás das funcionalidades mais robustas da ferramenta, percebe-se que o foco da equipe de desenvolvimento esteve, desde o início, em reduzir o atrito entre a informação bruta e a síntese acionável, posicionando o software não como um oráculo, mas como um assistente de pesquisa especializado.

A filosofia de design centrada no contexto

O diferencial do NotebookLM, quando comparado a outros modelos de linguagem, é a sua dependência estrita do contexto fornecido pelo usuário. Enquanto ferramentas como o ChatGPT ou o Claude operam frequentemente sob uma vasta base de conhecimento genérica, o NotebookLM foi desenhado para atuar como um sistema de 'RAG' (Retrieval-Augmented Generation) de alta fidelidade, onde a fonte é o pilar central da resposta. Essa escolha arquitetural reflete uma mudança na mentalidade de desenvolvimento de produtos de IA: a priorização da precisão sobre a generalização.

Historicamente, a confiança em modelos de IA tem sido o maior obstáculo para a adoção em ambientes corporativos e acadêmicos. Ao restringir o escopo de atuação da ferramenta às fontes carregadas pelo usuário, a equipe de engenharia conseguiu mitigar substancialmente o fenômeno das alucinações, criando um ambiente de trabalho mais previsível. Esse design não é apenas uma escolha técnica, mas uma estratégia de retenção de usuários que buscam confiabilidade em vez de criatividade ilimitada, alinhando a ferramenta aos padrões de rigor acadêmico e profissional.

Mecanismos de interação e a curva de aprendizado

O processo de uso revelado pelos engenheiros da equipe demonstra que a eficácia da ferramenta é diretamente proporcional à qualidade do material de entrada. O sistema funciona como um espelho: a capacidade de extrair insights depende de uma organização prévia dos documentos, PDFs e notas que compõem o 'notebook'. Essa dinâmica exige que o usuário adote uma postura de curador, e não apenas de espectador, o que altera fundamentalmente a experiência de uso da tecnologia.

Na prática, os engenheiros utilizam a interface para realizar o que chamam de 'síntese de evidências'. Ao carregar múltiplos documentos técnicos e solicitar que o modelo identifique contradições ou pontos de convergência, o usuário consegue acelerar processos de revisão que, manualmente, levariam horas. A ferramenta atua como um filtro de complexidade, permitindo que o profissional navegue por grandes repositórios de informação com uma agilidade que era impraticável antes da popularização das interfaces baseadas em RAG, transformando o modo como a pesquisa é conduzida.

Implicações para o mercado e stakeholders

Para o ecossistema brasileiro de startups e empresas de tecnologia, a ascensão de ferramentas como o NotebookLM sinaliza uma oportunidade de otimização operacional significativa. Em um mercado onde a eficiência é vital, a capacidade de integrar rapidamente bases de conhecimento internas a sistemas de IA pode representar uma vantagem competitiva considerável. Reguladores e gestores de dados, contudo, devem observar como essa dependência de fontes externas exige políticas de governança de dados mais robustas, garantindo que informações sensíveis não sejam expostas inadvertidamente durante o treinamento ou processamento.

Concorrentes no setor de SaaS e produtividade agora enfrentam o desafio de replicar essa experiência de 'contexto restrito' sem sacrificar a flexibilidade. A disputa não será mais sobre quem possui o modelo de linguagem mais potente, mas sobre quem oferece a melhor interface de integração com o fluxo de trabalho do usuário. Para o consumidor, a tendência é positiva: o surgimento de ferramentas que respeitam o contexto individual sugere que a era dos assistentes genéricos está dando lugar a ferramentas de precisão, adaptadas às necessidades específicas de cada setor.

O futuro da curadoria assistida por IA

O que permanece incerto é o limite de escalabilidade desse tipo de ferramenta. À medida que os usuários aumentam a complexidade e o volume das fontes, o desafio de manter a precisão e a latência baixa torna-se um problema de engenharia ainda mais sofisticado. Será que o modelo conseguirá manter a mesma fidelidade quando o volume de dados ultrapassar a capacidade atual de indexação e recuperação rápida?

Além disso, a evolução da interface para além do texto, integrando áudio, vídeo e outros formatos de forma nativa, será o próximo grande teste para o NotebookLM. O que observar nos próximos meses é a integração da ferramenta com o ecossistema mais amplo de produtividade do Google, o que poderá consolidar a plataforma como um padrão de mercado ou, alternativamente, revelar limitações na sua arquitetura atual de uso individual.

A transição de uma ferramenta de pesquisa experimental para um componente essencial do fluxo de trabalho diário demonstra que a inteligência artificial, quando aplicada com foco em problemas específicos de gestão de conhecimento, entrega resultados muito mais tangíveis do que as promessas de automação total. A eficácia da tecnologia, ao fim, depende menos da sofisticação do algoritmo e mais da clareza com que o usuário define o seu próprio contexto de trabalho.

Com reportagem de XDA Developers

Source · XDA developers