O Departamento de Defesa dos Estados Unidos anunciou na última sexta-feira uma série de contratos com sete empresas de tecnologia de ponta, incluindo Google, Microsoft, Amazon Web Services, Nvidia, OpenAI, Reflection e SpaceX. O objetivo central é a integração de ferramentas de inteligência artificial em redes de computadores classificadas, permitindo que as forças armadas utilizem capacidades avançadas para auxiliar na tomada de decisão em cenários operacionais complexos. Segundo reportagem da Fast Company, a iniciativa marca uma aceleração significativa na adoção de tecnologias emergentes pelo aparato militar americano.

Essa movimentação não é apenas uma atualização tecnológica, mas uma redefinição estrutural de como o poder militar será exercido no século XXI. Ao diversificar seus fornecedores e incorporar modelos de IA — que vão desde o processamento de dados de vigilância até a manutenção de cadeias de suprimentos —, o Pentágono busca mitigar riscos de dependência excessiva de um único parceiro, ao mesmo tempo que tenta manter uma vantagem estratégica frente ao rápido avanço de sistemas de IA desenvolvidos pela China. A ausência da Anthropic no consórcio, em um contexto em que a empresa tem publicamente defendido restrições ao uso de sua tecnologia em aplicações militares, ilustra a tensão crescente entre a cultura do Vale do Silício e as demandas soberanas do Estado.

A transição da IA como ferramenta de suporte

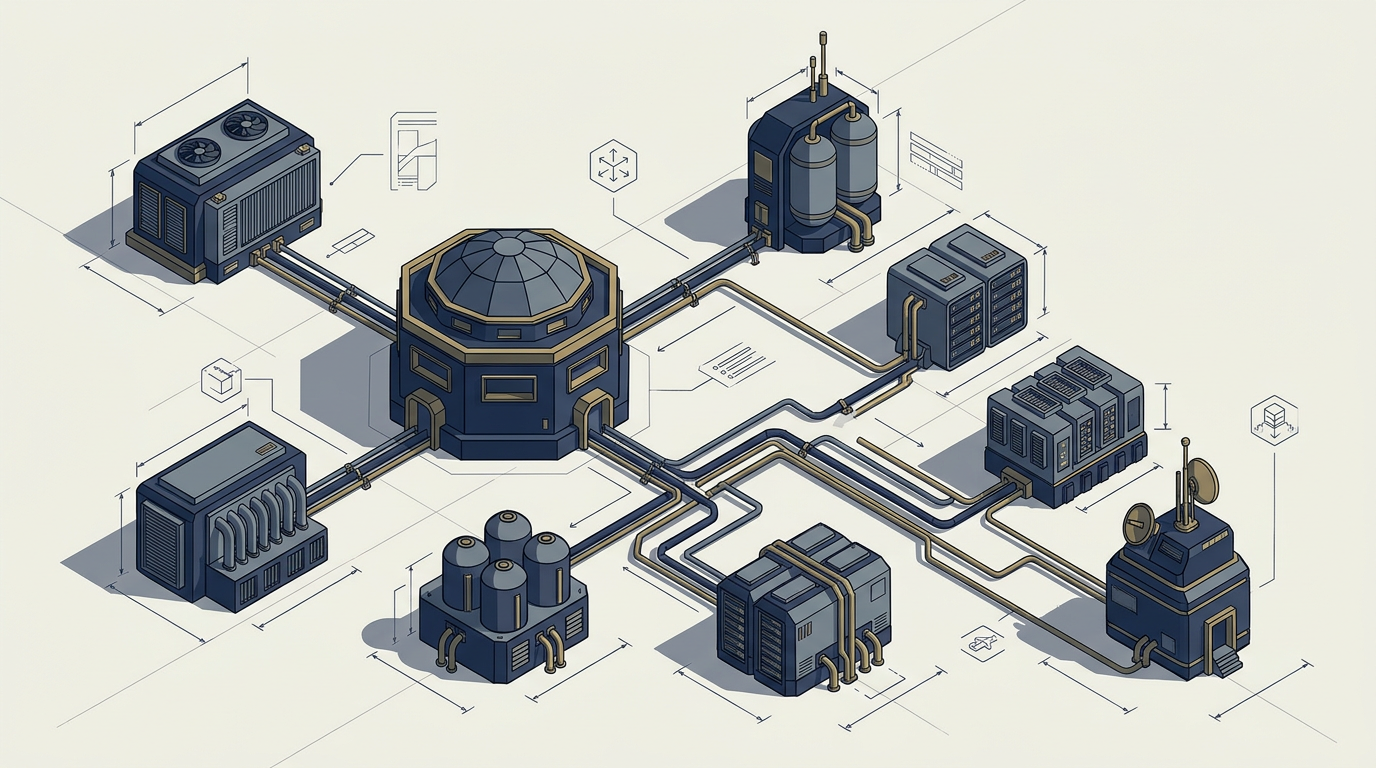

Historicamente, a relação entre o complexo industrial-militar e a indústria de tecnologia tem sido marcada por ciclos de proximidade e distanciamento. O que observamos agora é uma institucionalização da IA como componente central da doutrina militar. Ao contrário de inovações anteriores, a IA oferece a promessa de processar volumes massivos de informações em tempo real, um requisito fundamental para a guerra moderna, onde a velocidade da tomada de decisão determina o sucesso ou o fracasso de uma missão. A tese por trás dessa integração é que a máquina pode atuar como um multiplicador de força, reduzindo o tempo de identificação de alvos e otimizando a logística complexa das forças armadas.

Entretanto, essa transição levanta desafios conceituais profundos. A aplicação de modelos de linguagem e visão computacional em ambientes de combate não é isenta de erros, e a confiabilidade desses sistemas em situações de vida ou morte permanece um ponto de interrogação. O setor de defesa, historicamente avesso ao risco, está agora tentando equilibrar a necessidade de agilidade tecnológica com a rigidez necessária para garantir que essas ferramentas não se tornem fontes de instabilidade. A busca por um "modelo americano" de IA, como mencionado por autoridades do Pentágono, sugere que a tecnologia passou a ser vista como um ativo de segurança nacional tão crítico quanto o desenvolvimento de semicondutores ou a capacidade de lançamento espacial.

Mecanismos de controle e a fricção ética

O mecanismo de implementação desses contratos revela uma tentativa de padronizar a governança da IA no campo de batalha. A estratégia do Pentágono foca na redundância: ao contratar múltiplos provedores, o Estado garante que nenhuma empresa tenha poder de veto sobre operações estratégicas. Esse modelo "multi-vendor" é uma resposta direta ao posicionamento de empresas como a Anthropic, que tem buscado garantias contratuais estritas contra o uso de sua tecnologia em armas autônomas ou em vigilância de cidadãos americanos. O consórcio formado evidencia que, para o governo, a conformidade com as diretrizes de defesa é uma condição inegociável para participar desse mercado.

Contudo, a questão da supervisão humana permanece como o ponto de maior fricção. Embora alguns acordos incluam cláusulas que exigem a presença de um operador humano em decisões críticas, a definição técnica do que constitui "supervisão" é elástica. Em cenários de alta velocidade, a capacidade de um operador humano de intervir de forma significativa em uma sugestão gerada por IA é frequentemente limitada pela própria complexidade do sistema. A preocupação é que a confiança excessiva na ferramenta — o chamado viés de automação — possa levar a decisões equivocadas, exacerbando danos colaterais ou violando princípios básicos de direitos civis, conforme alertado por especialistas em ética tecnológica.

Stakeholders e o impacto no ecossistema global

As implicações desse cenário transcendem as fronteiras americanas. Para os concorrentes e aliados, o movimento do Pentágono sinaliza que a corrida armamentista de IA é agora uma realidade consolidada. Empresas que operam no setor de defesa enfrentam agora um dilema: alinhar-se totalmente às demandas do Estado, correndo o risco de alienar parte de sua força de trabalho e base de clientes civis, ou manter uma postura neutra que pode resultar na exclusão de contratos governamentais lucrativos. A pressão sobre as Big Techs para que atuem como braços de segurança nacional é uma mudança de paradigma que altera o equilíbrio de poder entre o setor privado e o setor público.

No Brasil, onde o ecossistema de defesa e tecnologia ainda busca seu espaço, o movimento americano serve como um estudo de caso sobre a soberania tecnológica. A dependência de modelos de IA estrangeiros em sistemas de defesa sensíveis é um risco que países em desenvolvimento precisam avaliar com cautela. A lição americana sugere que a infraestrutura crítica deve ser acompanhada de uma capacidade nacional de governança e, idealmente, de desenvolvimento próprio, sob pena de tornar a segurança nacional refém dos termos de serviço de corporações transnacionais que respondem a agendas políticas externas.

Perspectivas e incertezas técnicas

O que permanece incerto é a eficácia operacional desses sistemas em condições de conflito real, onde a infraestrutura de rede pode ser comprometida e os dados de treinamento podem ser manipulados. A questão não é apenas se a IA funciona em um ambiente de laboratório, mas como ela se comporta sob estresse extremo. A necessidade de treinar operadores para identificar quando a IA está apresentando alucinações ou viés é um desafio que ainda não foi totalmente endereçado pelas novas diretrizes do Departamento de Defesa.

Observar a evolução desses contratos nos próximos meses será fundamental para entender se as garantias de "supervisão humana" são compromissos concretos ou apenas concessões retóricas. A estabilidade das parcerias entre o Pentágono e as Big Techs dependerá da capacidade de alinhar a inovação acelerada com a segurança jurídica e ética. O debate sobre até onde a máquina pode ir sem a intervenção humana direta está apenas começando, e as decisões tomadas hoje pelo governo americano definirão os padrões globais de uso de IA em conflitos para as próximas décadas.

O cenário aponta para uma integração cada vez mais profunda, onde a fronteira entre a tecnologia comercial e o armamento militar se torna crescentemente porosa, exigindo uma vigilância constante da sociedade civil e dos organismos de controle internacional.

Com reportagem de Fast Company

Source · Fast Company