A implementação de agentes de inteligência artificial em infraestruturas críticas, conhecidas no setor como KRITIS, atingiu um ponto de inflexão técnico e regulatório. Enquanto a indústria busca a eficiência operacional prometida pelos sistemas autônomos, o núcleo da operação permanece ancorado na necessidade absoluta de determinismo, um pilar fundamental para a segurança sistêmica que contrasta frontalmente com a natureza inerentemente probabilística dos modelos de linguagem e agentes inteligentes contemporâneos.

A tensão entre a agilidade algorítmica e a rigidez necessária para manter redes de energia, água e telecomunicações operando sem falhas catastroficas é o centro de um debate crescente entre engenheiros de sistemas e especialistas em cibersegurança. Segundo reportagem do Heise Online, a solução para essa divergência não reside na limitação da tecnologia, mas em uma reestruturação arquitetural que fragmenta as ações de agentes autônomos em passos individuais passíveis de auditoria e verificação humana constante.

O conflito entre a incerteza da IA e a rigidez do setor crítico

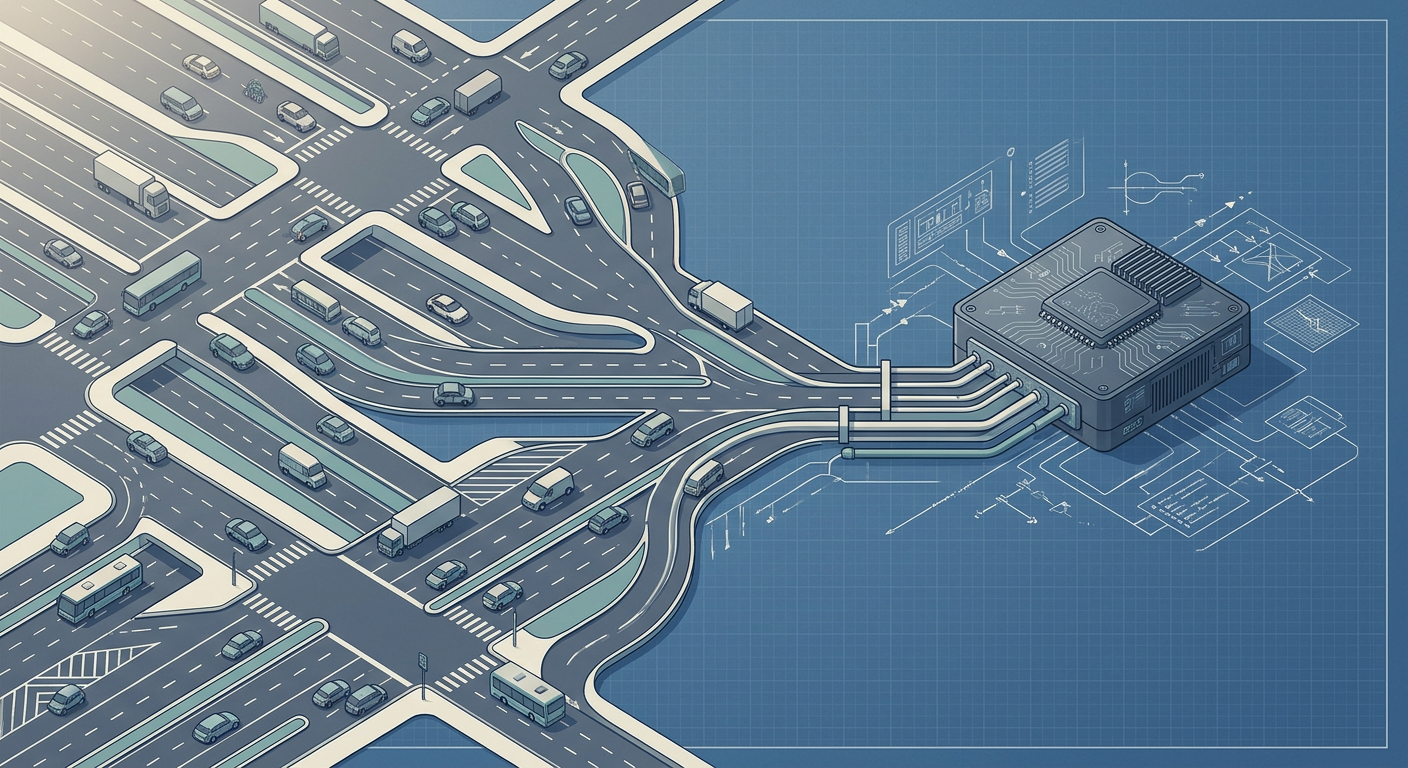

Historicamente, a infraestrutura crítica foi projetada sobre o princípio da previsibilidade absoluta. Cada comando emitido por um sistema de controle industrial, como um PLC (Controlador Lógico Programável), deve resultar em uma saída específica e replicável. A introdução de agentes de IA, que operam com base em inferências estatísticas e probabilidades, introduz uma variável de incerteza que, em teoria, é inaceitável para operadores de rede. O comportamento emergente desses agentes, embora eficiente em cenários de otimização de carga ou diagnóstico preditivo, pode levar a decisões imprevistas em condições de contorno não mapeadas durante o treinamento do modelo.

A dificuldade central reside no fato de que os modelos de IA atuais, especialmente os baseados em arquiteturas de transformadores, operam como 'caixas-pretas' em muitos aspectos de seu raciocínio. Para um engenheiro de sistemas, a falta de uma cadeia de decisão transparente é um risco operacional inaceitável. Quando um agente autônomo sugere uma alteração em uma subestação elétrica, a necessidade de entender o 'porquê' e garantir que o 'como' está dentro de parâmetros estritos de segurança é a diferença entre a inovação e o desastre sistêmico.

Arquiteturas de decomposição como salvaguarda operacional

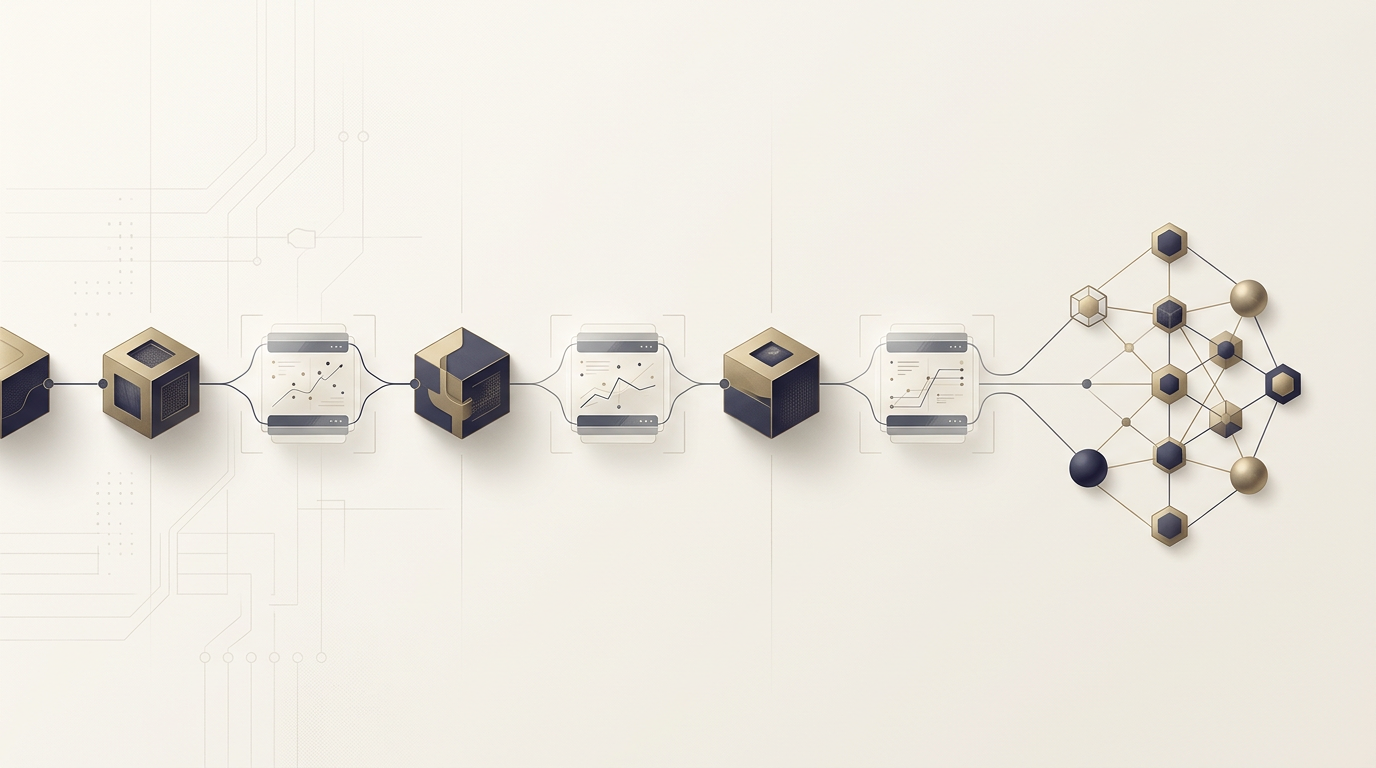

Para mitigar esses riscos, a abordagem emergente de 'Agentic AIOps' propõe a decomposição das tarefas complexas em subtarefas menores e verificáveis. Em vez de permitir que um agente tome uma decisão final e execute uma ação de alto impacto, o sistema é desenhado para operar em um ciclo de 'propor e validar'. Cada passo do agente é submetido a um conjunto de regras determinísticas de 'guardrail' que atuam como filtros de segurança. Se a ação proposta pelo agente violar qualquer parâmetro pré-estabelecido, o processo é interrompido antes que qualquer alteração física ocorra na infraestrutura.

Esse mecanismo de controle transforma a IA de um tomador de decisão autônomo em um facilitador de processos que opera sob supervisão constante. Ao fragmentar a execução, as empresas conseguem criar logs de auditoria detalhados, permitindo que cada decisão seja rastreada até o estado de entrada e a lógica de inferência utilizada. Essa abordagem não apenas aumenta a segurança, mas também facilita a conformidade regulatória, um ponto crítico para empresas que operam sob leis rigorosas de proteção de infraestrutura essencial, como as diretivas NIS2 na União Europeia ou normas equivalentes de segurança cibernética em outras jurisdições globais.

Implicações para a governança e o ecossistema de tecnologia

As implicações dessa mudança de paradigma são profundas para todos os stakeholders envolvidos. Para reguladores, o desafio é criar normas que não sufoquem a inovação, mas que exijam transparência técnica e capacidade de auditoria. Para os fornecedores de tecnologia, a pressão é por desenvolver ferramentas que integrem nativamente esses mecanismos de 'human-in-the-loop' ou 'check-in-the-loop'. A falha em oferecer sistemas auditáveis pode limitar a adoção de IA em setores cruciais, mantendo-os em um estado de obsolescência tecnológica por medo de instabilidade.

No ecossistema brasileiro, onde a digitalização de redes de energia e saneamento tem avançado rapidamente, o debate sobre a resiliência operacional é urgente. A adoção de tecnologias de IA em larga escala requer uma maturidade de governança que vai além da simples implementação de software. Empresas que buscam liderar essa transição devem considerar que a robustez do sistema não virá da sofisticação do modelo de IA, mas da capacidade da organização em integrar esses modelos em fluxos de trabalho que respeitem as leis da física e da engenharia de controle tradicional.

O futuro da autonomia sob vigilância constante

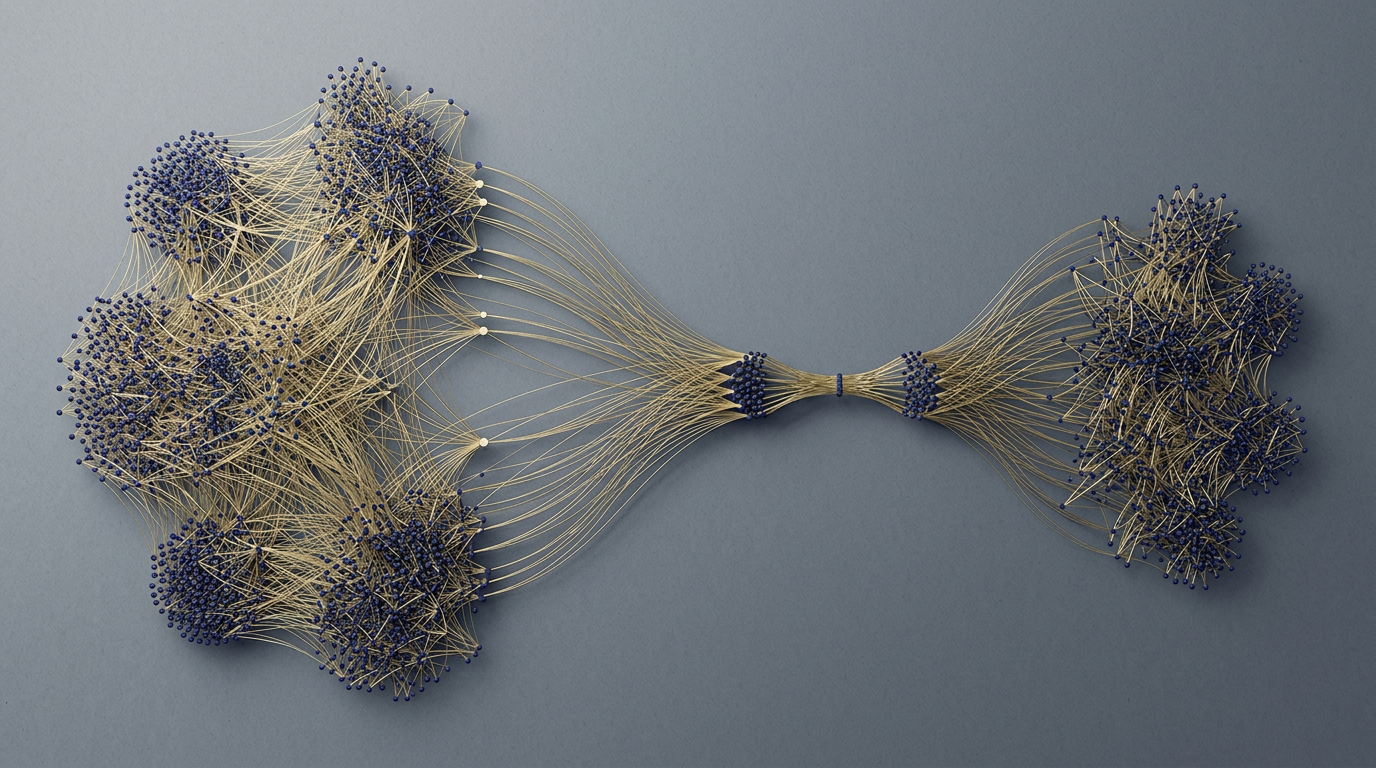

O que permanece incerto é a escalabilidade dessas arquiteturas de decomposição à medida que a complexidade dos sistemas aumenta. À medida que mais agentes interagem entre si em ambientes de rede distribuídos, a orquestração desses agentes e a manutenção da integridade de suas decisões individuais tornar-se-ão um desafio de engenharia de software de proporções inéditas. A interdependência entre sistemas de IA pode criar novos vetores de falha que ainda não compreendemos totalmente.

Observar a evolução das ferramentas de monitoramento e a padronização de protocolos de comunicação entre agentes de IA e sistemas legados será fundamental nos próximos anos. A transição para uma infraestrutura 'agentic' não será marcada por uma substituição abrupta, mas por uma integração cautelosa, onde a confiança será construída camada por camada, através de evidências empíricas de que a máquina, mesmo quando autônoma, mantém-se estritamente dentro dos limites da segurança operacional.

A busca pelo equilíbrio entre a capacidade preditiva da inteligência artificial e a necessidade imutável de determinismo em sistemas críticos define a próxima fronteira da engenharia de infraestrutura. A questão central não é mais se a IA deve ser integrada, mas como construir as grades de proteção necessárias para que essa integração seja não apenas eficiente, mas fundamentalmente segura para a continuidade das operações que sustentam a economia moderna.

Com reportagem de Heise Online

Source · Heise Online