A DeepMind apresentou nesta semana o AlphaEvolve, um sistema de codificação impulsionado pelo modelo Gemini, desenhado para atuar além da simples geração de texto ou código básico. Em um movimento que reforça a transição da indústria de IA de modelos puramente generativos para sistemas agentes autônomos, a ferramenta busca otimizar fluxos de trabalho em engenharia, pesquisa científica e gestão de infraestrutura complexa. Segundo o anúncio oficial da companhia, a arquitetura do agente permite a iteração contínua sobre problemas que exigem raciocínio lógico profundo, reduzindo o gargalo humano em tarefas de implementação técnica.

Este lançamento ocorre em um momento em que o ecossistema de tecnologia busca desesperadamente por aplicações que entreguem valor tangível além da interface de chat. Ao integrar o Gemini em uma estrutura de agente que pode testar, validar e ajustar seu próprio código em tempo real, a DeepMind sinaliza que a próxima fronteira da inteligência artificial não reside apenas na capacidade de prever a próxima palavra, mas na competência de executar ciclos completos de resolução de problemas sem supervisão constante. A aposta é que o AlphaEvolve funcione como um multiplicador de força para desenvolvedores e cientistas que operam em escalas de alta complexidade.

A evolução da codificação autônoma

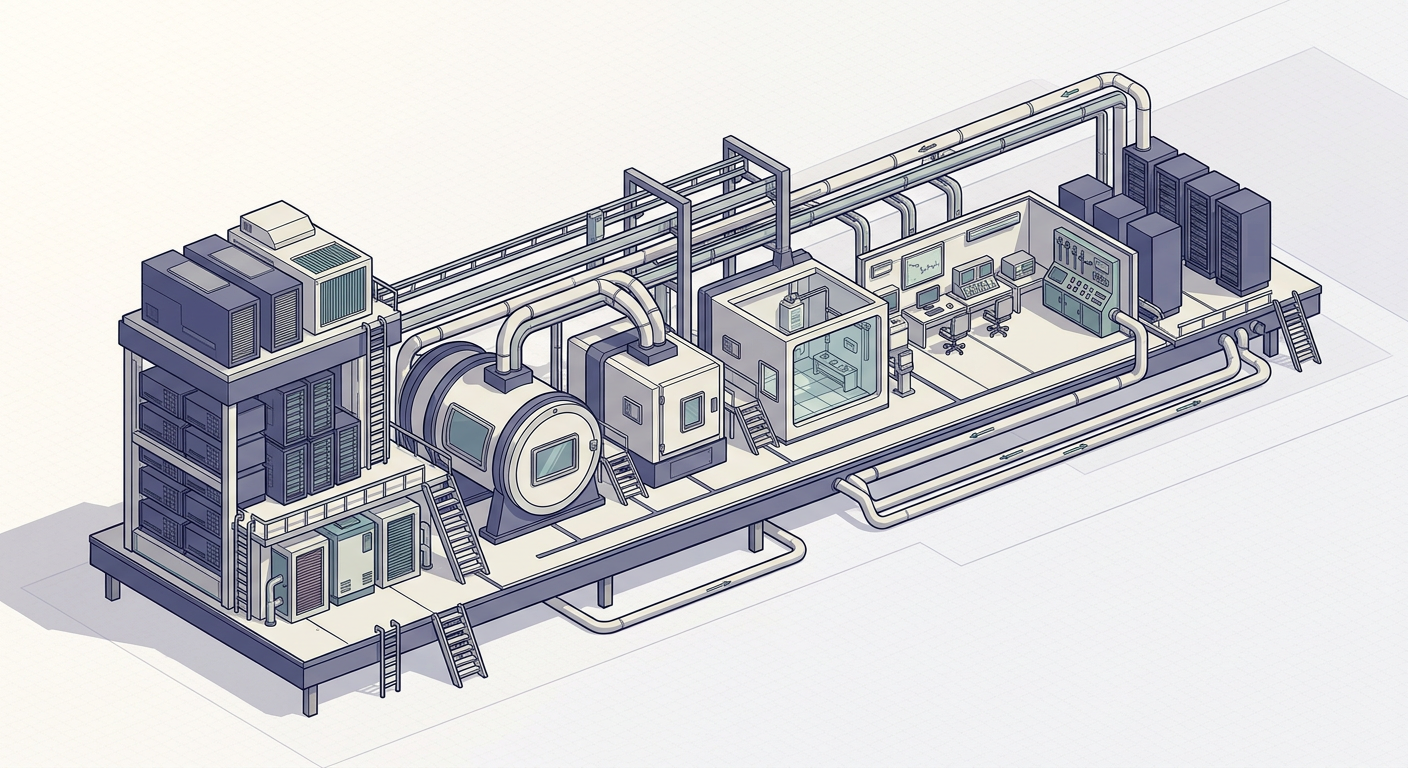

A história da automação de software sempre foi marcada por tentativas de reduzir a carga cognitiva do programador humano, desde a introdução das linguagens de alto nível até os IDEs modernos. No entanto, o AlphaEvolve representa um salto qualitativo ao incorporar a capacidade de raciocínio multimodal do Gemini. Diferente dos assistentes de código tradicionais, que funcionam como autocompletar avançados, o sistema opera em um loop de feedback onde o agente propõe uma solução, avalia o resultado em um ambiente controlado e refina a lógica com base nos erros encontrados. Esse processo de 'tentativa e erro' inteligente é o que permite a aplicação em áreas tão distintas quanto a modelagem de infraestrutura urbana e a descoberta de novos materiais.

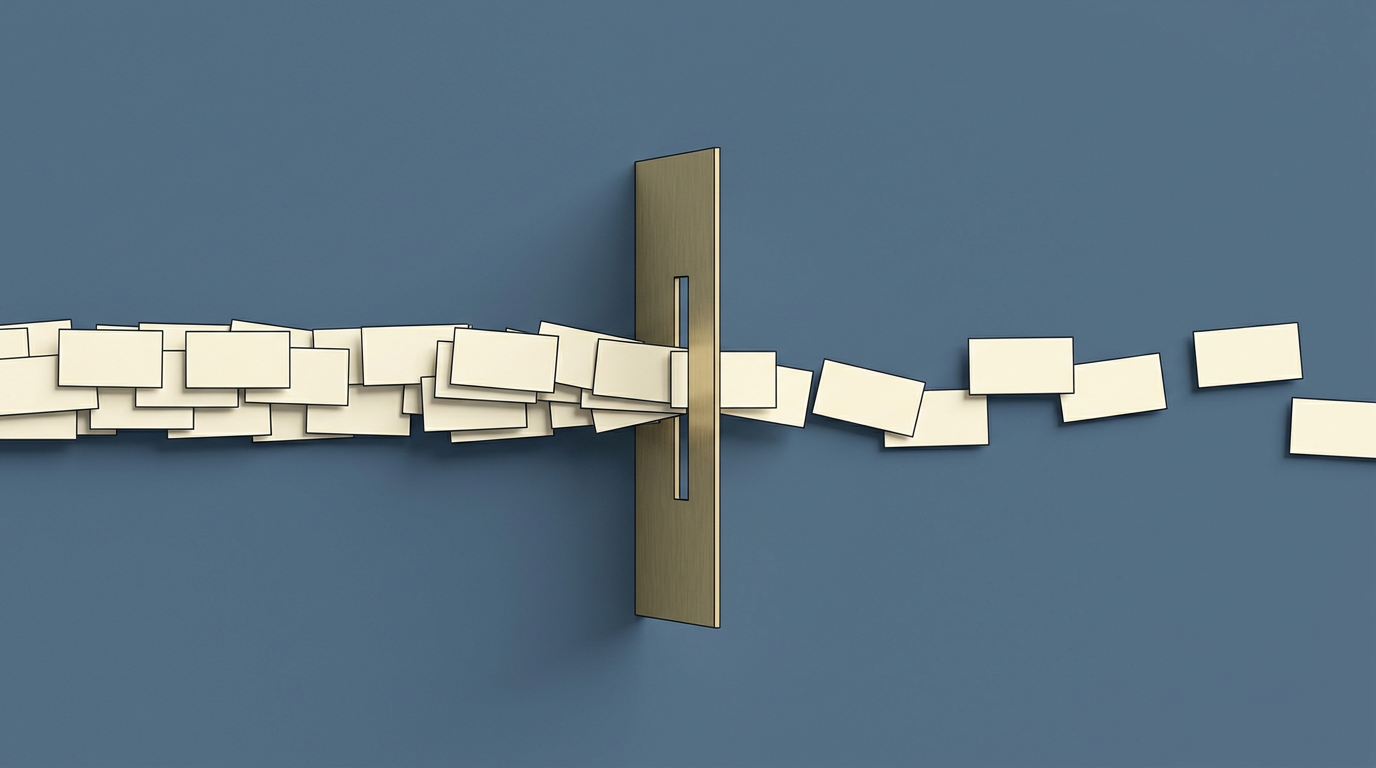

O contexto estrutural aqui é a mudança nos incentivos de desenvolvimento de software dentro das grandes empresas de tecnologia. Com o custo computacional de treinar modelos de fronteira atingindo patamares proibitivos, o foco se deslocou para a eficiência operacional e a capacidade de aplicar esses modelos para resolver problemas de 'cauda longa' — tarefas específicas que, embora cruciais, consomem tempo desproporcional de especialistas humanos. Ao automatizar a escrita de código para essas tarefas, a DeepMind não apenas melhora a produtividade, mas altera a própria natureza da gestão de projetos de engenharia, onde o humano passa a atuar mais como um arquiteto de sistemas e menos como um executor de sintaxe.

Mecanismos de ação e a lógica dos agentes

O diferencial do AlphaEvolve reside na sua capacidade de manter o estado de um problema ao longo de múltiplas iterações. A maioria dos modelos de linguagem sofre com a perda de contexto ou com a alucinação quando confrontados com bases de código extensas e interconectadas. O AlphaEvolve contorna essa limitação ao estruturar o processo de codificação em etapas modulares, onde cada componente é verificado antes da integração. Esse mecanismo de 'validação incremental' é fundamental para que o sistema seja confiável em ambientes de produção, onde um erro de lógica pode custar milhões em infraestrutura ou tempo de pesquisa.

Além disso, o uso do Gemini como o 'cérebro' do agente permite que ele interprete não apenas o código, mas também documentação técnica, especificações de requisitos e até logs de erro em formatos variados. A capacidade de processar essa diversidade de dados é o que confere ao AlphaEvolve a versatilidade necessária para transitar entre diferentes domínios. Em vez de treinar modelos especializados para cada tarefa, a DeepMind utiliza a generalização do Gemini para entender o contexto do problema e aplicar os princípios de codificação necessários, independentemente de se o objetivo é otimizar um algoritmo de logística ou simular interações moleculares em um laboratório farmacêutico.

Impactos e tensões no ecossistema

Para as empresas, a adoção de sistemas como o AlphaEvolve traz implicações profundas na estrutura de custos e na gestão de talentos. Se a codificação de rotina e a resolução de bugs complexos se tornam tarefas automatizáveis, o valor de mercado de desenvolvedores juniores e de nível médio pode ser pressionado, exigindo uma requalificação rápida para funções de supervisão e arquitetura de alto nível. Por outro lado, reguladores e especialistas em segurança cibernética observam com cautela a crescente autonomia desses agentes. A capacidade de um sistema de IA escrever e implantar código sem intervenção humana levanta questões sobre responsabilidade e governança que ainda não possuem respostas definitivas, especialmente se considerarmos a possibilidade de falhas sistêmicas em larga escala.

No Brasil, onde o setor de tecnologia busca escalar sua competitividade global, a chegada de ferramentas de agente autônomo apresenta uma oportunidade de salto tecnológico. Startups e empresas de serviços financeiros, que dependem fortemente de infraestrutura de software robusta, poderiam utilizar tais sistemas para acelerar o desenvolvimento de produtos e reduzir o time-to-market. Contudo, a adoção depende de uma infraestrutura de dados que permita que esses agentes operem com segurança, além de uma cultura organizacional que esteja preparada para delegar decisões técnicas a sistemas de IA, um desafio cultural que transcende a mera implementação técnica.

Perguntas em aberto e o futuro da autonomia

O que permanece incerto é a resiliência do AlphaEvolve diante de cenários de 'borda', onde a criatividade humana ainda supera a lógica baseada em padrões de treinamento. Até que ponto um agente pode inovar em arquiteturas de software, ou ele se limitará a otimizar o que já foi concebido por humanos? A fronteira entre a automação eficiente e a estagnação criativa é tênue, e a comunidade científica precisará de métricas mais claras para avaliar se o uso desses agentes está, de fato, expandindo o conhecimento ou apenas acelerando a replicação de métodos existentes.

Nos próximos meses, será essencial observar a adoção do sistema fora dos laboratórios da Google. A transição para o uso em escala real revelará se os ganhos de produtividade prometidos pela DeepMind são sustentáveis ou se a manutenção desses agentes autônomos criará novos tipos de dívida técnica. A tecnologia de agentes está apenas começando a sair da fase teórica, e o AlphaEvolve é um teste de fogo para a tese de que a IA pode, finalmente, se tornar um colaborador ativo no mundo físico e digital.

O debate sobre a autonomia das máquinas está longe de ser encerrado. Enquanto a DeepMind avança com o AlphaEvolve, o setor observa com atenção se a eficiência conquistada na codificação se traduzirá em uma nova era de inovação científica ou se estamos apenas construindo sistemas mais rápidos para repetir as mesmas estruturas. A resposta, como sempre, dependerá menos do modelo e mais de como as organizações decidirão integrar essa nova camada de inteligência em seus fluxos de trabalho.

Com reportagem de DeepMind Blog

Source · DeepMind Blog