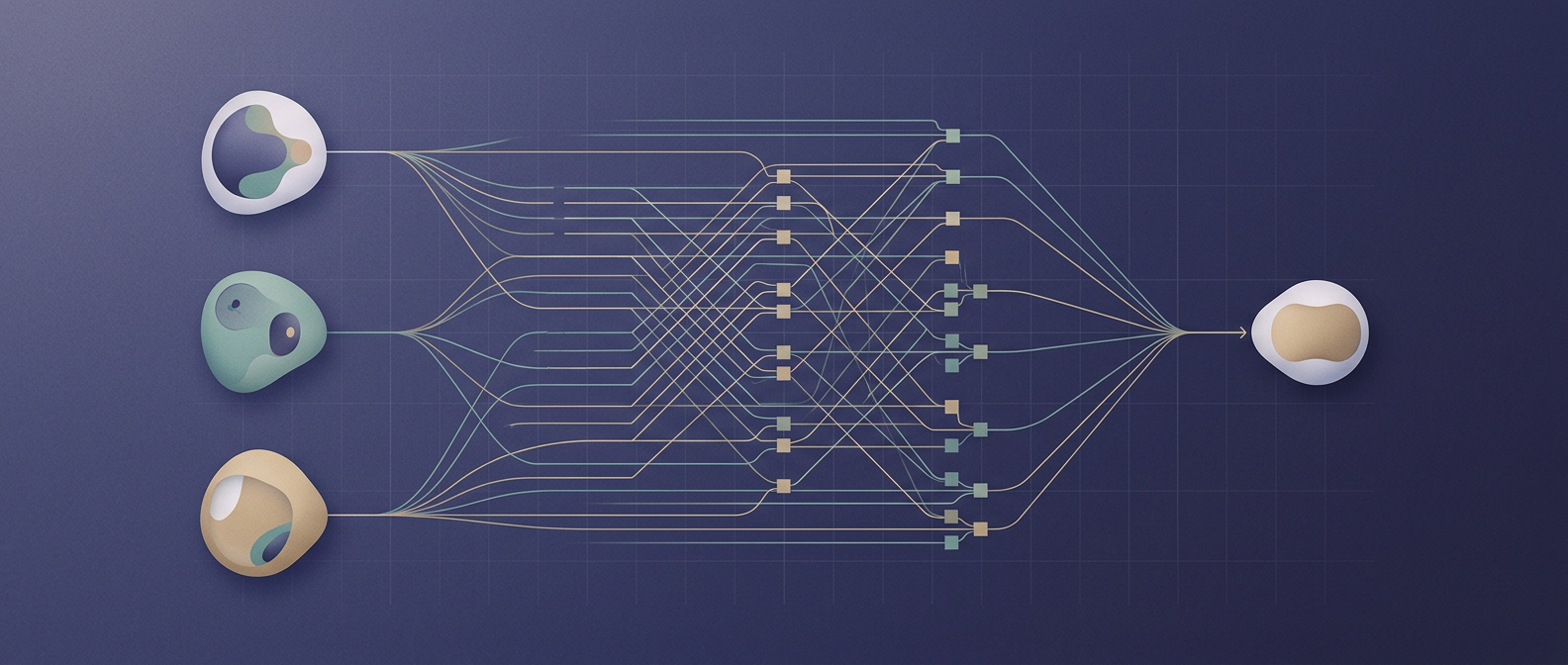

A computação multipartidária, ou MPC, representa uma das fronteiras mais fascinantes da criptografia moderna. O desafio central é permitir que um conjunto de partes realize cálculos sobre seus dados privados de forma conjunta, sem que nenhuma delas precise revelar sua entrada individual para as demais ou para um servidor central. No centro dessa mágica algorítmica reside um conceito fundamental conhecido como Beaver Triples, uma técnica de pré-processamento que transforma a complexidade da multiplicação de dados secretos em operações lineares simples e eficientes.

Segundo análises técnicas recentes, a eficácia da MPC depende diretamente da capacidade de processar multiplicações sob criptografia sem comprometer a integridade do dado. Os Beaver Triples, nomeados em homenagem ao pesquisador Donald Beaver, funcionam como um 'atalho' estatístico. Eles permitem que as partes envolvidas realizem a multiplicação de valores secretos dividindo a tarefa em uma fase de pré-processamento, onde o custo computacional é isolado, e uma fase de computação online, onde a operação final ocorre quase instantaneamente. Essa separação é o que torna a computação segura viável para aplicações práticas em finanças e saúde.

A fundação matemática da confiança distribuída

Para entender a importância dos Beaver Triples, é preciso compreender a natureza da multiplicação em sistemas de compartilhamento de segredos. Em esquemas como o de Shamir, a adição é uma operação trivial: se você tem dois segredos compartilhados, a soma de suas partes resulta em um novo segredo que representa a soma dos valores originais. No entanto, a multiplicação é inerentemente não linear e exige uma interação intensiva entre as partes para que o resultado final seja reconstruído corretamente sem que os valores individuais sejam expostos.

O mecanismo dos Beaver Triples resolve esse gargalo através de uma tripla de valores aleatórios (a, b, c), onde c é igual ao produto de a e b. Esses valores são distribuídos entre as partes de forma que ninguém conhece a, b ou c individualmente, mas todos possuem 'pedaços' (shares) desses números. Quando o protocolo de computação precisa multiplicar dois valores secretos x e y, ele utiliza essa tripla pré-computada para mascarar as entradas. Ao revelar apenas as diferenças mascaradas (x-a) e (y-b), as partes podem computar o produto final sem nunca expor os valores originais x ou y.

O papel da fase de pré-processamento

A genialidade por trás dos Beaver Triples está na transferência do custo computacional. Em cenários de alta latência ou redes distribuídas, realizar uma multiplicação segura em tempo real seria proibitivo devido à necessidade de múltiplas rodadas de comunicação entre os participantes. Ao mover o trabalho pesado para uma fase de pré-processamento, os sistemas podem gerar e armazenar essas triplas em momentos de baixa demanda ou através de servidores dedicados, permitindo que o processamento de dados críticos ocorra com latência mínima.

Este modelo de 'offline e online' transformou a viabilidade comercial da criptografia. Empresas que lidam com dados sensíveis de clientes, como bancos realizando análises de risco conjuntas ou hospitais comparando eficácias de tratamentos sem compartilhar prontuários, dependem dessa técnica para manter a conformidade regulatória. Sem a capacidade de pré-processar essas triplas, a sobrecarga de comunicação tornaria qualquer tentativa de análise de dados em larga escala impraticável, limitando a utilidade da criptografia a casos de uso extremamente simples e de baixo volume.

Implicações para o ecossistema de privacidade

As implicações dos Beaver Triples estendem-se muito além da teoria acadêmica. À medida que a regulação de dados, como a LGPD no Brasil e o GDPR na Europa, torna o compartilhamento de informações um risco jurídico e de reputação, a adoção de técnicas de computação multipartidária torna-se uma estratégia de mitigação de risco. Setores que exigem colaboração, mas que são proibidos por contrato ou lei de compartilhar dados brutos, encontram na MPC uma via de saída que preserva o valor da análise sem violar a soberania do dado.

Para o ecossistema de tecnologia, isso significa que a infraestrutura de nuvem pode evoluir para um modelo de 'computação cega'. Competidores em um mercado podem, teoricamente, treinar modelos de machine learning ou realizar auditorias de conformidade sem que os dados proprietários de um sejam expostos ao outro. A barreira para essa adoção, contudo, ainda reside na complexidade de implementação e na necessidade de hardware especializado ou protocolos de rede robustos que suportem a fase de pré-processamento de forma eficiente e segura.

Desafios e o futuro da computação segura

Apesar de sua elegância, os Beaver Triples não são uma solução mágica para todos os problemas de privacidade. A gestão dessas triplas em sistemas de larga escala introduz novos desafios, como a necessidade de garantir que os geradores de triplas sejam honestos ou que o sistema seja resiliente a falhas em caso de corrupção de dados durante o pré-processamento. Além disso, o custo de armazenamento de grandes quantidades de triplas pode se tornar um fator limitante em dispositivos de borda ou ambientes com recursos restritos.

O que observaremos nos próximos anos é um foco crescente na otimização desses protocolos para torná-los mais acessíveis a desenvolvedores que não são especialistas em criptografia. Se a complexidade for abstraída por bibliotecas de software robustas, a computação multipartidária poderá deixar de ser um nicho acadêmico para se tornar um componente padrão na arquitetura de qualquer sistema que lide com dados sensíveis. A questão que permanece é se o mercado estará disposto a pagar o custo de performance adicional em troca dessa camada extra de garantia de privacidade.

A evolução da criptografia sempre foi um jogo de gato e rato entre a necessidade de utilidade e a exigência de sigilo. Os Beaver Triples, ao oferecerem uma estrutura matemática sólida para equilibrar essas duas forças, provam que a inovação muitas vezes não vem da criação de novos paradigmas, mas da otimização inteligente de operações fundamentais que, por muito tempo, foram consideradas um gargalo intransponível. A jornada da teoria para a prática ainda está em curso.

Com reportagem de Stoffel MPC

Source · Hacker News