A onipresença dos chatbots de inteligência artificial na rotina digital trouxe consigo um dilema de privacidade que, até pouco tempo, parecia restrito ao ecossistema das redes sociais e do comércio eletrônico. Uma investigação recente revelou que plataformas líderes do setor — incluindo ChatGPT, Claude, Grok e Perplexity — incorporam ativamente rastreadores de publicidade de grandes empresas como Meta, Google e TikTok. Essas ferramentas, desenhadas para mapear o comportamento do consumidor, agora possuem janelas de observação para o conteúdo das interações privadas realizadas pelos usuários com modelos de linguagem avançados.

O fenômeno marca uma mudança estrutural na forma como a privacidade é tratada no desenvolvimento de IA. Se a promessa inicial destas ferramentas era a de um assistente pessoal neutro e seguro, a realidade atual mostra que o modelo de negócios baseado em dados de terceiros encontrou nos chatbots um novo terreno fértil para a coleta de informações comportamentais. Segundo a reportagem do El País, a presença desses rastreadores não é apenas um detalhe técnico, mas uma estratégia de integração que coloca em risco a expectativa de confidencialidade que o usuário deposita ao digitar informações sensíveis ou estratégicas em um chat.

A mutação dos modelos de rastreamento

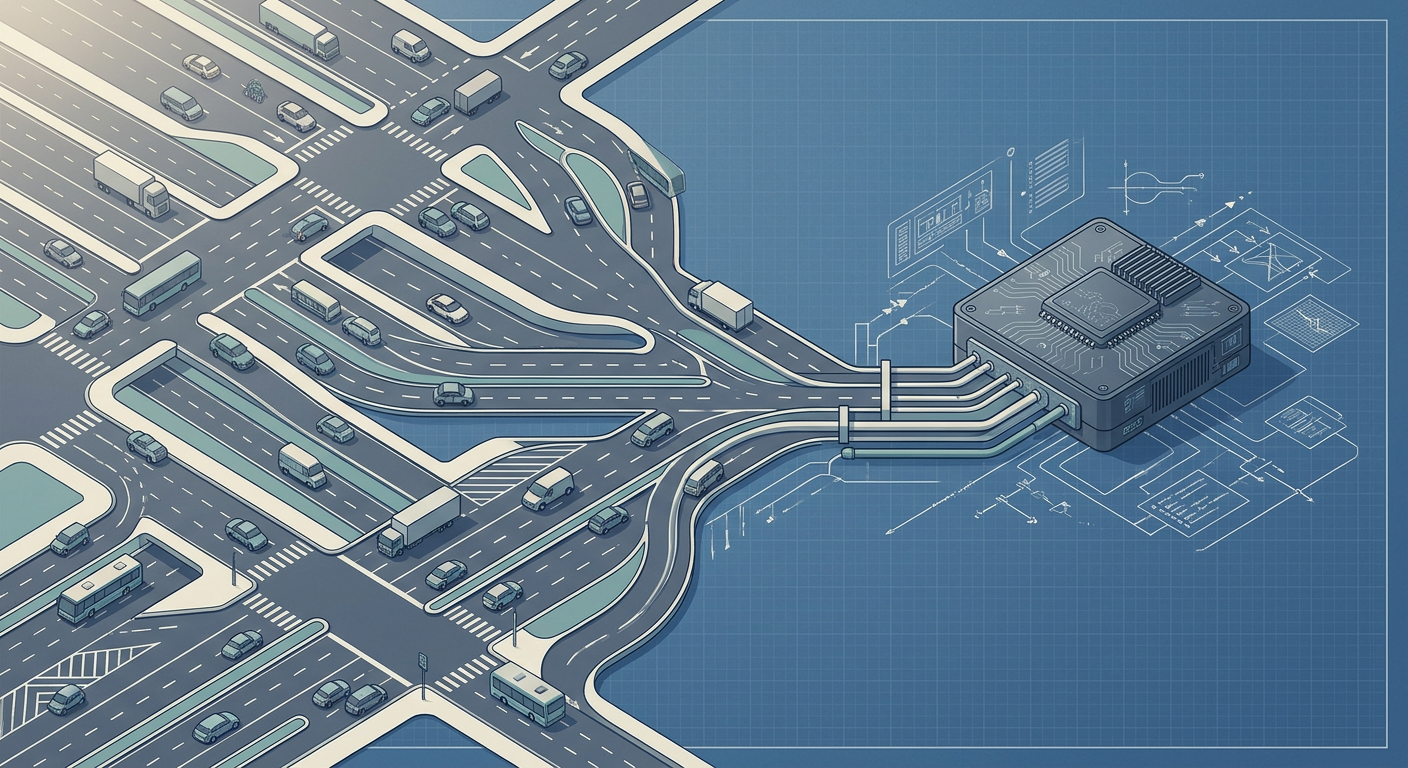

Historicamente, a web evoluiu sob a égide da publicidade direcionada, com cookies e pixels de rastreamento funcionando como a infraestrutura invisível que sustenta a economia digital. Quando os chatbots de IA foram introduzidos ao mercado, a percepção pública era de que a interação seria análoga a uma consulta privada, onde o processamento de linguagem natural ocorreria em um ambiente controlado. No entanto, a convergência entre as ferramentas de marketing digital e as interfaces de chat quebrou essa barreira, permitindo que o perfil do usuário seja enriquecido não apenas pelo que ele busca, mas pelo que ele confessa em conversas estruturadas.

Essa arquitetura de coleta de dados é particularmente problemática devido à natureza dos inputs fornecidos aos LLMs. Diferente de uma busca no Google, onde o usuário insere termos isolados, os chats de IA frequentemente contêm contextos detalhados, rascunhos de documentos corporativos ou reflexões pessoais profundas. A presença de rastreadores de terceiros nessas interfaces significa que a infraestrutura de vigilância digital de grandes conglomerados de tecnologia está, na prática, sendo alimentada por um fluxo de dados de alta densidade, transformando a conversa privada em um ativo de inteligência comercial.

O mecanismo da vigilância invisível

O funcionamento técnico desses rastreadores é relativamente simples, porém insidioso. Ao carregar a página ou o aplicativo do chatbot, o navegador do usuário executa scripts que se comunicam com servidores de terceiros. Esses scripts identificam o usuário e transmitem metadados sobre sua sessão. O risco reside no fato de que, ao vincular o comportamento de navegação ao histórico de interações dentro do chat, as empresas de publicidade conseguem construir um perfil psicográfico incrivelmente preciso, correlacionando interesses manifestos em conversas com hábitos de consumo observados em outros sites.

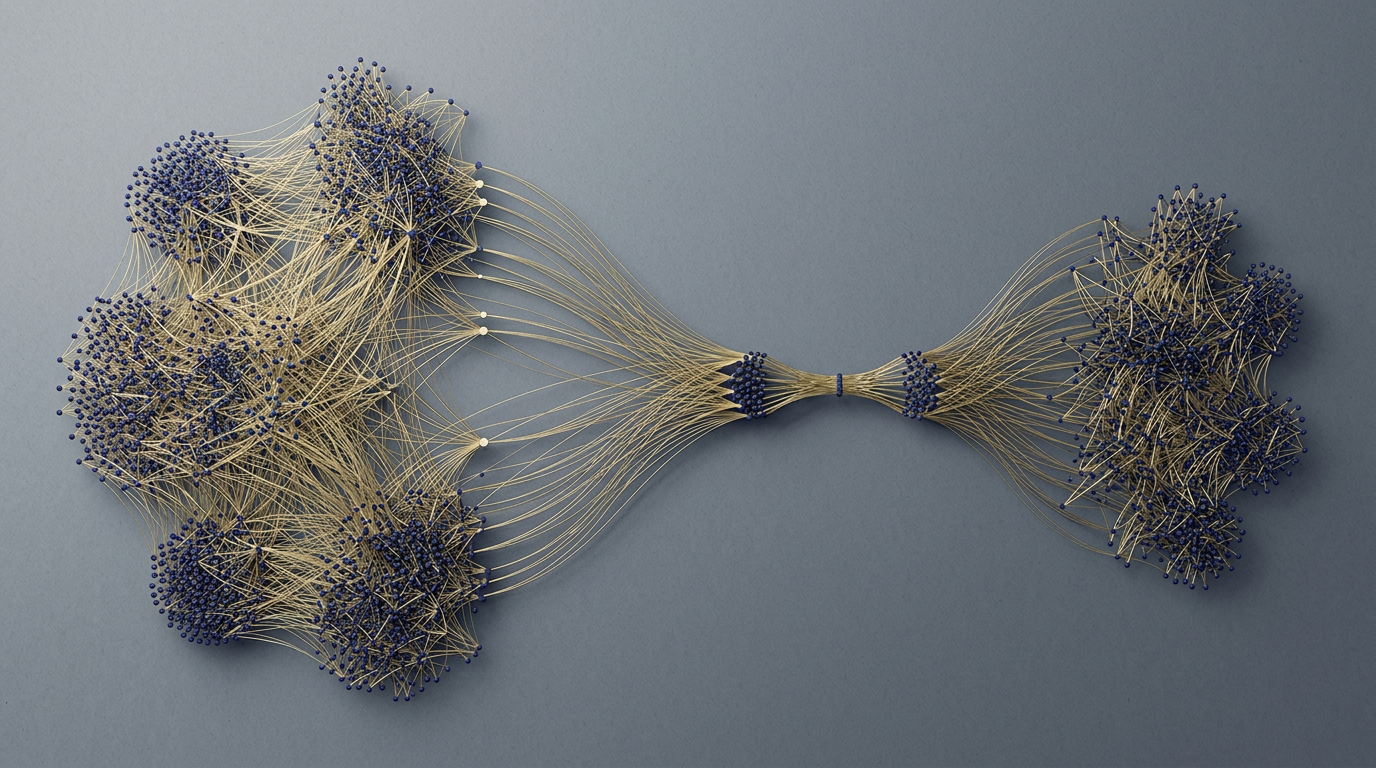

O incentivo econômico para essa prática é evidente, visto que a monetização de dados de alta qualidade é a espinha dorsal de muitas dessas empresas de tecnologia. Mesmo quando o desenvolvedor da IA afirma que não utiliza os dados para treinar seus modelos sem consentimento, a presença de rastreadores de terceiros cria uma vulnerabilidade colateral. A empresa de IA pode ser rigorosa com suas políticas internas, mas ao permitir a inclusão de SDKs ou scripts de terceiros, ela cede o controle sobre o fluxo de dados para entidades que operam sob uma lógica de mercado distinta e muito menos restritiva.

Tensões regulatórias e responsabilidade

Para os reguladores, o cenário apresenta um desafio complexo. Leis como a LGPD no Brasil e o GDPR na Europa estabelecem limites claros sobre a coleta de dados, mas a aplicação dessas normas em modelos de IA que utilizam rastreadores de terceiros ainda é uma área cinzenta. A responsabilidade por uma possível violação de privacidade torna-se difusa: seria do desenvolvedor da IA, que permitiu a instalação do rastreador, ou da empresa de publicidade, que coletou o dado? Essa indefinição jurídica favorece a inércia, enquanto os perfis de usuários continuam a ser construídos de forma granular.

Para as empresas, a pressão por transparência aumenta. Concorrentes que optarem por modelos de interface 'limpos', sem rastreamento de terceiros, poderão encontrar uma vantagem competitiva significativa em um mercado onde a confiança se torna o ativo mais escasso. O consumidor médio, por sua vez, encontra-se em uma posição de desvantagem, muitas vezes sem ferramentas eficazes para bloquear esses rastreadores sem comprometer a funcionalidade da ferramenta, revelando a urgência de uma discussão pública sobre a ética no design de interfaces de IA.

O futuro da privacidade em sistemas inteligentes

A questão central que permanece em aberto é se a integração entre publicidade e IA é um caminho sem volta ou uma fase de ajuste que será corrigida pela pressão do mercado e pela regulação. Se as empresas de IA continuarem a priorizar a receita publicitária em detrimento da privacidade do usuário, o custo de longo prazo pode ser a erosão da confiança necessária para a adoção massiva de tecnologias de automação. A observação constante de como essas plataformas evoluem e se adaptam — ou resistem — a essas críticas será o termômetro para a maturidade do setor nos próximos anos.

Além disso, resta saber se o desenvolvimento de navegadores e extensões focados em privacidade será suficiente para mitigar os riscos ou se será necessária uma intervenção estatal mais incisiva para proibir a presença de rastreadores em ambientes de processamento de dados sensíveis. A tecnologia de IA não deve ser tratada apenas como uma nova camada de software, mas como um ambiente que exige padrões de segurança superiores aos da web tradicional, dada a natureza da informação que nela é processada. A trajetória das próximas atualizações dessas plataformas indicará qual direção o setor pretende seguir.

A fronteira entre a utilidade da IA e a invasão de privacidade parece estar se tornando cada vez mais tênue, forçando usuários e reguladores a reavaliarem o que é aceitável em nome da inovação. O debate sobre a presença desses rastreadores é apenas o primeiro capítulo de uma discussão mais ampla sobre a soberania dos dados pessoais em um mundo mediado por máquinas que aprendem com cada interação. Com reportagem de El País

Source · El País Tecnología