A proliferação de agentes de inteligência artificial no fluxo de trabalho de engenharia de software trouxe uma eficiência sem precedentes, mas também criou um novo tipo de dívida técnica: a invisibilidade operacional. Enquanto desenvolvedores humanos operam sob o rigor do controle de versão, confiando em commits e logs para auditar mudanças, os agentes de IA frequentemente operam em uma caixa preta de execução contínua. Quando um agente altera arquivos, deleta diretórios ou refatora lógica de negócio, a pergunta fundamental — 'por que isso foi feito?' — muitas vezes permanece sem resposta, deixando equipes de desenvolvimento em um estado de incerteza sobre a integridade de seus sistemas.

Essa lacuna na governança de agentes autônomos motivou o surgimento de iniciativas que buscam transpor a lógica dos sistemas de controle de versão (VCS) para o domínio da automação inteligente. O projeto open source 're_gent', recentemente apresentado à comunidade técnica, propõe uma estrutura para registrar e auditar as ações de agentes como o Claude Code. Ao tratar a sequência de comandos e decisões de um agente como um fluxo versionável, a ferramenta tenta oferecer recursos análogos ao 'git bisect' ou ao histórico de commits, permitindo que desenvolvedores retrocedam ou compreendam a genealogia de uma alteração realizada por um modelo de linguagem em sessões de trabalho complexas.

A falha estrutural na autonomia das máquinas

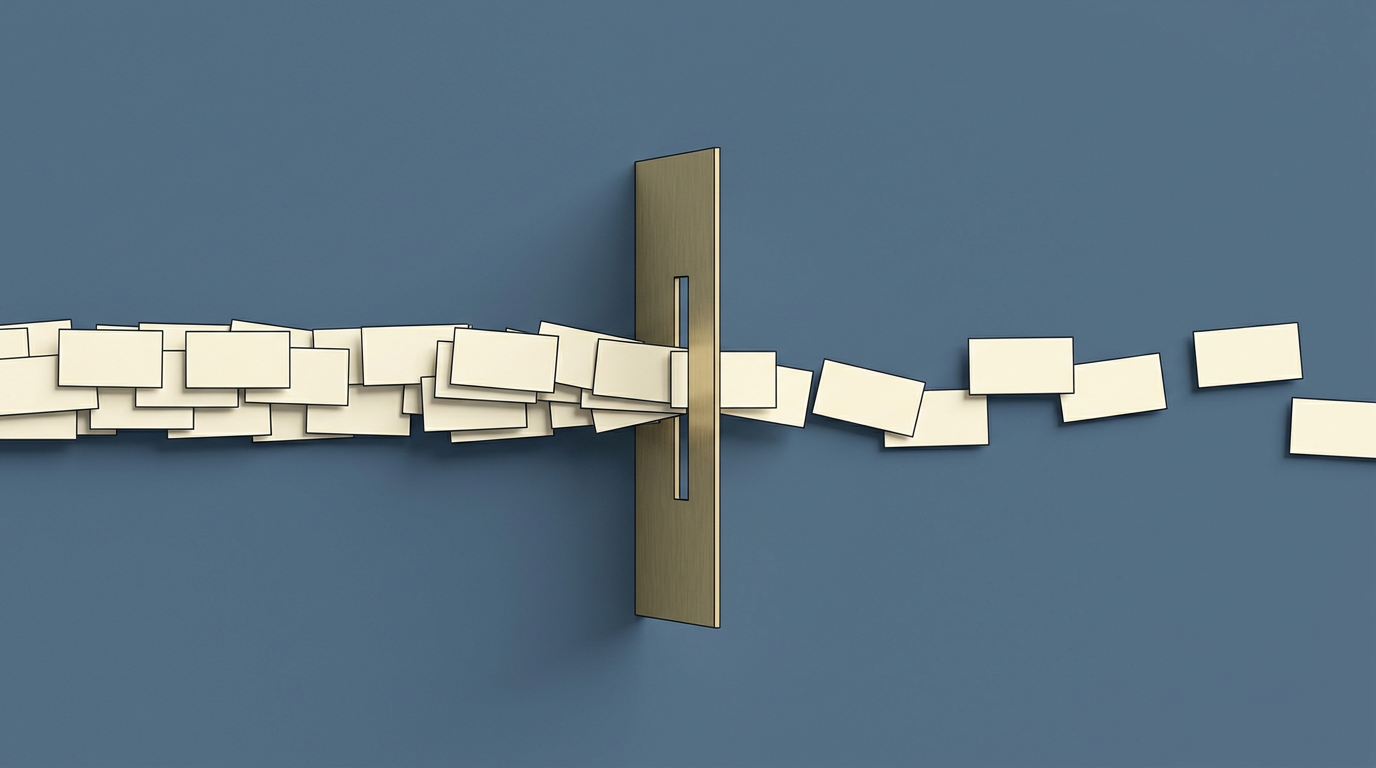

O desafio reside na natureza fundamentalmente não linear das interações com Large Language Models. Diferente de um script tradicional, que executa instruções fixas, um agente de IA toma decisões baseadas em contexto e probabilidade. Quando um agente executa uma tarefa, ele gera um rastro de raciocínio que é, por definição, efêmero e volátil. A ausência de uma camada de persistência que capture o 'estado mental' do agente antes e depois de cada ação impede que humanos realizem uma auditoria pós-execução, tornando a depuração um processo de tentativa e erro, em vez de uma análise metódica de logs.

Historicamente, a computação evoluiu através da capacidade de replicar e reverter estados. O Git tornou-se o padrão da indústria porque resolveu o problema da colaboração humana em sistemas complexos. Ao trazer essa mentalidade para o ecossistema de agentes, a comunidade de desenvolvimento está, na verdade, reconhecendo que a autonomia da IA não pode prescindir da responsabilidade técnica. Se um agente é capaz de modificar o código-fonte de uma aplicação crítica, ele deve estar sujeito aos mesmos padrões de transparência e rastreabilidade que qualquer engenheiro humano, sob pena de tornar a base de código um labirinto de mudanças inexplicáveis.

Mecanismos de controle e a busca pela rastreabilidade

O mecanismo proposto por ferramentas de versionamento de agentes baseia-se na captura sistemática de cada interação entre o modelo e o ambiente de desenvolvimento. Ao interceptar os comandos enviados pelo agente e as respostas do sistema de arquivos, o software cria um grafo de dependências e decisões. Isso permite que o usuário não apenas veja o que mudou, mas também o contexto argumentativo — o 'porquê' — que levou o modelo a uma determinada conclusão. É uma tentativa de externalizar a memória de trabalho do agente, transformando o raciocínio oculto em um log auditável.

Essa abordagem altera a dinâmica de interação. Em vez de uma relação de 'comando e resposta', o desenvolvedor passa a atuar como um supervisor de um sistema versionado. Se o agente comete um erro ou toma uma decisão subótima, o usuário pode realizar um 'rewind' ou uma análise comparativa de sessões anteriores. A complexidade técnica desse processo é elevada, pois exige uma integração profunda com os ambientes de desenvolvimento (IDEs) e uma compreensão clara da estrutura de estados que os agentes manipulam. A eficácia desse modelo dependerá, em última análise, da capacidade de padronizar como esses logs são armazenados e consultados em diferentes arquiteturas de agentes.

Implicações para a governança de software

Para as empresas que integram agentes de IA em seus ciclos de CI/CD, a adoção de ferramentas de rastreamento é uma questão de conformidade e segurança. Reguladores e departamentos de TI exigirão, cada vez mais, que qualquer alteração em sistemas de produção seja rastreável a uma intenção clara, seja ela humana ou algorítmica. A introdução de um 'Git para Agentes' oferece um caminho para atender a essas exigências, mitigando o risco de comportamentos inesperados em ambientes de alta criticidade. Concorrentes no espaço de ferramentas para desenvolvedores provavelmente seguirão esse caminho, integrando recursos de auditoria nativamente em seus copilotos e agentes de automação.

No ecossistema brasileiro, onde a adoção de IA em empresas de tecnologia tem sido rápida, a implementação dessas práticas de governança pode definir a diferença entre fluxos de trabalho resilientes e sistemas propensos a falhas de difícil diagnóstico. A transição para uma engenharia assistida por IA exige, portanto, que a disciplina de versionamento evolua junto com a capacidade de processamento. O foco deve ser garantir que a agilidade proporcionada pelos agentes não comprometa a estabilidade que o controle de versão tradicional levou décadas para consolidar.

O futuro da auditoria algorítmica

Ainda permanece incerto se uma solução única de versionamento conseguirá cobrir a diversidade de agentes existentes. A fragmentação dos modelos e a variedade de ambientes onde eles operam dificultam a criação de um padrão universal. Além disso, o custo computacional de registrar cada passo de um agente pode se tornar um gargalo para aplicações que exigem alta performance e baixa latência na execução de tarefas complexas.

O que se observa é apenas o início de uma necessidade latente: a necessidade de 'accountability' para sistemas autônomos. À medida que os agentes ganham mais autonomia para realizar mudanças em infraestruturas, a capacidade de auditar suas decisões deixará de ser um diferencial técnico para se tornar um requisito de sobrevivência operacional. Observar como esses projetos de código aberto evoluem nos próximos meses será fundamental para entender se estamos caminhando para uma padronização ou para um mercado de ferramentas fragmentadas.

A questão que fica para a comunidade é se a transparência será uma funcionalidade integrada ou uma camada adicional que os desenvolvedores terão que gerenciar manualmente. A resposta definirá a velocidade com que as organizações confiarão o controle total de seus sistemas a agentes inteligentes, equilibrando o desejo por automação com a necessidade humana de controle e compreensão sobre o código que sustenta a economia digital.

Com reportagem de Hacker News

Source · Hacker News