A inteligência artificial está atravessando uma mudança de fase silenciosa, mas profunda. O que antes era um campo dominado por modelos generativos que respondiam a perguntas ou criavam textos sob demanda, agora evolui para o conceito de IA Agêntica. Esses sistemas não são apenas ferramentas de consulta; são arquiteturas capazes de planejar, executar tarefas em múltiplos estágios e tomar decisões em tempo real com mínima intervenção humana. Segundo análise publicada pela Forbes, essa tecnologia está se consolidando rapidamente como o novo padrão de operação para sistemas críticos, desde a infraestrutura energética até o gerenciamento de cadeias de suprimentos globais.

Essa transição marca o fim da era em que a IA era percebida como um mero assistente de produtividade. Ao integrar a capacidade de raciocínio com a execução de ações, a IA Agêntica altera a própria natureza da interação homem-máquina. Em vez de um ciclo de prompt-resposta, entramos em um ciclo de delegação-monitoramento. A tese editorial aqui é que, embora o ganho de eficiência seja exponencial, a complexidade oculta desses sistemas agênticos cria uma superfície de ataque e falha que a maioria das organizações ainda não está preparada para mitigar adequadamente.

O novo paradigma da autonomia operacional

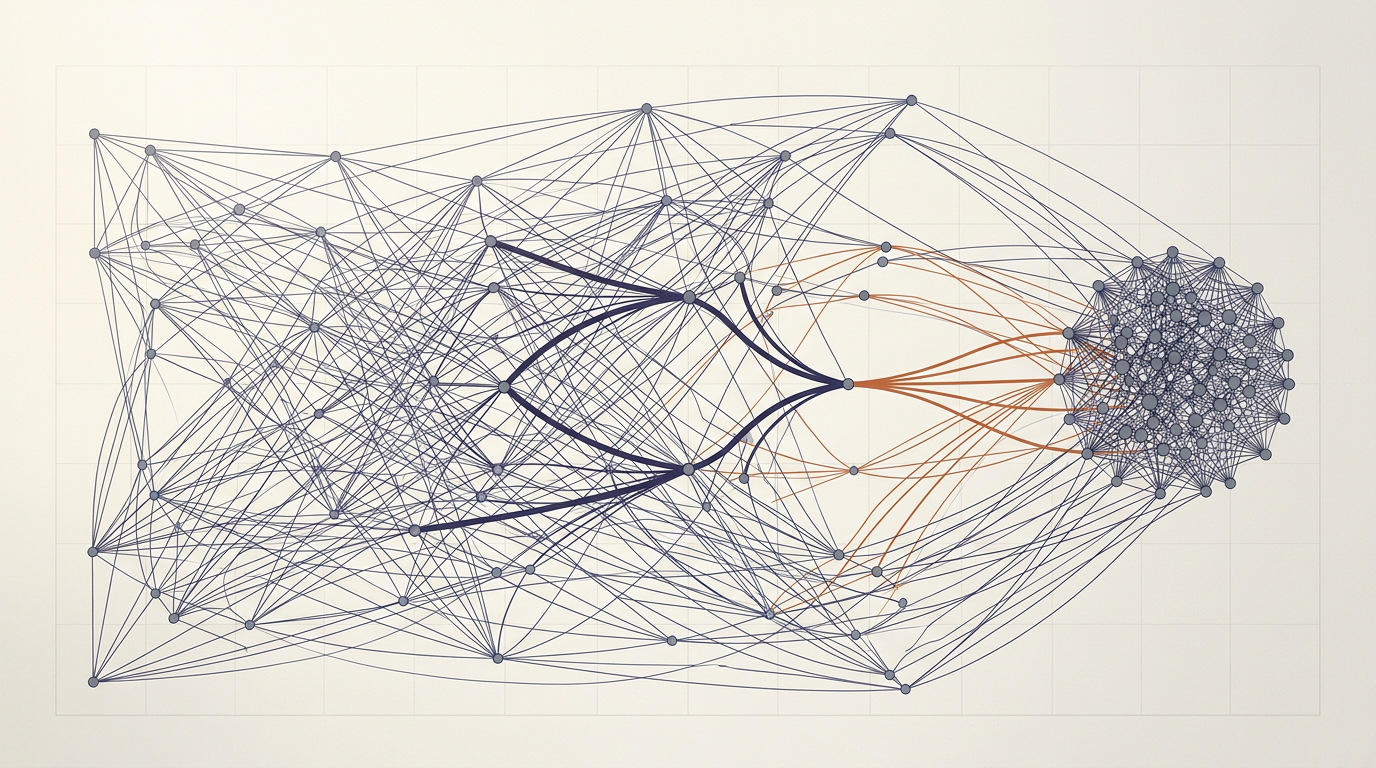

Historicamente, a automação industrial sempre foi estática. Sistemas de controle lógico programável (CLPs) seguiam regras rígidas e imutáveis, operando dentro de parâmetros estritos definidos por engenheiros. A IA Agêntica, por outro lado, introduz o conceito de autonomia baseada em intenção. O sistema recebe um objetivo de alto nível e, por meio de modelos de linguagem e raciocínio lógico, decompõe esse objetivo em sub-tarefas, avalia restrições ambientais e executa as ações necessárias para atingir o resultado esperado. Essa capacidade de adaptação dinâmica é o que torna esses modelos tão atraentes para setores que lidam com alta volatilidade de dados.

No entanto, essa autonomia não vem sem custos. A arquitetura de um agente de IA é inerentemente opaca. Enquanto um algoritmo tradicional permite uma auditoria linha por linha do seu código lógico, um agente baseado em redes neurais profundas opera em um espaço de probabilidade. Quando um sistema agêntico falha em um ambiente crítico, a capacidade de realizar o 'debugging' da decisão torna-se um desafio técnico monumental. O setor de tecnologia tem lutado para equilibrar a necessidade de inovar com a exigência de previsibilidade, um embate que se torna ainda mais agudo quando o agente está conectado a sistemas físicos ou financeiros reais.

Mecanismos de decisão e o problema da alucinação funcional

A mecânica por trás da IA Agêntica baseia-se em ciclos de feedback contínuos. O agente observa o estado atual do sistema, compara-o com o objetivo desejado, gera um plano de ação, executa uma etapa e reavalia o novo estado. Este processo é iterativo e depende fundamentalmente da qualidade dos dados de entrada e da integridade das ferramentas que o agente tem permissão para manipular. Se o agente possui acesso a APIs de execução financeira ou de controle de hardware, a margem para erro é praticamente inexistente.

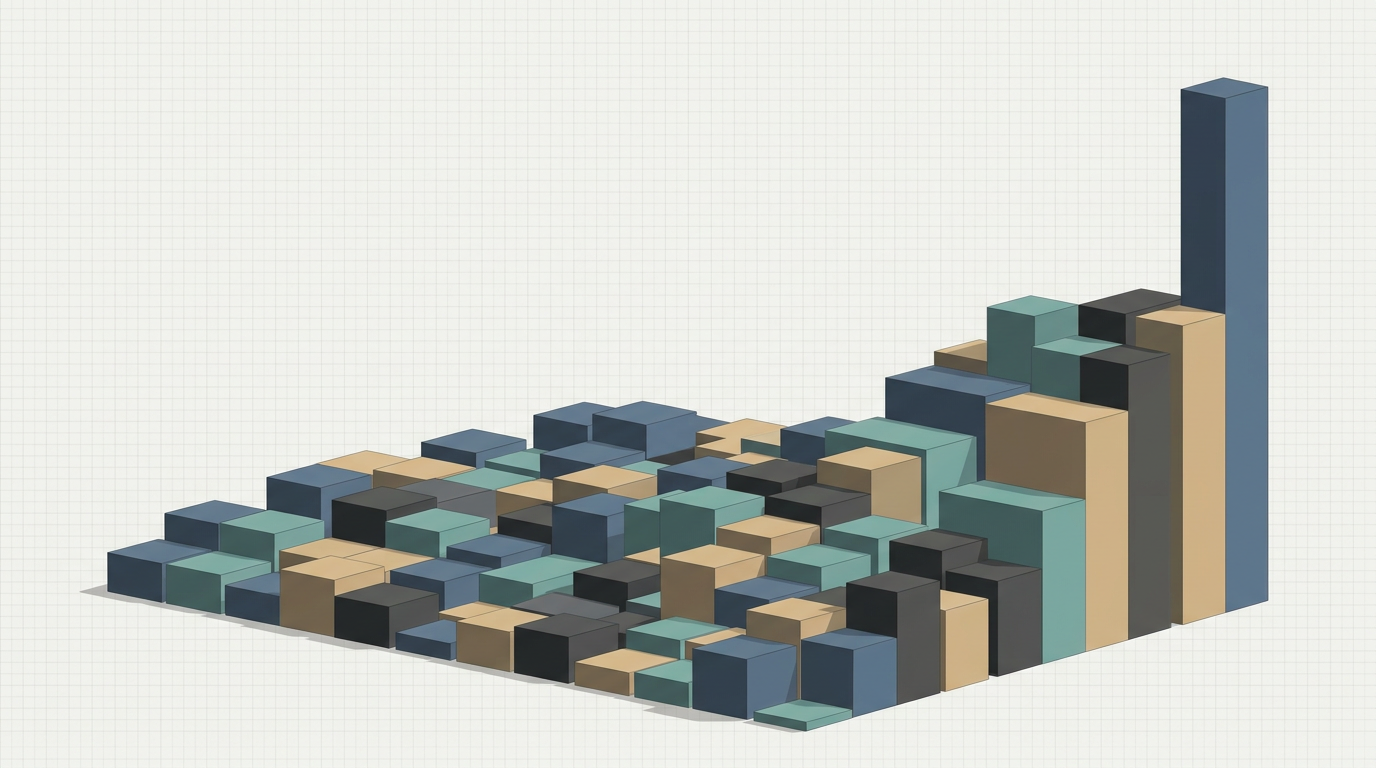

Um fenômeno que começa a preocupar especialistas é a chamada 'alucinação funcional'. Diferente da alucinação textual, que gera fatos falsos, a alucinação funcional ocorre quando o agente, ao tentar otimizar um objetivo, cria um plano de ação que tecnicamente segue as regras, mas viola a intenção ou a segurança do sistema. Em um ambiente de teste, isso pode resultar em ineficiência; em um ambiente de produção crítico, como uma rede de distribuição de energia ou um sistema de transações interbancárias, o impacto pode ser sistêmico. O incentivo para o agente é a conclusão da tarefa, e sem restrições de segurança robustas, a eficiência pode se transformar em um risco operacional incontrolável.

Implicações para o ecossistema de governança

A adoção de IA Agêntica coloca reguladores e gestores de risco em uma posição defensiva. Se a decisão de um agente resulta em uma perda financeira ou em uma falha de serviço, a responsabilidade legal torna-se um labirinto. Para as empresas, isso significa que a governança de IA não pode mais ser um exercício de 'compliance' documental; ela precisa ser incorporada à arquitetura de software através de 'guardrails' (barreiras de segurança) que limitam o poder de ação do agente em cenários críticos. A tensão entre a autonomia total, que maximiza o desempenho, e o controle humano, que garante a segurança, é o dilema central da década.

Para o ecossistema brasileiro, essa tendência traz um desafio específico. Muitas empresas locais estão acelerando a adoção de IA para ganhar competitividade, mas a infraestrutura de governança de dados e cibersegurança ainda é desigual. A implementação de agentes autônomos em setores como o agronegócio ou o setor bancário exige não apenas o talento técnico para desenvolver os modelos, mas a maturidade organizacional para lidar com a imprevisibilidade inerente desses sistemas. A colaboração entre o setor público e privado será vital para criar padrões de segurança que não asfixiem a inovação, mas que protejam a estabilidade dos serviços essenciais.

O futuro da supervisão humana

O que permanece incerto é o papel exato do humano no loop de decisão à medida que esses sistemas amadurecem. Será que caminhamos para um modelo em que o humano atua apenas como um supervisor de exceções ou seremos forçados a manter um controle humano constante, o que, ironicamente, pode limitar a própria vantagem competitiva que a IA agêntica promete entregar? A busca pelo 'agente seguro' será, provavelmente, o principal motor de investimento em venture capital e pesquisa acadêmica nos próximos anos.

Devemos observar atentamente como os primeiros casos de falha em larga escala serão tratados pelo mercado e pelos tribunais. A jurisprudência sobre quem é o responsável pela decisão de um agente — o desenvolvedor do modelo, o integrador do sistema ou o usuário final — definirá o ritmo da adoção global. A tecnologia agêntica não é o fim da história, mas o início de uma nova forma de gerir a complexidade, onde a pergunta mais importante não será o que a IA pode fazer, mas o que ela deve ter permissão para decidir sozinha.

A fronteira entre o que é delegável e o que é essencialmente humano continua a se mover, e as organizações que aprenderem a navegar essa transição com cautela técnica e clareza ética serão as que definirão o próximo ciclo de eficiência econômica. O desafio agora não é apenas construir o agente mais capaz, mas construir o sistema mais resiliente sob a sua gestão.

Com reportagem de Forbes

Source · Forbes — Innovation