A adoção acelerada da inteligência artificial recolocou a tecnologia no centro das agendas corporativas, mas o debate ainda permanece capturado por uma lógica de fascínio instrumental. Muitas organizações operam sob a premissa equivocada de que a simples incorporação de ferramentas avançadas basta para produzir eficiência, qualidade decisória e ganhos de produtividade. Segundo reportagem da MIT Technology Review Brasil, esse raciocínio ignora os pilares que efetivamente condicionam a geração de valor: processos bem desenhados, governança proporcional ao risco e equipes aptas a operar e supervisionar a tecnologia.

Sem a definição clara do problema a ser resolvido ou o devido redesenho dos fluxos de trabalho, surge um descompasso entre a promessa técnica e o resultado organizacional. A literatura empírica recente sugere que os ganhos associados à IA dependem menos da disponibilidade da ferramenta e mais de sua inserção em estruturas operacionais onde profissionais capacitados possam contestar e validar as saídas algorítmicas quando necessário.

O abismo entre teoria e prática

A distinção entre capacidade técnica e uso efetivo é ilustrada por um estudo da Anthropic sobre o mercado de trabalho, que introduz a métrica de "exposição observada". Os dados revelam que o uso real de IA permanece significativamente abaixo do potencial teórico, mesmo em setores altamente expostos como computação e matemática, onde a adoção observada alcançou apenas cerca de 33% das tarefas. O estudo aponta que, em áreas como desenvolvimento de software e atendimento ao cliente, a substituição integral do trabalho humano não se materializou na escala prevista pelo ciclo de expectativas.

Esse cenário revela um problema central de gestão. Muitas atividades, embora tecnicamente automatizáveis, permanecem sob controle humano devido a restrições legais, exigências de integração entre sistemas legados e a necessidade crítica de validação em etapas sensíveis. A inovação, portanto, não reside na ferramenta em si, mas na capacidade da organização de adaptar suas rotinas de verificação para integrar a tecnologia sem comprometer a integridade dos processos.

Riscos de segurança e a falibilidade técnica

A adoção apressada também amplia a exposição a riscos de segurança e falhas operacionais. O International AI Safety Report 2026 observa que sistemas de IA de propósito geral possuem capacidades irregulares, podendo superar especialistas em problemas complexos e falhar em tarefas lógicas simples. Essa assimetria torna a confiança excessiva na tecnologia uma escolha temerária.

No campo da cibersegurança, o Global Cybersecurity Outlook 2025 do Fórum Econômico Mundial destaca que a IA está sendo utilizada para escalar ataques de engenharia social e identificar vulnerabilidades. Além das ameaças externas, há o risco de mau funcionamento sistêmico. A introdução de agentes autônomos eleva a gravidade, pois falhas podem produzir efeitos concretos antes de qualquer intervenção humana, tornando o redesenho de processos com auditoria manual um imperativo de segurança.

O impacto sobre o capital humano

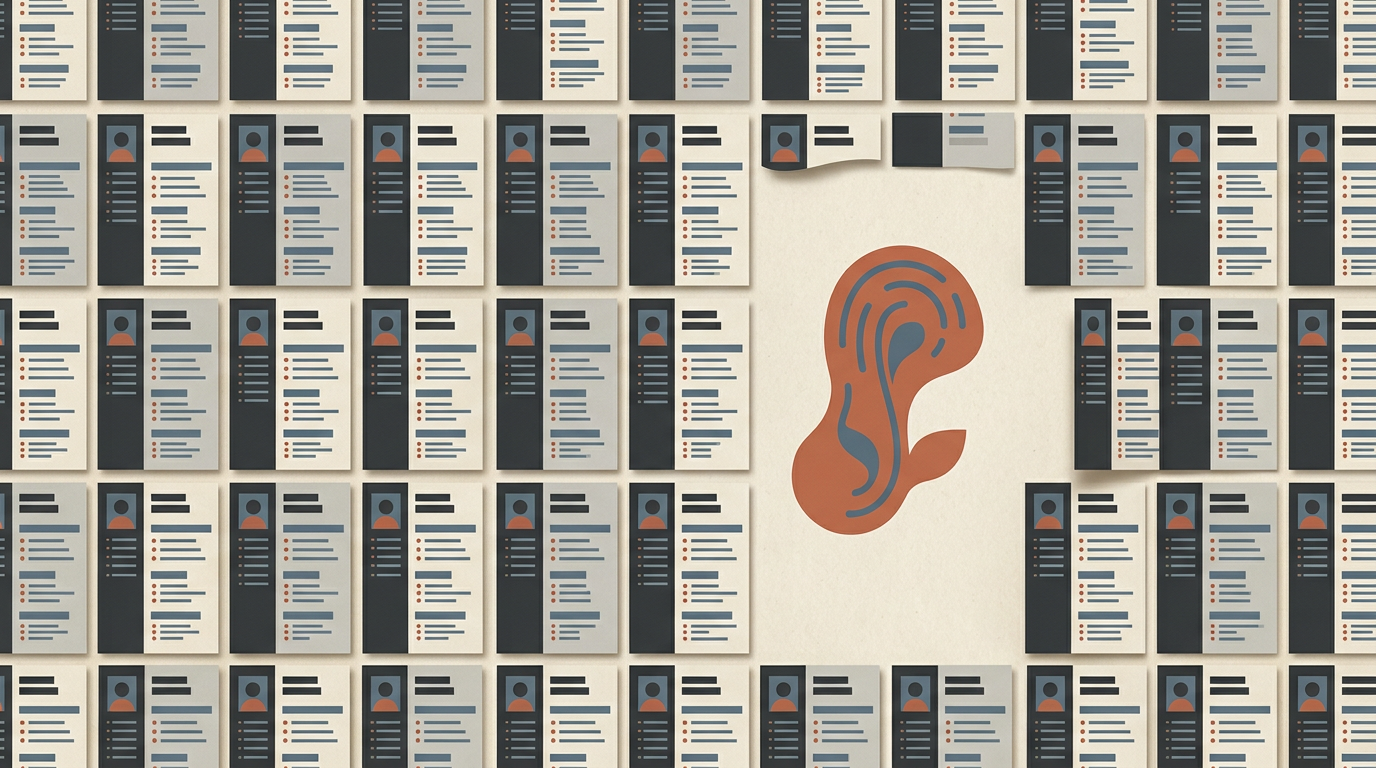

O terceiro pilar negligenciado é o fator humano. A introdução de sistemas algorítmicos sem capacitação adequada produz riscos à autonomia profissional. Um estudo clínico publicado no The Lancet Gastroenterology & Hepatology observou que a exposição prolongada a sistemas de apoio diagnóstico por IA pode levar à queda no desempenho dos médicos quando operam sem o auxílio da ferramenta. O achado sugere que a adoção acrítica pode induzir dependência funcional e enfraquecimento de habilidades decisórias.

Além disso, o viés de automação — a tendência de confiar excessivamente no sistema e evitar o esforço de confrontar resultados com evidências divergentes — representa uma ameaça à resiliência cognitiva das equipes. Sem o mapeamento desses efeitos, a organização corre o risco de comprometer o senso crítico e a responsabilidade decisória de seus colaboradores, deslocando a inteligência coletiva em favor de uma dependência tecnológica pouco reflexiva.

Governança como vantagem competitiva

Superar esse modelo exige uma abordagem de governança baseada na arquitetura de defesa em profundidade. Isso implica combinar múltiplas camadas de salvaguardas técnicas e humanas, como a curadoria de dados, o monitoramento obrigatório de decisões críticas e a rastreabilidade de incidentes. O Preparedness Framework da OpenAI e a Responsible Scaling Policy da Anthropic exemplificam essa tendência, estabelecendo compromissos condicionais onde o aumento de capacidades deve ser acompanhado por medidas de mitigação.

As organizações que se destacarão na próxima década serão aquelas que construírem capacidade institucional para operar sob condições persistentes de incerteza. A questão central deixa de ser a previsão de um futuro determinado e passa a ser a construção de resiliência societal e organizacional, garantindo que a tecnologia atue como habilitadora de problemas de negócio claramente definidos, mantendo o controle humano e a responsabilidade sobre o resultado final.

O valor da inteligência artificial não é uma propriedade intrínseca do algoritmo, mas um subproduto de uma implementação disciplinada que equilibra inovação com segurança e rigor operacional. À medida que os agentes autônomos ganham terreno, a capacidade de manter o ceticismo profissional e a supervisão ativa definirá quais empresas conseguem converter a promessa técnica em vantagem competitiva sustentável e quais ficarão presas no ciclo de expectativas não cumpridas. Com reportagem de MIT Tech Review Brasil

Source · MIT Tech Review Brasil