A startup Cactus anunciou o lançamento do Needle, um modelo de linguagem de apenas 26 milhões de parâmetros otimizado especificamente para a execução de ferramentas, ou 'tool calling'. O projeto, disponibilizado sob licença MIT, promete velocidades de processamento de até 6.000 tokens por segundo na fase de prefill e 1.200 tokens por segundo na decodificação, rodando localmente em dispositivos de consumo como smartphones e dispositivos vestíveis, segundo o repositório do projeto.

Segundo a equipe responsável, a motivação central para o desenvolvimento foi a percepção de que modelos de grande escala são redundantes para a tarefa de conectar agentes de IA a funções externas. A tese aqui é que, ao isolar o processo de extração de argumentos e mapeamento de consultas em uma estrutura de rede neural extremamente enxuta, é possível viabilizar experiências inteligentes em hardware com recursos limitados de memória e processamento.

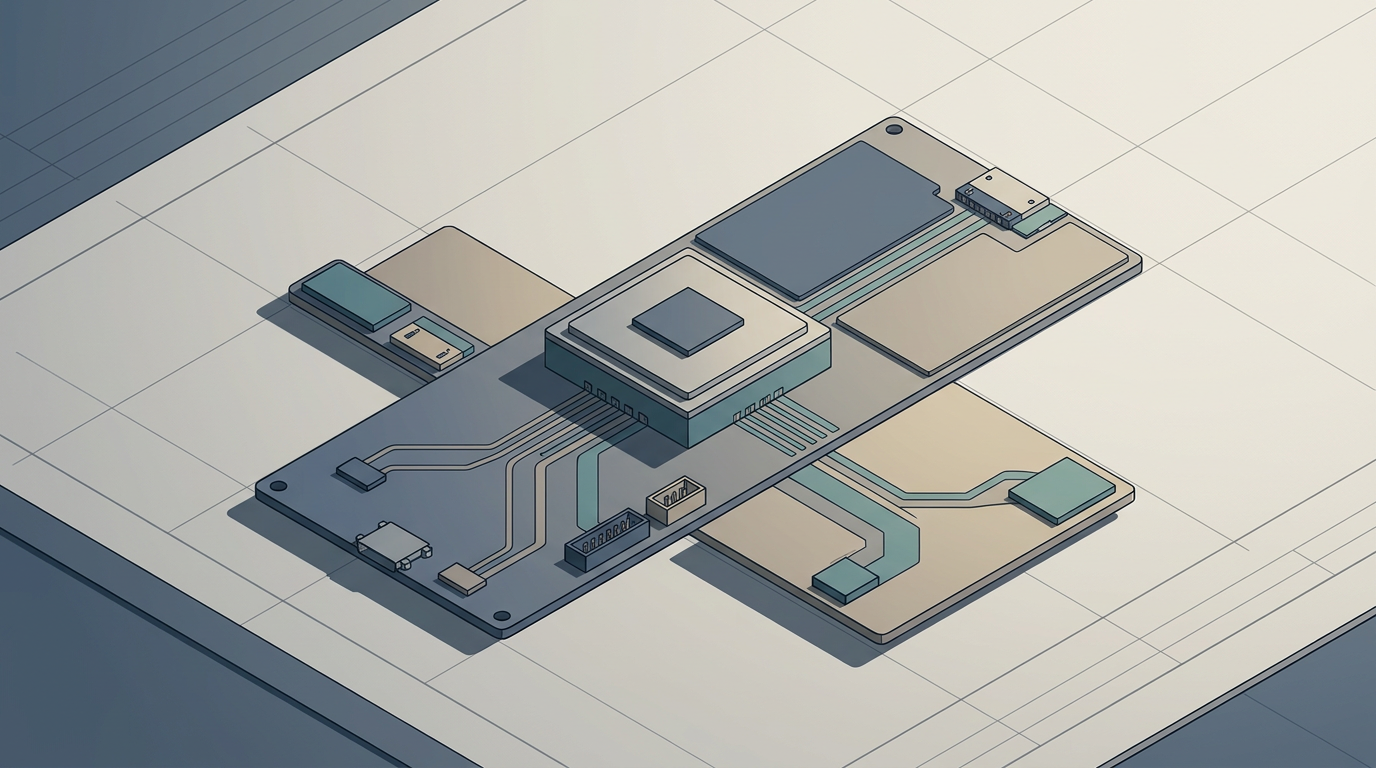

A arquitetura por trás da eficiência

O diferencial técnico do Needle reside na eliminação dos Feed-Forward Networks (FFNs), componentes que tradicionalmente ocupam a maior parte da capacidade de memória em modelos de linguagem. A equipe da Cactus argumenta que, em tarefas de uso de ferramentas, o modelo não precisa memorizar fatos, mas sim realizar uma operação de recuperação e montagem de dados. Ao remover os FFNs e focar quase inteiramente em mecanismos de atenção e gating, o modelo reduz drasticamente seu footprint computacional.

Essa abordagem de 'redes de atenção simples' sugere uma mudança na forma como desenvolvedores encaram o design de modelos para tarefas específicas. Em vez de tentar comprimir o conhecimento do mundo em parâmetros de peso, o modelo atua como um processador de fluxo de dados. A análise indica que essa arquitetura pode ser estendida para outros cenários onde o acesso a conhecimento estruturado externo é predominante, como em sistemas de recuperação aumentada por geração (RAG).

O papel do tool calling na era dos agentes

O 'tool calling' é fundamental para a transição de chatbots passivos para agentes capazes de realizar ações, como configurar timers, gerenciar automação residencial ou enviar mensagens. A estratégia da Cactus ao sintetizar dados de treinamento via Gemini, cobrindo 15 categorias de funções, demonstra como a destilação de capacidades de modelos maiores pode ser direcionada para tarefas de nicho, segundo o repositório. A eficácia dessa técnica depende, contudo, da qualidade dos dados sintéticos e da capacidade do modelo em manter a precisão na identificação e extração de argumentos.

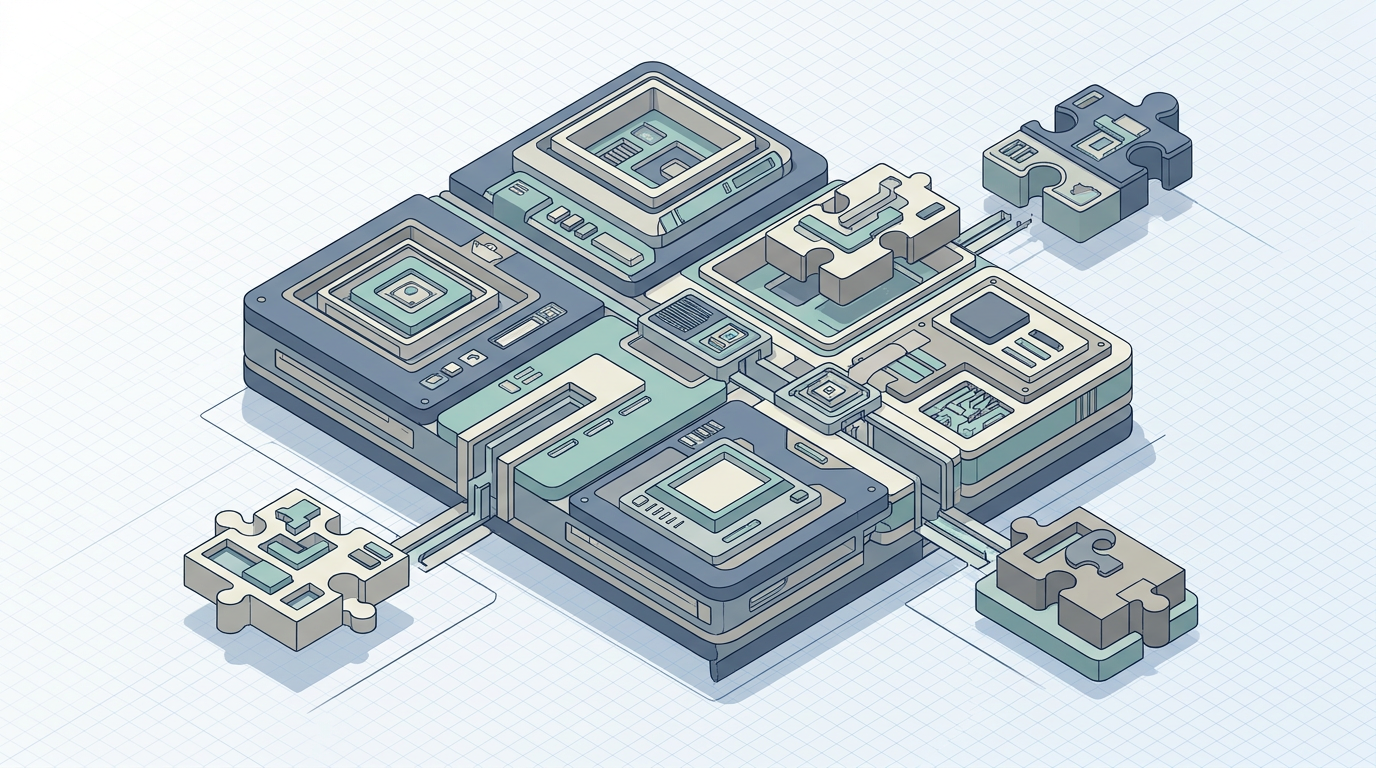

Nos resultados reportados pela Cactus, ao comparar o Needle com modelos como FunctionGemma-270M ou Qwen-0.6B, observa-se que, embora o Needle supere seus concorrentes em single-shot function calling, ele carece da versatilidade conversacional desses modelos maiores. Esse compromisso é um lembrete de que a especialização extrema pode limitar a utilidade do modelo em contextos mais amplos de diálogo, onde a compreensão semântica profunda é necessária para além da execução de comandos.

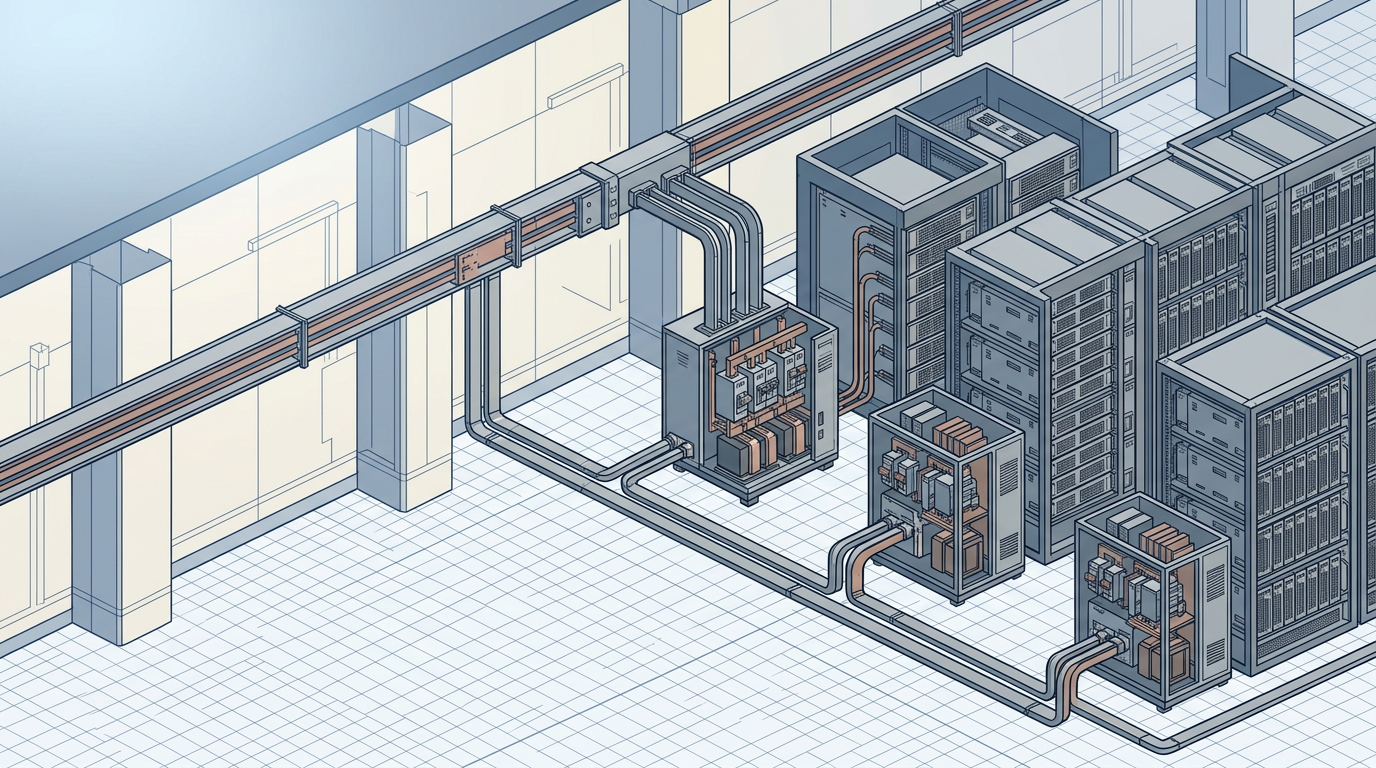

Implicações para o ecossistema de dispositivos

Para reguladores e fabricantes de hardware, a viabilidade de rodar modelos de IA úteis localmente representa uma mudança significativa na privacidade e na latência das aplicações. Ao processar dados de tool calling diretamente no dispositivo, o Needle minimiza a necessidade de enviar requisições sensíveis a servidores externos. Isso alinha-se a uma tendência crescente no setor de tecnologia, onde a computação de borda (edge computing) ganha prioridade estratégica.

Concorrentes no setor de infraestrutura de inferência, como desenvolvedores de motores otimizados para mobile, devem observar com atenção o desempenho do Cactus. Se a arquitetura sem FFN provar ser robusta em testes de campo, poderemos ver uma fragmentação maior do mercado de modelos, com soluções ultra-leves coexistindo com modelos de uso geral para tarefas específicas de sistema operacional.

Perspectivas e incertezas técnicas

O que permanece incerto é a capacidade de generalização desse modelo para ferramentas não previstas no conjunto de treinamento original. A eficácia de modelos de 26 milhões de parâmetros em ambientes de produção real, com ruído de entrada e variabilidade de linguagem, ainda precisa ser validada além dos benchmarks controlados. A observação contínua de como a comunidade irá realizar o fine-tuning desse modelo será determinante para sua adoção.

O futuro do Needle dependerá da aceitação de desenvolvedores que buscam integrar inteligência em hardware restrito sem o custo de latência de nuvem. A evolução deste projeto pode ditar novos padrões para o design de agentes locais, desafiando a hegemonia dos modelos de linguagem generalistas em tarefas de automação simples e recorrentes.

Fonte: repositório oficial no GitHub (https://github.com/cactus-compute/needle)

Source · Hacker News