A euforia inicial que acompanhou a democratização dos grandes modelos de linguagem (LLMs) nas estruturas empresariais parece estar dando lugar a um período de reavaliação pragmática. Segundo reportagem publicada pela Inc. Magazine, o entusiasmo em torno da automação de processos via IA generativa está encontrando obstáculos severos, evidenciando que a promessa de uma ferramenta universal para gestão corporativa era, em grande parte, uma construção baseada em expectativas desproporcionais.

O problema não reside na tecnologia em si, mas na desconexão entre a natureza probabilística dos modelos de linguagem e a natureza determinística exigida pelos sistemas de governança, conformidade e operação de uma empresa. Enquanto o mercado investiu bilhões em integrações rápidas, a realidade operacional tem demonstrado que essas ferramentas, embora proficientes em tarefas criativas e síntese de dados, frequentemente falham quando a precisão e a rastreabilidade são condições inegociáveis para a continuidade do negócio.

A natureza probabilística versus o rigor corporativo

Para compreender a causa dessas falhas, é preciso observar que os LLMs foram arquitetados para prever a próxima unidade de texto mais provável em uma sequência, não para processar lógica de negócios ou garantir a integridade de dados financeiros. Em um ambiente corporativo, onde a auditoria e a precisão são pilares, a característica intrínseca de 'alucinação' ou imprecisão estatística dos modelos torna-se um passivo de risco considerável, e não apenas um erro técnico pontual.

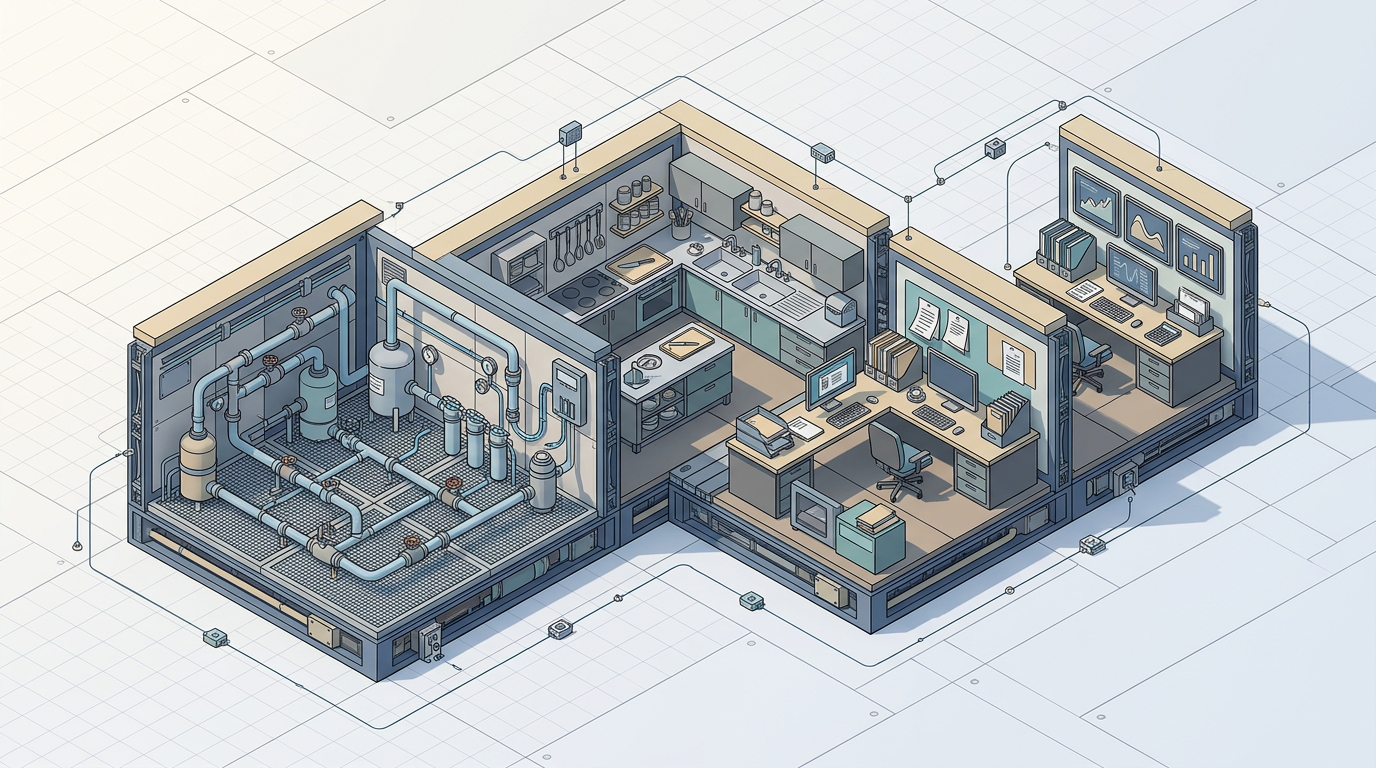

Historicamente, o software corporativo foi desenhado sobre bancos de dados relacionais e regras de negócio rígidas, onde cada entrada resulta em uma saída previsível e auditável. A tentativa de sobrepor a flexibilidade caótica da IA generativa sobre essa infraestrutura cria um conflito de arquitetura. Empresas estão descobrindo que, ao remover o controle humano direto de processos críticos, a latência entre o erro da IA e a detecção do problema pode custar caro demais para a operação diária.

O custo oculto da implementação e manutenção

O mecanismo de falha em muitas dessas iniciativas reside no custo de manutenção da 'verdade'. Manter um LLM alinhado com as políticas internas, mudanças regulatórias e dados proprietários exige uma camada de engenharia de prompt e RAG (Retrieval-Augmented Generation) que, muitas vezes, torna-se tão complexa e dispendiosa quanto os sistemas legados que a IA pretendia substituir. A promessa de redução de custos operacionais é frequentemente anulada pelo custo de monitoramento contínuo.

Além disso, existe o desafio da escalabilidade. O que funciona em um protótipo controlado de laboratório, onde o contexto é limitado, desmorona quando exposto à vasta e desorganizada base de dados de uma grande corporação. A falta de governança de dados estruturados dentro das companhias, um problema que precede a IA, torna-se um multiplicador de falhas quando modelos de linguagem são aplicados para extrair insights sem a devida curadoria da informação subjacente.

Tensões entre stakeholders e o papel da regulação

Do ponto de vista dos stakeholders, a tensão é clara. Executivos de TI e CIOs estão sob pressão crescente para justificar o retorno sobre o investimento em IA, enquanto o corpo jurídico e de compliance observa com cautela o aumento da exposição a riscos de vazamento de dados e decisões enviesadas. Para os reguladores, a questão é como garantir que a automação não se torne uma caixa preta inescrutável, onde a responsabilidade por decisões automatizadas se perde no código.

No Brasil, onde o setor de serviços e o ecossistema de startups têm adotado a IA com entusiasmo, essa fase de 'pé no chão' é particularmente relevante. Empresas locais que investiram cedo na implementação de agentes de IA agora começam a filtrar quais processos realmente se beneficiam da natureza probabilística e quais exigem o rigor de sistemas especialistas tradicionais. A integração bem-sucedida não será sobre substituir processos, mas sobre desenhar sistemas híbridos que reconheçam as limitações de cada tecnologia.

O futuro da inteligência corporativa

A questão central que permanece em aberto é se os LLMs evoluirão para se tornarem determinísticos ou se o mercado encontrará novas arquiteturas que combinem o raciocínio linguístico com a precisão dos sistemas de computação clássica. A transição do entusiasmo cego para a implementação criteriosa sugere que o valor real da IA não está na substituição da gestão, mas na sua capacidade de atuar como uma camada de interface inteligente sobre dados já estruturados e verificáveis.

Devemos observar, nos próximos trimestres, um movimento de recuo em projetos que tentam delegar autonomia total a modelos de linguagem, em favor de sistemas 'human-in-the-loop', onde a IA atua como um copiloto assistido por guardrails rígidos. A maturidade tecnológica virá não da sofisticação do modelo, mas da capacidade das empresas de construir uma governança robusta que suporte a natureza fundamentalmente incerta da inteligência artificial generativa.

O cenário atual não indica o fim das iniciativas de IA, mas uma necessária curva de aprendizado sobre o que é, de fato, a inteligência aplicada ao ambiente de negócios. A transição para um modelo de gestão assistida exigirá que as empresas parem de tratar a IA como uma solução mágica e passem a tratá-la como um componente de software que, como qualquer outro, exige manutenção, governança e limites claros de atuação para evitar riscos sistêmicos.

Com reportagem de Inc. Magazine

Source · Inc. Magazine