A recente participação de Jennifer Tejada, CEO da PagerDuty, na conferência HumanX, trouxe à tona uma discussão fundamental para o futuro da automação corporativa: a centralidade do contexto na implementação de agentes de inteligência artificial. Em um momento onde o mercado transita da empolgação inicial com modelos generativos para a busca por eficiência operacional real, a executiva argumentou que a capacidade de processar informações isoladas é insuficiente para sustentar fluxos de trabalho críticos em empresas de tecnologia.

Segundo reportagem da Quartz, a tese central de Tejada é que a IA, por mais sofisticada que seja em termos de processamento de linguagem natural, falha ao tentar resolver incidentes complexos sem acesso a um ecossistema de dados contextualizados. Para a PagerDuty, cuja plataforma é vital para a gestão de incidentes em infraestruturas digitais, a inteligência artificial só se torna um ativo estratégico quando consegue cruzar dados de monitoramento, histórico de incidentes e a hierarquia de responsabilidades de uma organização em tempo real.

A barreira da fragmentação de dados corporativos

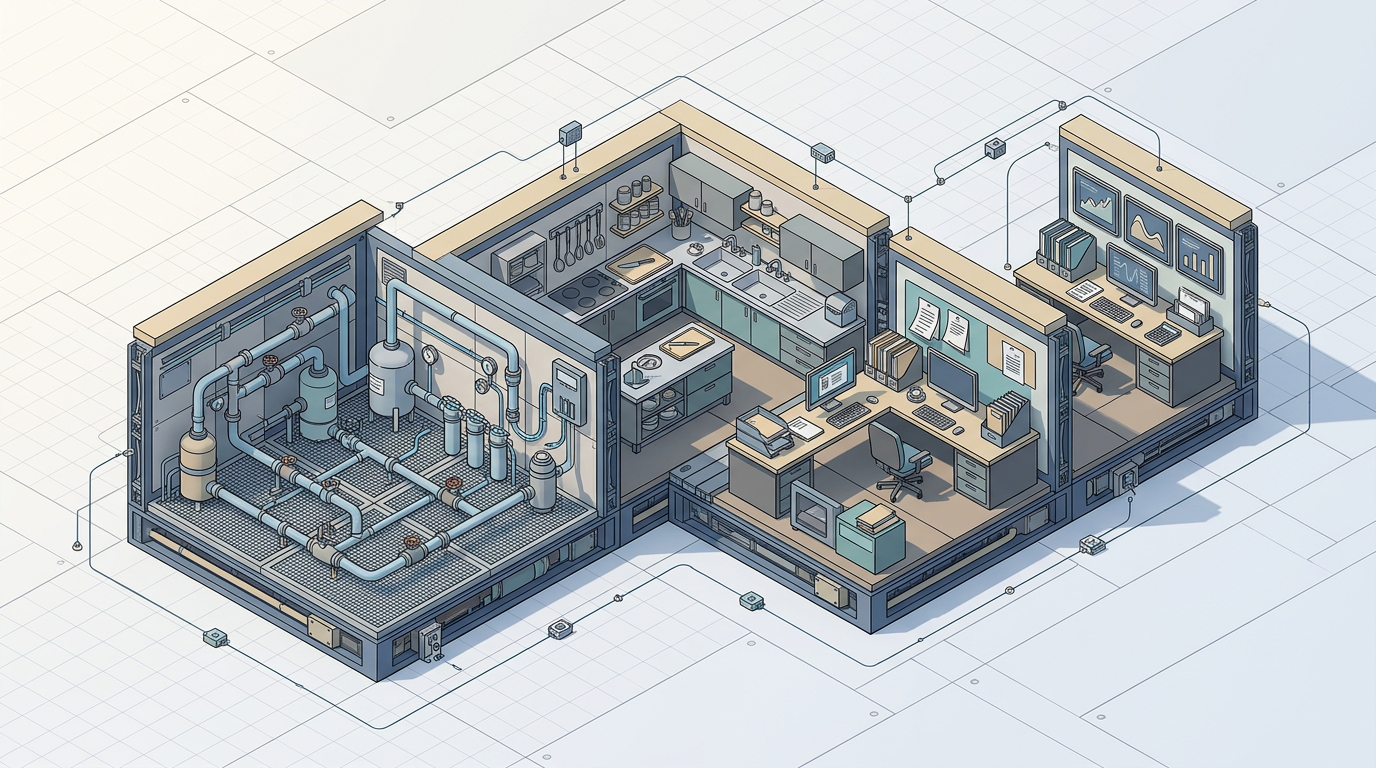

A promessa dos agentes de IA é, teoricamente, a de atuar como funcionários digitais autônomos capazes de tomar decisões e executar tarefas. Contudo, a realidade operacional das grandes corporações é marcada por silos de dados que impedem essa autonomia. A falta de um contexto unificado significa que, embora um modelo de IA possa identificar um erro em um código ou uma falha de servidor, ele frequentemente carece da visão sistêmica necessária para entender o impacto desse evento no negócio ou a precedência de correção exigida.

O desafio, portanto, não reside apenas na capacidade de inferência dos modelos, mas na arquitetura de dados que os alimenta. Empresas que operam com sistemas legados ou infraestruturas fragmentadas enfrentam dificuldades em fornecer aos agentes o histórico necessário para que a IA não apenas reporte um problema, mas execute a mitigação correta. A visão de Tejada reforça que a IA não é uma solução plug-and-play, mas sim um componente que exige uma base de dados higienizada e estruturada para funcionar com o nível de confiabilidade que o mercado B2B exige.

Mecanismos de agência e a confiança do operador

A transição de modelos de linguagem para agentes autônomos depende de uma mudança na natureza da interação entre homem e máquina. Em fluxos de trabalho de alta pressão, como a resposta a incidentes, a confiança é o fator limitante. Um agente de IA que atua sem contexto é visto pelo operador humano como um risco, não como um assistente, pois a possibilidade de uma ação automatizada incorreta pode resultar em tempos de inatividade prolongados e prejuízos financeiros significativos.

Para mitigar esses riscos, a estratégia defendida passa pela implementação de sistemas de governança onde a IA opera dentro de parâmetros estritos, validados pelo contexto histórico da organização. Quando a máquina compreende, por exemplo, que um alerta específico em um banco de dados de produção tem prioridade sobre um alerta em ambiente de testes, ela deixa de ser apenas uma ferramenta de triagem para se tornar um agente resolutivo. Esse mecanismo de priorização contextual é o que separa a automação básica da inteligência operacional escalável.

Stakeholders e a nova fronteira da eficiência

As implicações desse cenário são vastas para desenvolvedores de software, engenheiros de confiabilidade de sites (SREs) e gestores de TI. Enquanto os desenvolvedores de IA focam em reduzir alucinações e melhorar a precisão dos modelos, os stakeholders corporativos exigem que essas ferramentas se integrem perfeitamente aos fluxos de trabalho existentes. A pressão por ROI em projetos de IA força as empresas a priorizarem a qualidade dos dados sobre a quantidade de modelos implementados.

No Brasil, onde o setor de tecnologia tem adotado soluções de automação para otimizar equipes reduzidas, a lição é clara: investir em infraestrutura de dados é um pré-requisito para qualquer ganho de produtividade via IA. Reguladores e gestores de risco também observam com cautela o aumento da autonomia dessas ferramentas. A necessidade de trilhas de auditoria claras para as decisões tomadas por agentes de IA torna-se uma exigência normativa, especialmente em setores regulados como o financeiro, onde a explicabilidade da decisão automatizada é inegociável.

O futuro da autonomia assistida e as perguntas em aberto

O que permanece incerto é a velocidade com que as organizações conseguirão unificar seus silos de dados para permitir que agentes de IA operem de forma verdadeiramente autônoma. A maturidade técnica dos modelos avança de forma acelerada, mas a reestruturação de processos internos e a limpeza de dados legados são tarefas lentas, que dependem mais de cultura organizacional do que de inovação algorítmica. A pergunta que se impõe é se a IA será o catalisador que forçará essa organização de dados ou se a falta de estrutura continuará sendo o gargalo que impedirá a adoção em larga escala.

Deve-se observar, nos próximos trimestres, como o mercado reagirá às ferramentas que prometem 'contextualização automática'. A capacidade de uma plataforma de integrar dados de diversas fontes e traduzi-los em contexto utilizável para modelos de IA será, provavelmente, o principal diferencial competitivo no mercado de software corporativo. A eficácia da IA não será medida pela sua capacidade de gerar texto, mas pela sua capacidade de compreender o ambiente operacional em que está inserida.

A busca pela inteligência artificial contextual sugere que estamos deixando a fase de experimentação para entrar em um período de consolidação técnica. A promessa de agentes autônomos permanece, mas o caminho para sua implementação bem-sucedida parece passar menos pela sofisticação dos modelos e mais pela disciplina na gestão de dados e na estruturação de processos. A tecnologia, por si só, é apenas um meio; o contexto é, de fato, a variável que define o sucesso ou a obsolescência de uma solução de IA em ambiente real.

Com reportagem de Quartz

Source · Quartz