A OpenAI anunciou a disponibilização do GPT-5.5 com um programa de Acesso Confiável para Cibersegurança voltado a defensores verificados. A iniciativa é desenhada para permitir que pesquisadores e equipes de segurança acelerem a análise de código e a investigação de ameaças em infraestruturas críticas. O movimento marca um passo deliberado da companhia em direção ao setor de defesa, oferecendo suporte em uma escala que ultrapassa a capacidade de analistas humanos atuando de forma manual.

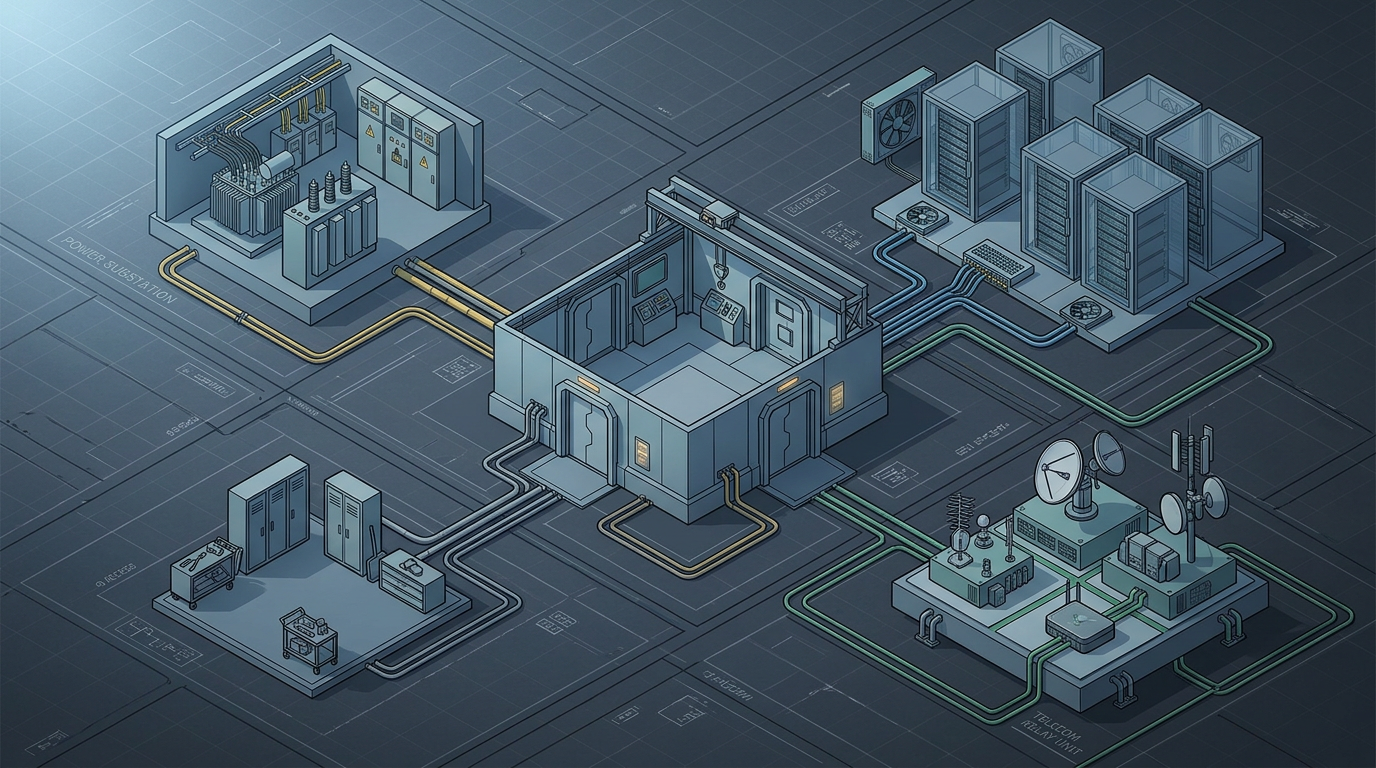

Este lançamento ocorre em um momento de crescente preocupação global com a utilização de modelos de linguagem em ataques cibernéticos automatizados. Ao segmentar o acesso a essas capacidades e impor controles de uso, a OpenAI tenta mitigar riscos de proliferação de código malicioso enquanto entrega um ativo estratégico para governos e empresas responsáveis pela manutenção de redes elétricas, sistemas financeiros e infraestruturas de telecomunicações. A estratégia reforça a transição da empresa de um laboratório de pesquisa para uma fornecedora de plataformas que sustentam operações de segurança em organizações de alto nível.

A evolução da corrida armamentista digital

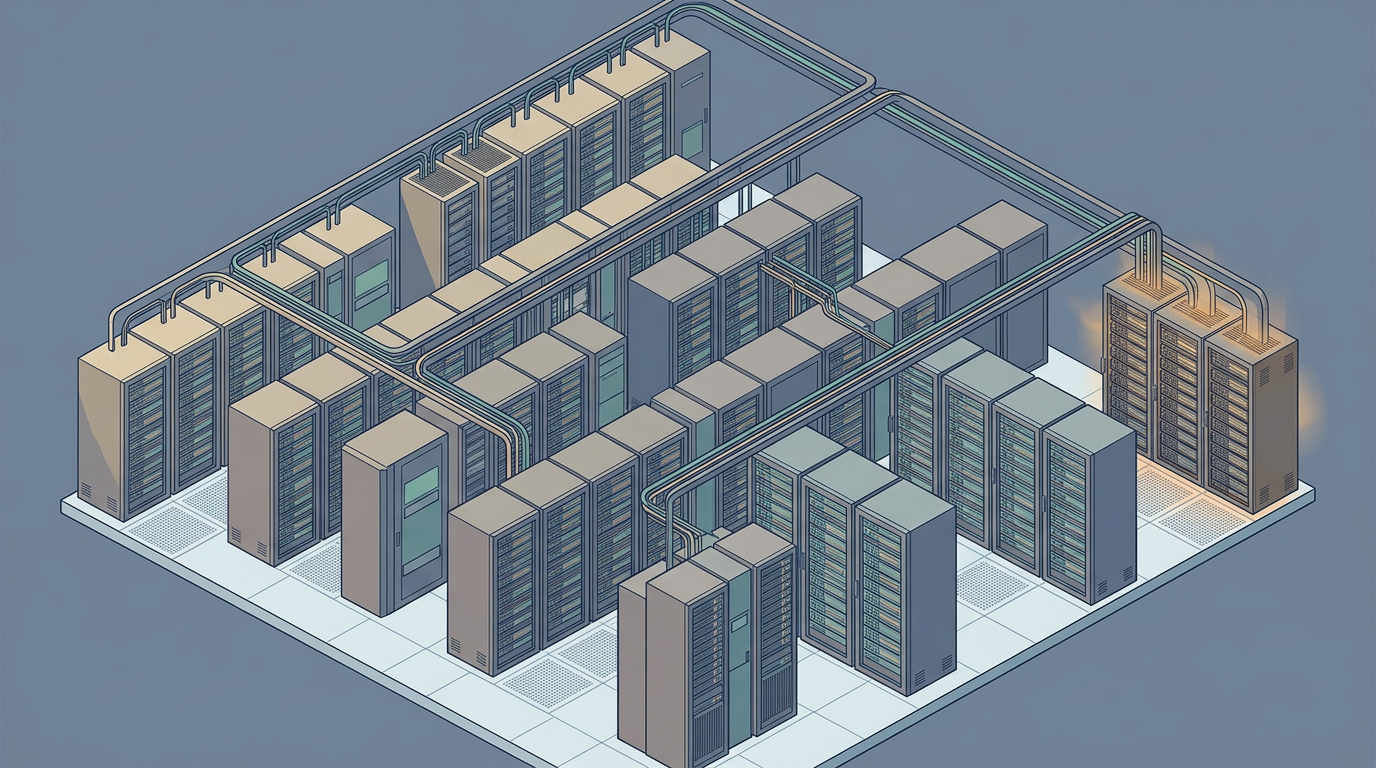

A integração de inteligência artificial em operações de cibersegurança não é nova, mas o salto de capacidade observado no GPT-5.5 pode alterar a dinâmica entre atacantes e defensores. Historicamente, a descoberta de vulnerabilidades de dia zero exigia uma combinação rara de intuição humana e análise manual exaustiva. Com modelos mais capazes, torna-se viável ajudar a processar grandes bases de código e identificar padrões de falhas lógicas de forma contínua, encurtando o tempo entre a exposição de um sistema e sua correção.

Entretanto, o uso de modelos aplicados à segurança traz dilemas estruturais. A mesma ferramenta que assiste na identificação de brechas em protocolos de rede industriais pode, teoricamente, ser explorada de forma maliciosa. Este é o desafio central que o programa de Acesso Confiável tenta endereçar: ao limitar o acesso a usuários verificados e implementar monitoramento, a OpenAI busca um regime de “uso dual controlado”, canalizando poder computacional para defesa enquanto vigia riscos de abuso.

Mecanismos de governança e incentivos

Segundo a OpenAI, o acesso às capacidades de cibersegurança no GPT-5.5 é condicionado a verificações, políticas de uso e camadas de auditoria para reduzir vetores de mau uso. Em vez de liberar funcionalidades de forma irrestrita, a empresa afirma operar com salvaguardas que priorizam casos de uso defensivos e rastreabilidade, elementos relevantes para requisitos de conformidade em ambientes regulados.

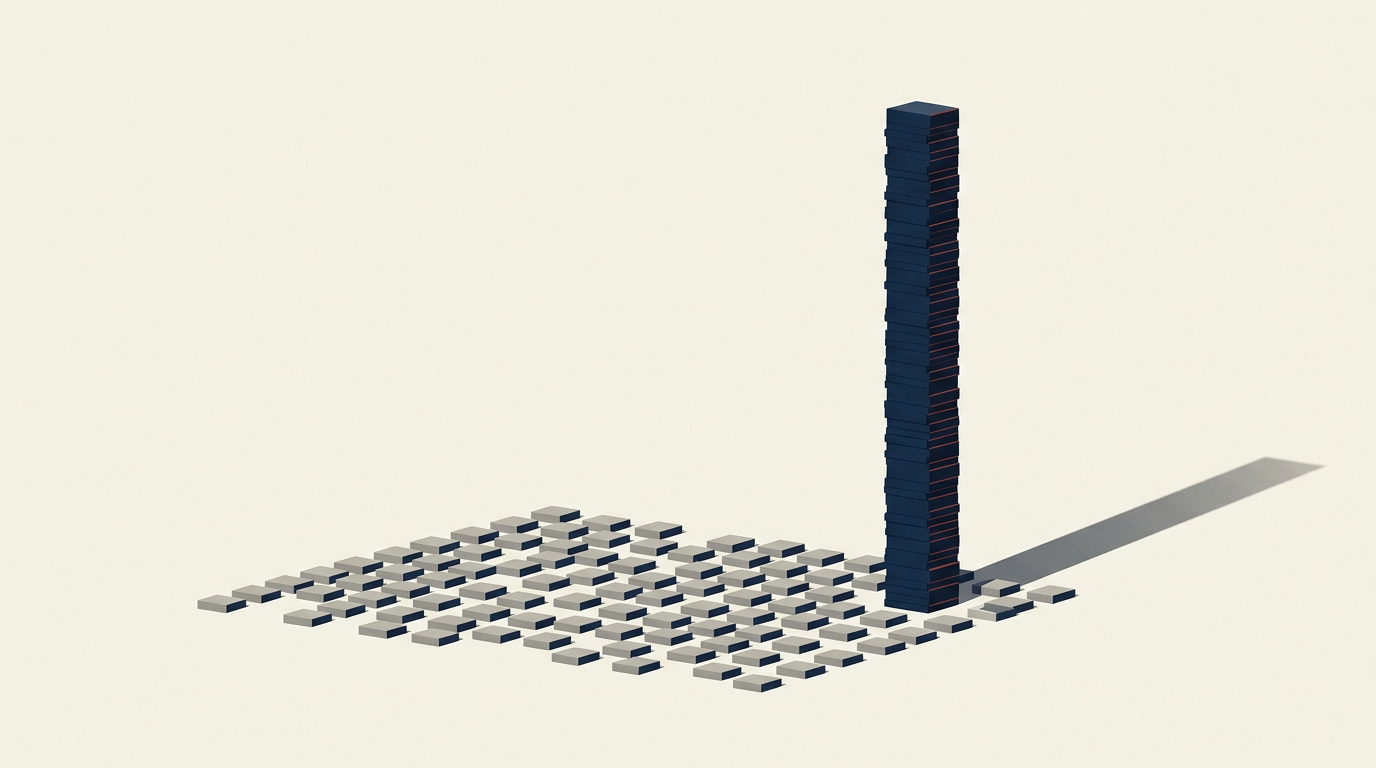

Os incentivos para a adoção são claros em grandes organizações que sofrem com a escassez de profissionais de cibersegurança. Automatizar a triagem de alertas e a análise de logs pode liberar as equipes de resposta a incidentes para focarem em ameaças de alta prioridade, reduzindo ruídos operacionais. Esse ganho de eficiência transforma tarefas antes artesanais em processos de engenharia mais escaláveis e reproduzíveis.

Implicações para o ecossistema de defesa

Para reguladores e formuladores de políticas públicas, o GPT-5.5 levanta questões sobre soberania tecnológica. A dependência de uma empresa privada para proteger infraestruturas críticas cria um novo paradigma de risco e interdependência. Governos precisarão ponderar até que ponto é aceitável delegar a integridade de seus sistemas a modelos de “caixa-preta”, mesmo se demonstram eficácia superior em testes. Transparência e auditabilidade devem ganhar centralidade, pressionando a OpenAI a adaptar práticas de governança.

No Brasil, onde o setor de cibersegurança ainda amadurece diante de ataques a órgãos públicos e instituições financeiras, a chegada de ferramentas desse calibre pode representar salto tecnológico — desde que acompanhada de infraestrutura de dados local, políticas de TI robustas e capacitação para interpretar e operacionalizar as recomendações do modelo. O desafio não é apenas adquirir tecnologia, mas construir competência interna para usá-la com segurança e impacto.

O futuro da resiliência algorítmica

Resta incerta a capacidade de sustentar vantagem diante de ameaças persistentes e adaptativas. A história da segurança digital é marcada pela superação constante de defesas, e não há garantias de que o GPT-5.5 manterá sua dianteira por muito tempo. A questão central é se a IA evoluirá mais rápido do que a engenhosidade humana aplicada ao crime cibernético.

Nos próximos meses, o desempenho do GPT-5.5 em ambientes reais será o principal indicador de eficácia. Observadores da indústria acompanharão não apenas resultados operacionais, mas também a robustez da própria plataforma da OpenAI, que se torna alvo valioso. A resiliência será testada pela precisão técnica e pela integridade da infraestrutura de acesso.

A tecnologia de defesa nunca dependeu tanto de modelos preditivos. Ao se posicionar como guardiã dessa fronteira, a OpenAI assume um papel que ultrapassa o mercado de software. O sucesso ou fracasso dessa empreitada terá consequências diretas para a estabilidade das redes que sustentam a economia global, tornando a governança desses modelos um teste decisivo para a indústria de IA.

Com reportagem de OpenAI Blog

Source · OpenAI Blog