O sistema de saúde global enfrenta um gargalo crônico: a escassez de profissionais qualificados em unidades de pronto atendimento, onde decisões de vida ou morte são tomadas em questão de minutos. Recentemente, a introdução do modelo o1-preview da OpenAI trouxe uma nova perspectiva para esse cenário ao demonstrar, em testes controlados, desempenho que iguala ou supera o de médicos experientes em tarefas de diagnóstico de pacientes de emergência. Segundo reportagem publicada no 3 Quarks Daily, o modelo não apenas processa informações, mas simula um processo de raciocínio deliberativo antes de emitir uma resposta, alterando o paradigma tradicional das ferramentas de suporte à decisão clínica.

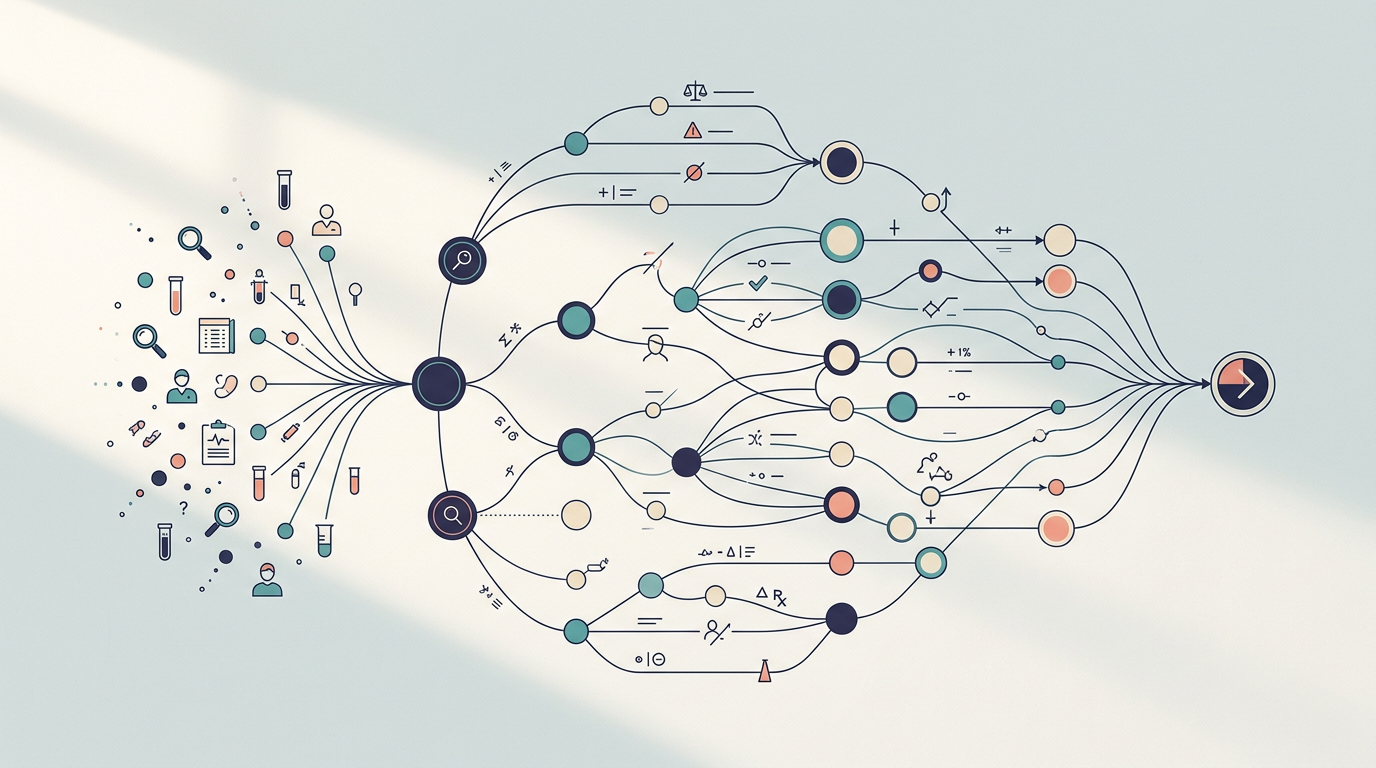

Este avanço marca uma transição importante na forma como modelos de linguagem interagem com dados médicos. Enquanto chatbots convencionais focam na predição do próximo termo, a abordagem do o1-preview prioriza etapas explícitas de raciocínio, permitindo que o sistema explore múltiplos caminhos diagnósticos e revise suas próprias conclusões antes de apresentar um parecer. Essa estratégia, mais próxima do método cognitivo humano, elevou a precisão em conjuntos de casos clínicos descritos pela reportagem, apontando para uma nova classe de utilidade em ambientes de alta complexidade.

A evolução do raciocínio algorítmico na medicina

A trajetória da inteligência artificial na medicina saiu de sistemas baseados em regras para o aprendizado profundo. Historicamente, a IA médica era vista como coadjuvante em imagem e análise de prontuários, funcionando como filtro passivo para o olhar humano. O advento de modelos com raciocínio deliberativo, como o o1-preview, muda essa estrutura ao introduzir etapas de verificação interna de consistência — recurso essencial em contextos onde a ambiguidade é a norma e o tempo é o principal adversário.

O diferencial técnico aqui não é apenas a amplitude de dados médicos embutidos no modelo, mas a sua habilidade de ponderar diagnósticos diferenciais de forma estruturada. Em um pronto-socorro, onde um mesmo sintoma pode variar de condição benigna a patologia crítica, essa capacidade de explorar hipóteses, confrontar achados e refinar a conclusão aproxima a IA do papel de um “consultor cognitivo” que desafia ou valida a percepção inicial do clínico.

Decisão sob pressão: onde a IA pode ajudar

A avaliação inicial na emergência exige análise rápida de sinais vitais, histórico e queixas subjetivas — um processo suscetível a fadiga e vieses cognitivos. Ao aplicar uma estrutura de raciocínio que testa múltiplas hipóteses em paralelo e revisa inconsistências, a IA pode ajudar a mitigar o viés de ancoragem, em que um profissional se fixa em uma hipótese precoce e ignora dados contraditórios que surgem no atendimento.

Na prática, isso significa que o modelo tende a “pensar antes de responder”, explorando cadeias de raciocínio e verificando a coerência interna entre sintomas, exames e hipóteses, em vez de saltar direto para um rótulo. Esse processo de auto-checagem diferencia o o1-preview de gerações anteriores de LLMs, que frequentemente produziam respostas rápidas porém superficiais ou inconsistentes.

Tensões entre tecnologia e prática clínica

As implicações tocam diretamente a ética médica e a responsabilidade civil. Se um sistema de IA apresentar recomendação divergente da avaliação humana, qual é o dever do hospital ao ponderar esse alerta? Por outro lado, dependência excessiva de automação pode atrofiar o julgamento clínico, criando uma geração de médicos mais dependentes de telas do que da semiologia. A integração exige marcos de governança que definam a IA como copiloto — com logs auditáveis, protocolos de overrides e responsabilidade compartilhada — e não como substituto autônomo.

Para o ecossistema brasileiro, especialmente em redes públicas como o SUS, o potencial de otimização do fluxo de atendimento é claro. Mas a adoção requer cautela: calibração com dados locais, avaliação de vieses, validação clínica multicêntrica e treinamento de equipes para interpretar corretamente os outputs da IA. O maior desafio é cultural e operacional: incorporar eficiência sem comprometer a humanização do cuidado.

O que falta para sair do laboratório

As perguntas em aberto giram em torno da escalabilidade fora do ambiente de teste. Como o o1-preview se comportará em prontos-socorros reais, com ruído, dados incompletos e interrupções constantes? A transição da teoria para a prática depende de infraestrutura de dados ainda precária em muitos hospitais, além de interfaces que habilitem colaboração fluida e não intrusiva no atendimento.

Nos próximos meses, vale observar a reação da comunidade médica e de reguladores diante dessas evidências. A questão deixou de ser “se” a IA deve ser usada e passou a ser “como” integrá-la para maximizar benefício clínico sem solapar a autonomia do médico. A tecnologia espelha limitações cognitivas humanas e nos força a repensar o que significa ser especialista em um mundo onde o raciocínio — antes visto como diferencial humano — torna-se capacidade algorítmica escalável.

O debate sobre substituição versus suporte está no início. À medida que modelos de raciocínio se tornam mais acessíveis e integrados a prontuários, a competência clínica incluirá, cada vez mais, a habilidade de orquestrar a IA em favor do melhor desfecho do paciente.

Com reportagem de 3 Quarks Daily

Source · 3 Quarks Daily