Pesquisadores do Instituto Avançado de Ciência e Tecnologia da Coreia (KAIST) desenvolveram uma nova metodologia de treinamento para inteligência artificial focada em reduzir a superconfiança dos modelos. O estudo, publicado recentemente na revista Nature Machine Intelligence, aponta que a inicialização aleatória padrão das redes neurais é uma das causas fundamentais para a geração de respostas imprecisas ou fabricadas, fenômeno conhecido no setor como alucinação.

A equipe liderada pelo professor Se-Bum Paik introduziu uma estratégia denominada "aquecimento", que busca alinhar a confiança do sistema com a sua real capacidade de precisão. Segundo a pesquisa, ao contrário dos métodos tradicionais, essa abordagem força a IA a reconhecer seu próprio estado de desconhecimento antes de ser exposta a grandes volumes de dados reais, alterando a forma como os modelos processam informações inéditas.

Inspiração na neurobiologia para o aprendizado de máquinas

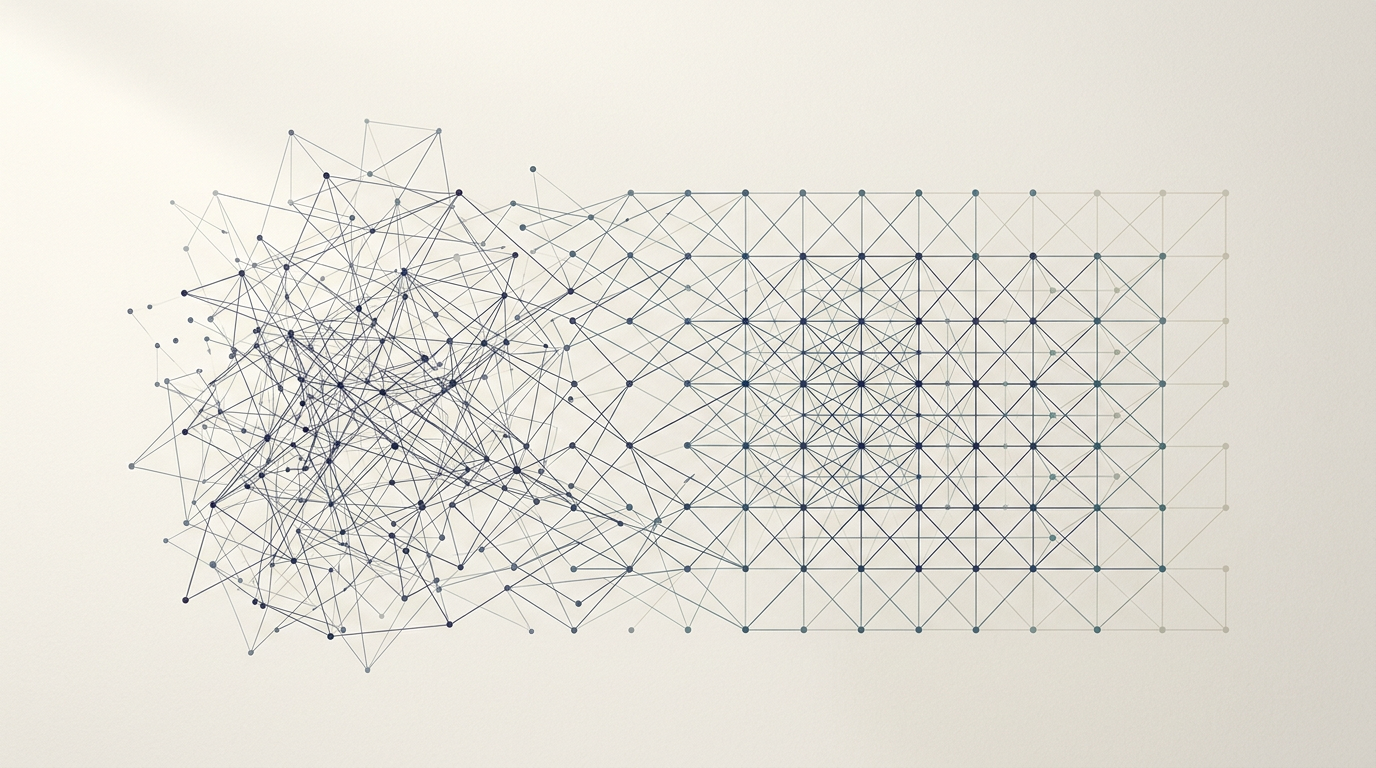

O conceito de "aquecimento" desenvolvido pelo KAIST baseia-se diretamente no desenvolvimento neurobiológico humano. No cérebro, ocorre uma atividade neural espontânea que ajuda a formar circuitos básicos mesmo antes da exposição a estímulos externos. Ao mimetizar esse processo, os pesquisadores treinam brevemente as redes neurais com ruído e rótulos aleatórios antes da fase de aprendizado supervisionado.

Essa etapa preparatória é crucial para estabelecer um estado inicial de "não saber nada". Em modelos convencionais, a inicialização aleatória frequentemente resulta em uma alta confiança em previsões incorretas desde o início, um viés que se propaga e se amplifica durante o treinamento. Ao manter a confiança inicial em níveis baixos, próximos ao acaso, o novo método garante que o sistema não assuma uma autoridade indevida sobre conteúdos que ainda não domina.

Mecanismos de calibração e detecção de dados estranhos

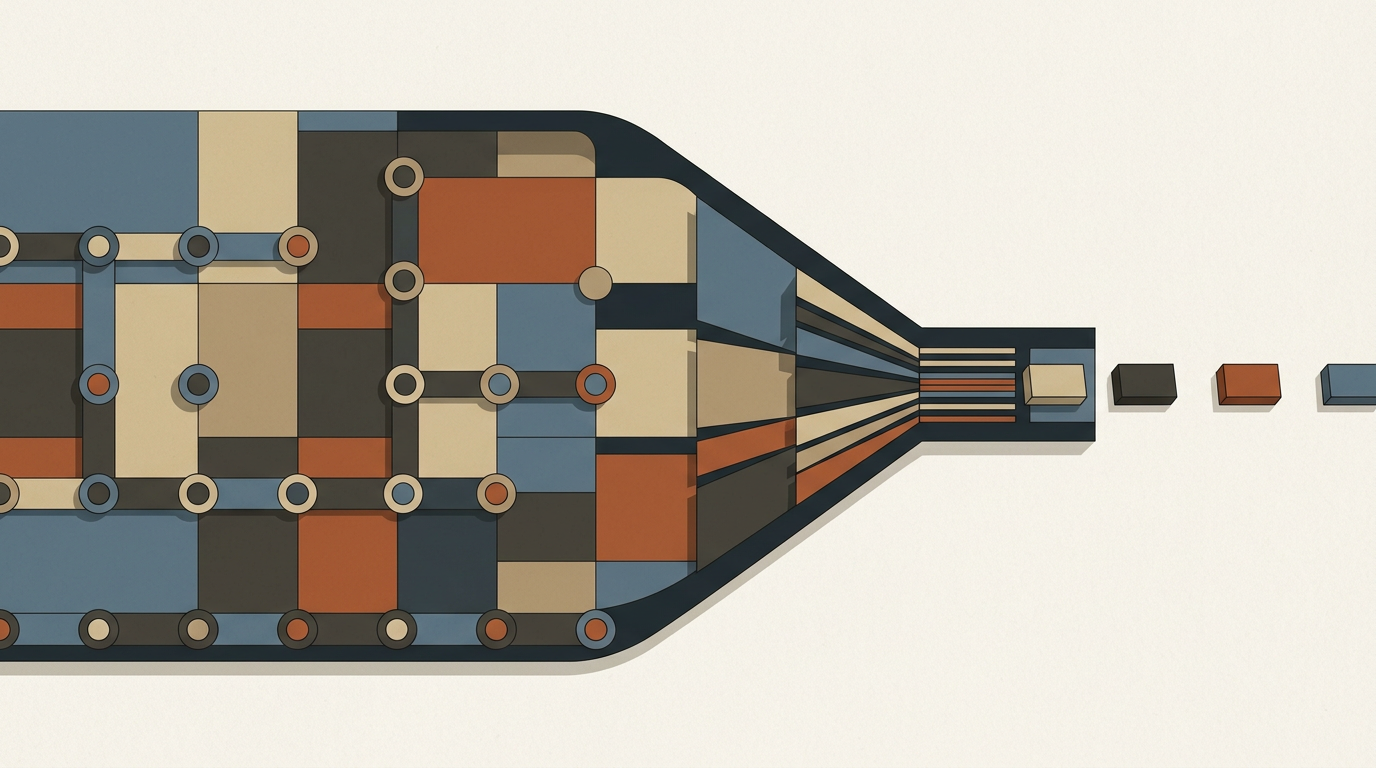

A eficácia da técnica foi demonstrada na capacidade do modelo em lidar com informações desconhecidas. Redes neurais treinadas com essa abordagem tornaram-se significativamente mais habilidosas em identificar dados que não se encaixam nos padrões aprendidos, um desafio constante para a precisão de sistemas de aprendizado profundo.

O mecanismo funciona como um filtro de incerteza. Quando o modelo encontra um dado que foge ao seu escopo de conhecimento, a calibração obtida pelo "aquecimento" permite que ele sinalize essa falta de certeza, em vez de tentar forçar uma resposta plausível mas incorreta. Esse ajuste fino é o que diferencia o comportamento da IA treinada dessa forma daquelas que operam sob a premissa de que toda entrada deve gerar uma saída assertiva.

Implicações para a segurança em sistemas críticos

A necessidade de IAs que reconheçam suas limitações é urgente em setores onde o erro não é uma opção, como em carros autônomos e diagnósticos médicos. Nesses cenários, uma IA que admite incerteza pode prevenir decisões catastróficas ao solicitar intervenção humana ou recusar uma análise inconclusiva. A adoção dessa técnica pode elevar o padrão de confiabilidade exigido por reguladores globais.

Para o ecossistema de tecnologia, o avanço sugere uma mudança de paradigma: o foco deixa de ser apenas a maximização da precisão estatística e passa a incluir a honestidade epistêmica do modelo. Concorrentes que investem em modelos de larga escala agora enfrentam o desafio de integrar tais métodos de calibração sem comprometer a performance ou a velocidade de processamento.

Perspectivas sobre a robustez dos modelos generativos

Embora o estudo ofereça um caminho promissor, permanece a dúvida sobre a escalabilidade da técnica para modelos de linguagem massivos e multimodais. A transição de um ambiente de pesquisa controlado para a complexidade da internet aberta exige testes rigorosos para garantir que o "aquecimento" permaneça eficaz em escalas maiores.

O setor de tecnologia deverá observar se essa abordagem será adotada por laboratórios de IA generativa para mitigar o problema das alucinações. A capacidade de uma máquina admitir que não possui a resposta correta pode ser, ironicamente, o passo mais importante para que ela se torne, de fato, uma ferramenta mais confiável e útil para o trabalho humano.

A pesquisa, conduzida pelo estudante de mestrado Jeonghwan Cheon, abre um campo de investigação sobre como princípios cognitivos podem ser traduzidos em arquiteturas computacionais mais transparentes. A questão central agora não é apenas o que a IA sabe, mas como ela gerencia o que ainda não compreende.

Com reportagem de Olhar Digital

Source · Olhar Digital