A euforia inicial em torno da inteligência artificial generativa tem levado corporações globais a um ciclo frenético de experimentação. Segundo reportagem da Forbes, a grande maioria desses projetos-piloto, concebidos em ambientes controlados e com escopo reduzido, encontra barreiras intransponíveis ao tentar migrar para o ambiente de produção em escala. O fenômeno reflete um descompasso fundamental entre a experimentação ágil e a realidade operacional de grandes sistemas legados.

O sucesso de um piloto de IA, muitas vezes celebrado em apresentações de resultados trimestrais, mascara uma fragilidade estrutural. Enquanto os protótipos prosperam devido à ausência de restrições complexas e à liberdade criativa de equipes multidisciplinares, o processo de escalonamento exige integração, conformidade e governança de dados que raramente foram priorizados nas fases iniciais. A transição do laboratório para o chão de fábrica corporativo revela que a tecnologia é, na verdade, a parte menos complexa do desafio de transformação digital.

O paradoxo da agilidade nos projetos experimentais

Projetos-piloto de IA funcionam sob uma lógica de startup: foco total em um problema específico, dados limpos fornecidos sob demanda e uma tolerância ao erro que não existe em sistemas críticos de negócio. Essa configuração permite que modelos de linguagem e ferramentas de automação apresentem resultados impressionantes em curtos intervalos de tempo. No entanto, essa mesma agilidade cria um efeito de estufa, onde a solução é otimizada para condições ideais que raramente se replicam no mundo real da corporação.

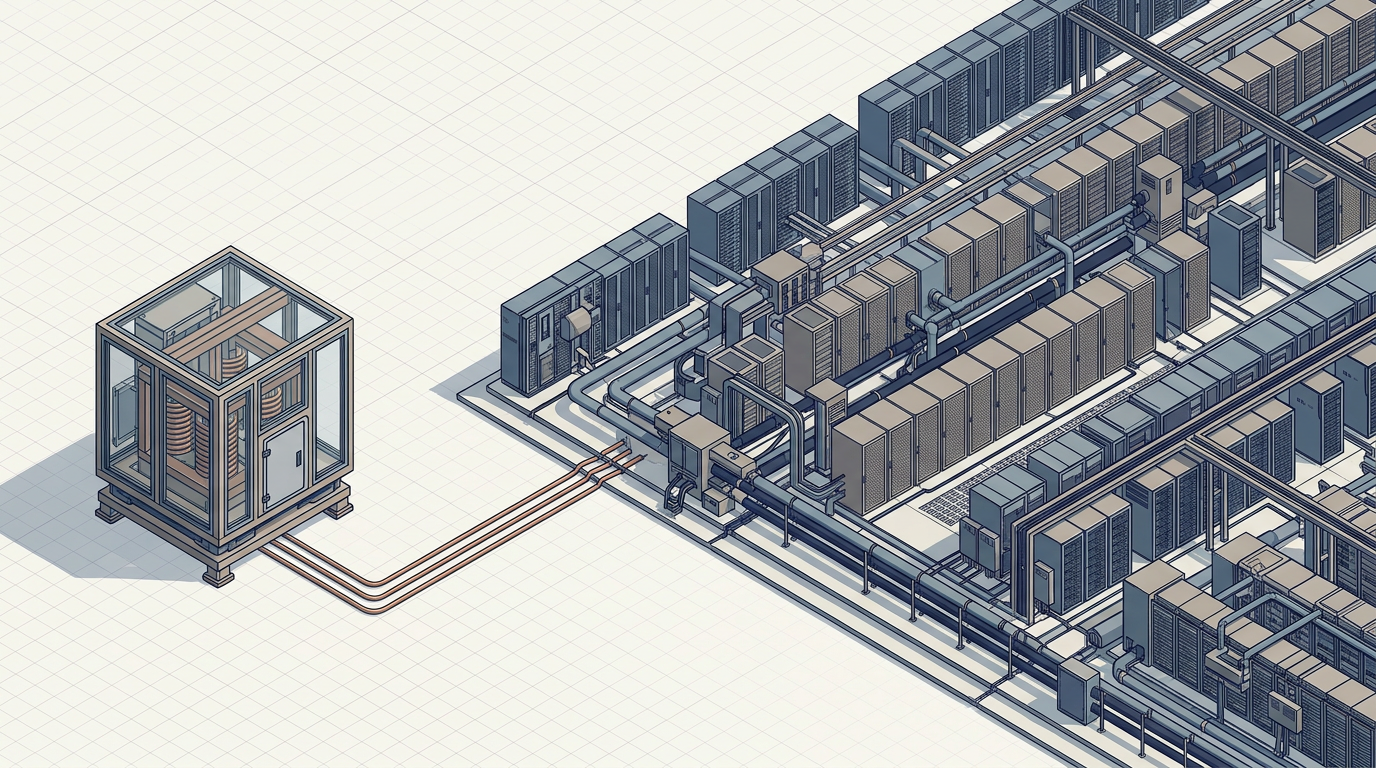

Historicamente, empresas que falharam em escalar inovações tecnológicas no passado — desde a adoção de nuvem privada até a implementação de ERPs globais — enfrentaram o mesmo obstáculo: a resistência da cultura de silos. Quando a IA é tratada como uma "caixa preta" isolada, ela não consegue dialogar com as fontes de dados fragmentadas da organização. O resultado é um sistema que funciona perfeitamente em uma interface de demonstração, mas que colapsa diante da latência, dos custos de inferência e das exigências de segurança de uma infraestrutura de larga escala.

Mecanismos de falha na integração sistêmica

O principal mecanismo de falha reside na falta de alinhamento entre as expectativas de ROI e a realidade técnica da manutenção de modelos em produção. Diferente de um software tradicional, onde a lógica é determinística, a IA exige monitoramento contínuo para evitar a degradação da performance, conhecida como "drift". Quando líderes de tecnologia ignoram o custo de manter essa infraestrutura, o projeto torna-se insustentável financeiramente assim que a escala aumenta.

Além disso, a governança de dados atua como um gargalo invisível. Muitos pilotos utilizam datasets curados manualmente, ignorando a complexidade de garantir a qualidade e a privacidade dos dados em tempo real. A incapacidade de integrar esses modelos aos fluxos de trabalho existentes significa que o usuário final, seja um funcionário ou um cliente, acaba lidando com uma ferramenta que não se conecta ao ecossistema de produtividade, resultando em baixa adoção e, eventualmente, no cancelamento do projeto por falta de tração.

Tensões entre inovadores e gestores de risco

As implicações dessa falha de escala são profundas, especialmente para a relação entre departamentos de TI e áreas de negócio. Enquanto os inovadores buscam velocidade, os gestores de risco e conformidade exigem garantias que, se aplicadas prematuramente, podem sufocar a criatividade do projeto. Esse atrito é um paralelo direto aos desafios enfrentados por empresas brasileiras que tentam implementar IA em setores altamente regulados, como o bancário e o de seguros, onde a precisão e a auditabilidade são inegociáveis.

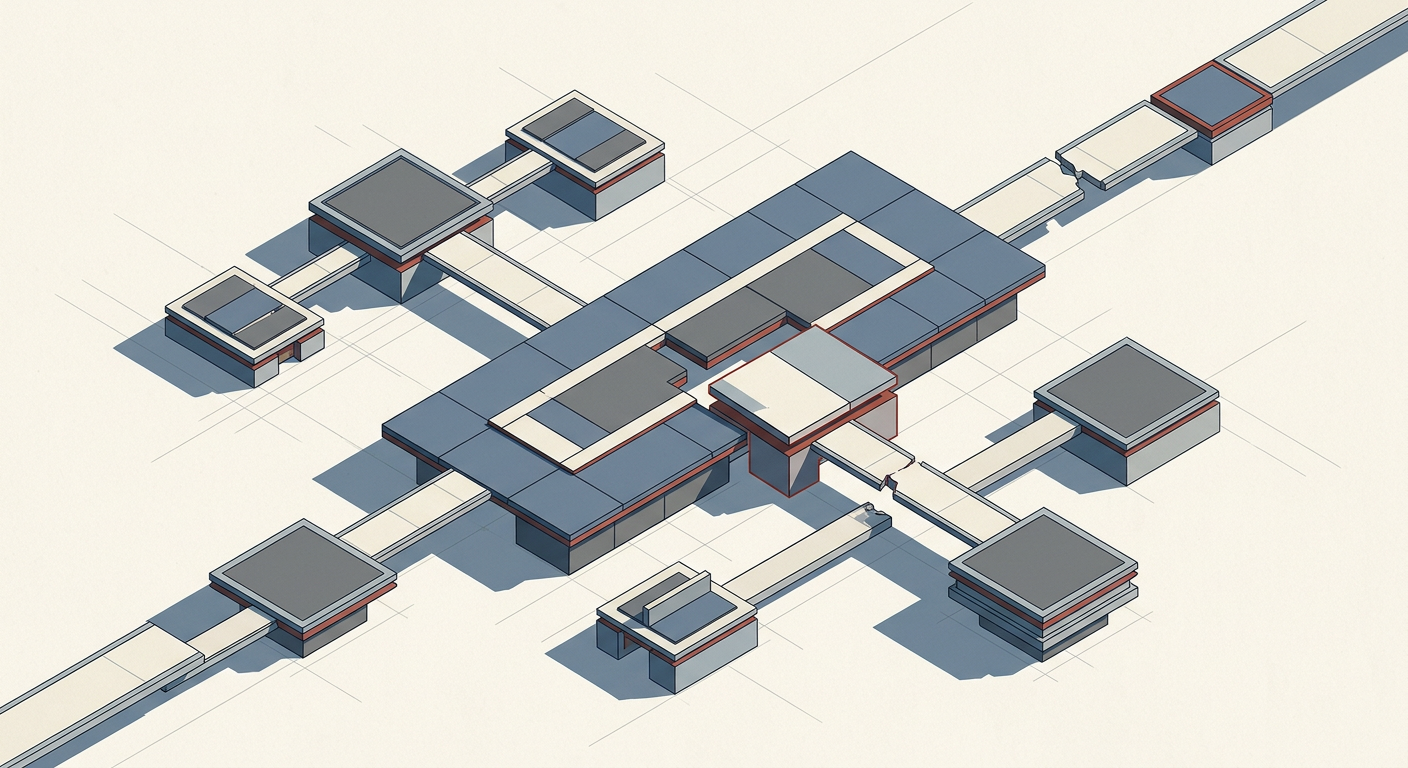

Concorrentes que conseguem escalar IA são aqueles que tratam a tecnologia como uma camada de infraestrutura, e não como um produto isolado. Isso exige uma mudança de mentalidade: o foco deixa de ser o "modelo de IA" e passa a ser a "arquitetura de dados". Para os stakeholders, a mensagem é clara: o valor real da IA não está na capacidade de gerar texto ou código, mas na capacidade de integrar essa inteligência ao core business de forma resiliente e segura.

O horizonte da maturidade operacional

O que permanece incerto é se as organizações conseguirão desenvolver a disciplina necessária para tratar modelos de IA com o mesmo rigor de sistemas legados de missão crítica. A transição exigirá novos perfis profissionais, capazes de transitar entre a ciência de dados e a engenharia de sistemas, além de uma governança que não seja apenas burocrática, mas que habilite a inovação através de padrões claros de segurança.

Deve-se observar, nos próximos trimestres, se a consolidação de plataformas de IA corporativa será capaz de reduzir essa lacuna. Se as empresas continuarem a tratar cada piloto como um evento isolado, a frustração com o retorno sobre o investimento será inevitável. O sucesso a longo prazo dependerá menos da sofisticação do algoritmo e muito mais da capacidade de integrar essa inteligência ao tecido operacional da organização.

A questão central para os próximos anos não será mais "o que a IA pode fazer", mas "como podemos sustentar o que a IA está fazendo". O abismo entre o sucesso do piloto e a eficiência da escala é, em última análise, um teste de maturidade organizacional que poucas empresas estão prontas para enfrentar.

Com reportagem de Forbes

Source · Forbes — Innovation