Em entrevista recente, o diretor financeiro (CFO) da Anthropic, Krishna, detalhou a mecânica operacional que levou a empresa de inteligência artificial a saltar de US$ 9 bilhões para mais de US$ 30 bilhões em receita recorrente anualizada (run rate) em um único trimestre. O executivo descreveu a gestão de infraestrutura como o núcleo estratégico da operação, revelando compromissos superiores a US$ 100 bilhões em poder computacional. A análise expõe como a dinâmica de desenvolvimento de modelos de fronteira rompe as lógicas tradicionais de margem e custo variável do software corporativo, exigindo uma readequação estrutural na forma como o capital e o silício são alocados.

A orquestração do poder computacional

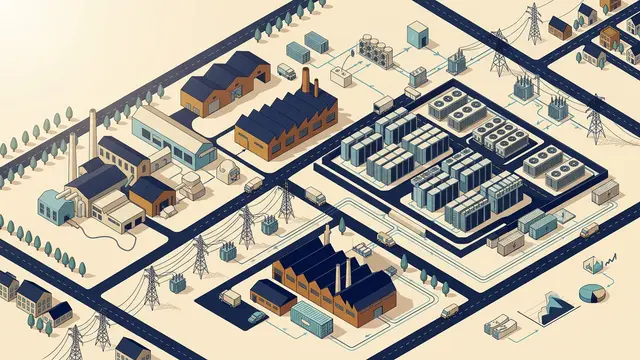

Krishna afirmou gastar até 40% do seu tempo gerenciando o que chama de "cone de incerteza": a dificuldade matemática de prever a demanda em um cenário de crescimento exponencial. Para sustentar a pesquisa e o atendimento aos usuários, a Anthropic assinou acordos de 5 gigawatts com o Google e a Broadcom para o uso de TPUs a partir de 2027, além de um contrato de até 5 gigawatts com a Amazon focado em chips Trainium. O escopo também inclui parcerias de curto prazo, como o uso das instalações Colossus da SpaceX em Memphis. Juntos, os compromissos de longo prazo ultrapassam US$ 100 bilhões.

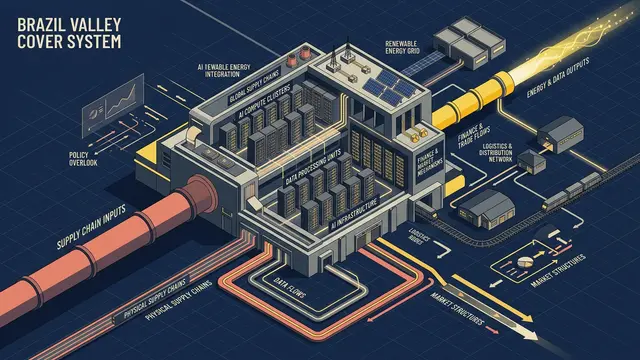

O diferencial estratégico, segundo o CFO, reside na fungibilidade dessa infraestrutura. A empresa construiu uma camada de orquestração que permite alternar dinamicamente o uso de GPUs da Nvidia, TPUs do Google e chips Trainium da Amazon. O mesmo hardware processa inferência para clientes pela manhã e é redirecionado para o treinamento de novos modelos à tarde. Essa flexibilidade impede que o poder computacional seja tratado como um custo variável tradicional.

Para contexto, a BrazilValley aponta que a magnitude desses acordos de energia afasta o setor de IA da economia leve de capital típica do ecossistema de software, aproximando-o da intensidade financeira de projetos de infraestrutura energética ou de telecomunicações.

O Paradoxo de Jevons e a automação interna

A estratégia comercial da Anthropic foca na adoção corporativa, o que levou a descobertas contraintuitivas sobre precificação. Krishna relatou que, ao reduzir o preço da família de modelos Opus (no lançamento do Opus 4.5), a empresa observou o Paradoxo de Jevons: o consumo disparou em uma proporção vastamente superior à queda do custo. Essa dinâmica impulsionou a receita e atraiu grandes clientes — hoje, a Anthropic atende a nove das dez maiores empresas da Fortune 10. O CFO destacou que investimentos originais em segurança e interpretabilidade (uma "ressonância magnética" da rede neural) tornaram-se o principal argumento de vendas no mercado B2B, ajudando a superar a hesitação de investidores após os anúncios da concorrente DeepSeek no final de 2024.

Internamente, a própria Anthropic funciona como um laboratório de automação intensiva. O executivo revelou que mais de 90% do código atual da empresa é escrito pelo Claude Code. Na área financeira, as demonstrações contábeis estatutárias são produzidas pela IA, e uma plataforma interna chamada "Ant Stats" centraliza mais de 70 habilidades específicas para finanças. Relatórios que antes exigiam horas de reconciliação de dados agora são gerados em 30 minutos, deslocando o foco da equipe da coleta para a análise de implicações estratégicas.

A trajetória descrita por Krishna — que ingressou na Anthropic quando a receita anualizada era de US$ 250 milhões e desde então levantou US$ 75 bilhões em capital, com mais US$ 50 bilhões previstos de Amazon e Google — ilustra a transição imperativa do pensamento linear para o exponencial. A capacidade de prever, financiar e orquestrar gigawatts de computação tornou-se tão crítica quanto a pesquisa algorítmica. O modelo de negócios da IA de fronteira consolida-se como um ciclo fechado de capital intensivo: o financiamento garante o hardware, que treina o modelo, que por sua vez escreve o código para acelerar a iteração seguinte.

Fonte · Brazil Valley | Business