A Cerebras Systems, fabricante de chips especializados em inteligência artificial, prepara-se para elevar o preço e o volume de sua oferta pública inicial de ações (IPO), conforme reportado pela Reuters. O movimento ocorre em um cenário de demanda aquecida por hardware capaz de suportar cargas de trabalho de IA cada vez mais complexas. Enquanto a Nvidia consolidou o domínio do mercado com suas unidades de processamento gráfico (GPUs), a trajetória da Cerebras aponta para um futuro em que a infraestrutura de computação será significativamente mais heterogênea do que o modelo atual sugere.

A tese central por trás do otimismo com a Cerebras é a capacidade de processamento de seu chip de wafer completo, que oferece uma largura de banda de memória massivamente superior à das GPUs tradicionais. No entanto, a leitura editorial é que o sucesso dessa tecnologia está atrelado a um nicho específico: a inferência de resposta rápida. Em um mercado em que a latência é o diferencial competitivo para interações humanas em tempo real, a arquitetura da Cerebras brilha. Contudo, essa vantagem técnica pode se tornar secundária à medida que o ecossistema de IA evolui da simples geração de respostas para a execução autônoma de tarefas complexas.

O domínio das GPUs e a barreira da latência

A hegemonia da Nvidia na era da IA não é um acidente, mas o resultado de um ecossistema robusto construído sobre a versatilidade das GPUs. Historicamente, essas unidades foram desenhadas para o processamento paralelo, uma característica que se provou ideal para o treinamento de modelos de linguagem. O sucesso da Nvidia baseia-se em três pilares: a programação facilitada pela plataforma CUDA, o acesso prioritário à memória de alta largura de banda (HBM) e inovações em redes de chip para chip. Esse conjunto permite que milhares de GPUs operem como um sistema unificado, essencial para modelos com trilhões de parâmetros.

Na inferência, o desafio é diferente. O processo alterna entre etapas de pré-carregamento (altamente paralelizadas) e decodificação (sequenciais e limitadas pela largura de banda da memória). Atualmente, as GPUs lidam com ambas as necessidades, mas a um custo elevado. A dependência de HBM e a necessidade de comunicação constante entre chips tornam a infraestrutura cara e complexa. A flexibilidade das GPUs é, hoje, a sua maior vantagem, permitindo que o mesmo hardware seja utilizado tanto para o treinamento intensivo quanto para a inferência em produção, reduzindo ociosidade e simplificando a gestão de capacidade.

A promessa e os limites da arquitetura Cerebras

A abordagem da Cerebras é distinta ao tratar o wafer de silício como um único chip, eliminando a necessidade de conexões lentas entre múltiplos processadores. O resultado é uma largura de banda de memória interna que supera em ordens de magnitude a de chips como o H100 da Nvidia. Essa arquitetura é ideal para cenários em que a velocidade de geração de tokens é o gargalo, como em assistentes de voz ou ferramentas de codificação que exigem resposta imediata. A experiência de uso é superior quando o modelo — ou a parte crítica do modelo — cabe inteiramente na memória on-chip.

Contudo, o desafio da Cerebras reside na escalabilidade. A técnica de fabricação de wafers inteiros impõe dificuldades de rendimento que elevam os custos de produção. Além disso, a arquitetura torna-se menos eficiente quando o volume de memória necessário excede a capacidade do chip, o que é comum em modelos maiores ou em caches de contexto extensos. A leitura aqui é que a Cerebras atende a uma demanda de performance extrema, mas pode encontrar resistência em aplicações que exigem custo-benefício e capacidade de memória massiva — elementos que definem a próxima fronteira da IA.

A transição para a inferência agentiva

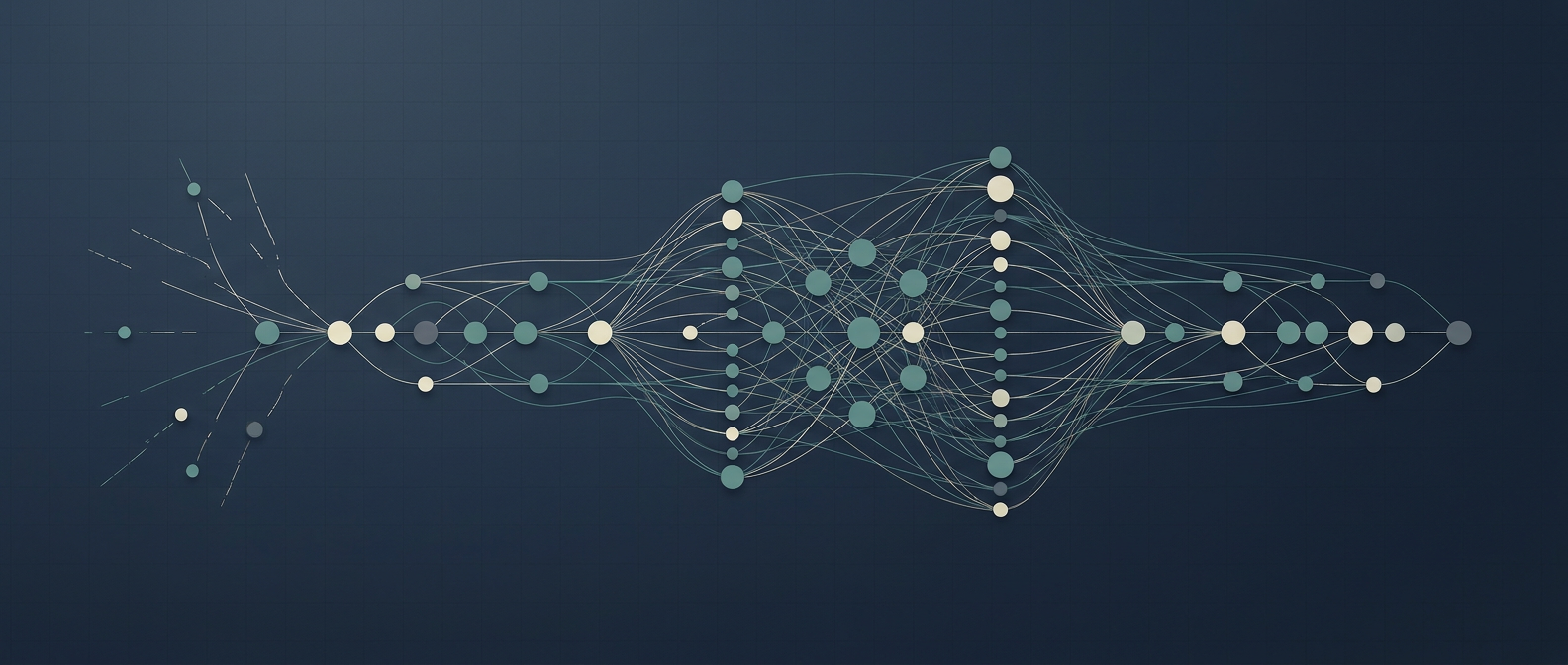

O conceito de inferência agentiva marca uma mudança de paradigma: o foco deixa de ser a rapidez em responder a um humano para ser a capacidade de realizar tarefas sem intervenção humana. Agentes autônomos exigem histórico, contexto e estado que não cabem apenas no cache de memória de alta velocidade. A hierarquia de memória — que inclui bancos de dados, logs e armazenamento de objetos — torna-se mais importante do que a velocidade bruta de processamento do chip. Se o agente não está em um ciclo de resposta imediata com um usuário, a latência de milissegundos perde relevância crítica.

Neste novo cenário, a infraestrutura tende a se desmembrar. O mercado de inferência de resposta continuará a existir, mas será superado em escala pela inferência agentiva. Para esses sistemas, a prioridade é a capacidade de memória a um custo mais acessível, como o uso de DRAM tradicional. Isso sugere que a dominância das GPUs de ponta pode ser desafiada por sistemas mais simples, focados em eficiência de memória e processamento distribuído, em que a “velocidade suficiente” substitui a busca pela performance de topo de linha.

Implicações para o ecossistema global

A mudança na infraestrutura de inferência tem implicações profundas para a geopolítica da tecnologia e a viabilidade de novos data centers. Países ou empresas que não possuem acesso às GPUs mais avançadas do mundo podem, ironicamente, encontrar na inferência agentiva um terreno mais fértil. Como a exigência por latência extrema diminui, componentes de hardware menos sofisticados — mas amplamente disponíveis — tornam-se suficientes para rodar agentes autônomos. Esse movimento pode reduzir a barreira de entrada para a inovação em regiões fora do eixo de liderança tecnológica atual.

Além disso, o setor espacial pode se beneficiar dessa transição. Chips que exigem menos energia, operam com temperaturas mais baixas e possuem maior tolerância a falhas são ideais para satélites. A necessidade de menos chips interconectados simplifica o design de sistemas de computação em órbita, onde a reparabilidade é inexistente. O futuro da computação, portanto, parece menos dependente da lei de Moore e mais focado na inovação de sistemas, em que a inteligência é otimizada pela arquitetura e não apenas pela força bruta do silício.

O mercado de semicondutores caminha para uma bifurcação clara: de um lado, a manutenção da infraestrutura de alto desempenho para treinamento e inferência de resposta; de outro, a emergência de uma infraestrutura massiva e especializada para agentes. Observar como a Nvidia e novos players se adaptarão a essa demanda por hierarquias de memória mais robustas será fundamental para entender quem liderará a próxima década de automação.

Com reportagem de Stratechery

Source · Stratechery