A implementação de inteligência artificial no ambiente corporativo deixou de ser um exercício de otimização de performance para se tornar um desafio de governança. À medida que modelos avançados assumem o protagonismo em decisões críticas, como concessão de crédito, diagnósticos de saúde e processos de RH, a confiança emerge como o principal ativo estratégico. Segundo análise publicada pelo Canaltech, o sucesso da IA em escala depende de uma arquitetura que incorpore princípios éticos desde a sua concepção, superando a visão de que a ética seria apenas um complemento opcional ou uma barreira à inovação.

Para as organizações, essa transição exige um alinhamento rigoroso com padrões globais. A adoção de frameworks de governança, como os defendidos pelo NIST e pela OCDE, não visa apenas a conformidade regulatória, mas a criação de um sistema sustentável. A leitura editorial aqui é que a IA, quando desprovida de transparência, torna-se um passivo de risco elevado, capaz de gerar litígios e danos reputacionais profundos em um mercado cada vez mais atento à responsabilidade algorítmica.

Equidade como pilar de gestão

O desafio da equidade reside na natureza dos dados utilizados no treinamento dos modelos. Como acervos corporativos frequentemente refletem desigualdades históricas, a ausência de mecanismos de mitigação de vieses resulta na automatização e amplificação de preconceitos. Organizações como a UNESCO e a Comissão Europeia, por meio do seu AI Act, têm sinalizado que a proporcionalidade regulatória é a via para garantir que a tecnologia não exclua grupos sociais específicos.

Vale notar que, para o setor privado, a equidade é uma questão de gestão de risco. Um algoritmo que discrimina perfis socioeconômicos não apenas falha do ponto de vista ético, mas expõe a empresa a sanções de autoridades de proteção de dados. A mitigação sistemática de vieses, portanto, deve ser tratada como um requisito de engenharia e não apenas como uma pauta de relações públicas.

O desafio da explicabilidade

O fenômeno das "caixas-pretas" nos modelos de larga escala impõe uma barreira intransponível em setores regulados. A exigência de que decisões automatizadas sejam compreensíveis e auditáveis é central para a credibilidade corporativa. Conforme aponta a literatura especializada, trazer luz ao funcionamento desses sistemas é o passo fundamental para garantir que stakeholders e órgãos reguladores possam auditar as ações da empresa.

Essa necessidade de rastreabilidade técnica não implica, necessariamente, na exposição de propriedade intelectual, mas na documentação adequada dos processos de decisão. No Brasil, a atuação do Banco Central e da ANPD reforça que a opacidade é insustentável. Decisões que afetam direitos fundamentais precisam de uma trilha de auditoria clara para evitar a desconfiança do mercado.

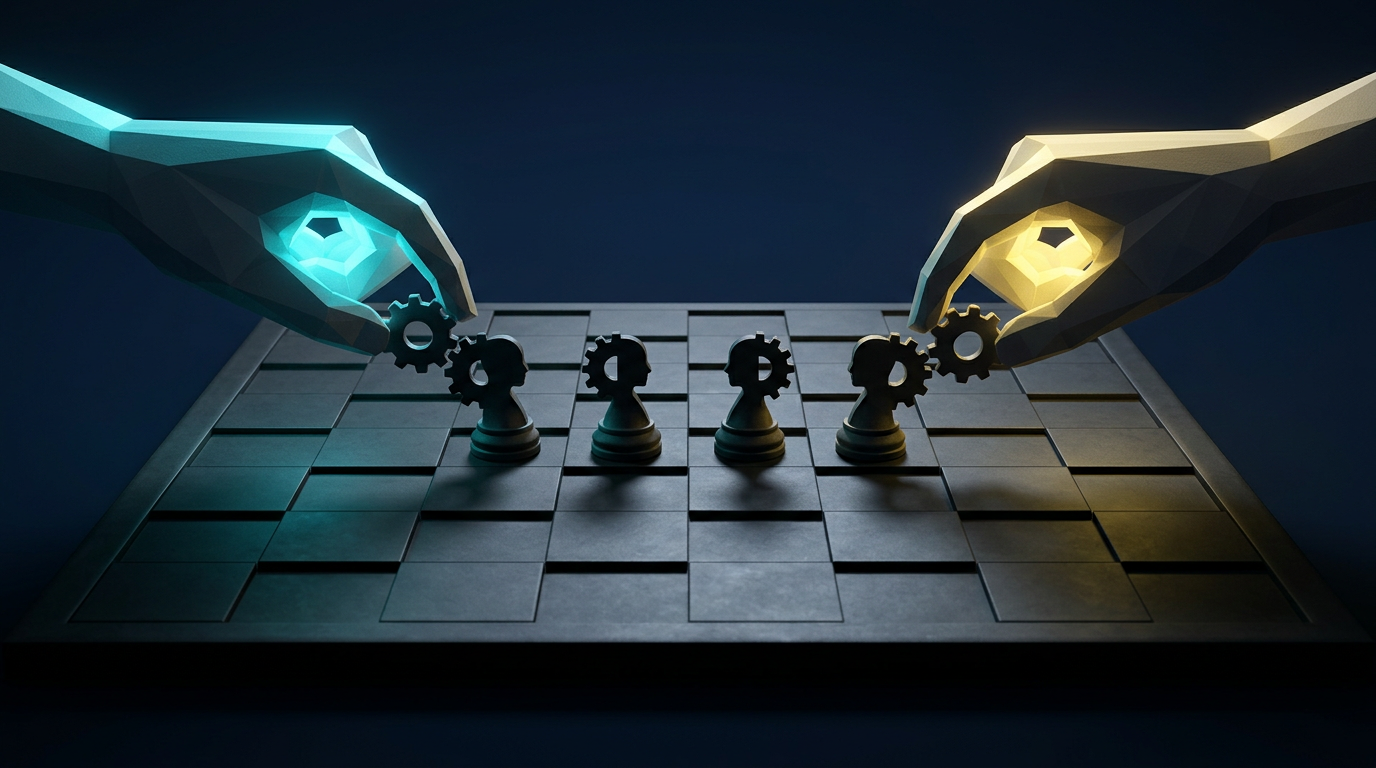

Implicações para o ecossistema

As implicações dessa mudança de paradigma são sentidas por todos os stakeholders, desde desenvolvedores até o consumidor final. Para as empresas, a pressão por transparência força uma revisão na estrutura de custos de implementação, que agora deve incluir camadas de auditoria e monitoramento contínuo. A concorrência, por sua vez, tende a se polarizar entre aquelas organizações que conseguem provar a robustez de seus sistemas e as que operam sob o risco de falhas éticas.

Para o mercado brasileiro, o desafio é equilibrar a adoção acelerada de novas ferramentas com a complexidade do arcabouço regulatório local. A exigência por sistemas auditáveis pode, inclusive, servir como um diferencial competitivo, posicionando empresas que investem em IA responsável como parceiros mais seguros e confiáveis para o ecossistema de negócios.

Perspectivas futuras

O que permanece incerto é a velocidade com que as empresas conseguirão adaptar seus legados técnicos a essas novas demandas de governança. A transição para uma IA ética exige não apenas tecnologia, mas uma mudança cultural nas lideranças corporativas.

Observar a evolução das normas regulatórias e como as big techs aplicarão seus programas de IA responsável será o termômetro para os próximos anos. A questão central não é se a IA será adotada, mas sob quais condições ela será sustentável a longo prazo.

A construção de confiança como arquitetura sugere um caminho onde a tecnologia e a ética caminham em paralelo, definindo o padrão de qualidade para a próxima década de inovação corporativa. O sucesso das empresas dependerá de sua capacidade de traduzir princípios abstratos em processos concretos de governança. Com reportagem de Canaltech

Source · Canaltech