A onipresença dos modelos de linguagem transformou a maneira como interagimos com a tecnologia, mas esconde uma assimetria técnica significativa. Embora plataformas como o ChatGPT, da OpenAI, apresentem interfaces multilingues fluidas, a estrutura subjacente dessas ferramentas é profundamente ancorada no inglês. Segundo reportagem do La Nación, cerca de 95% dos dados utilizados no treinamento de modelos de fronteira, como as versões mais recentes do GPT e do Claude, foram processados originalmente nessa língua. Esse viés de dados, somado à forma como os tokenizadores são construídos, impõe uma barreira de eficiência para usuários que operam em outros idiomas.

A economia invisível dos tokens

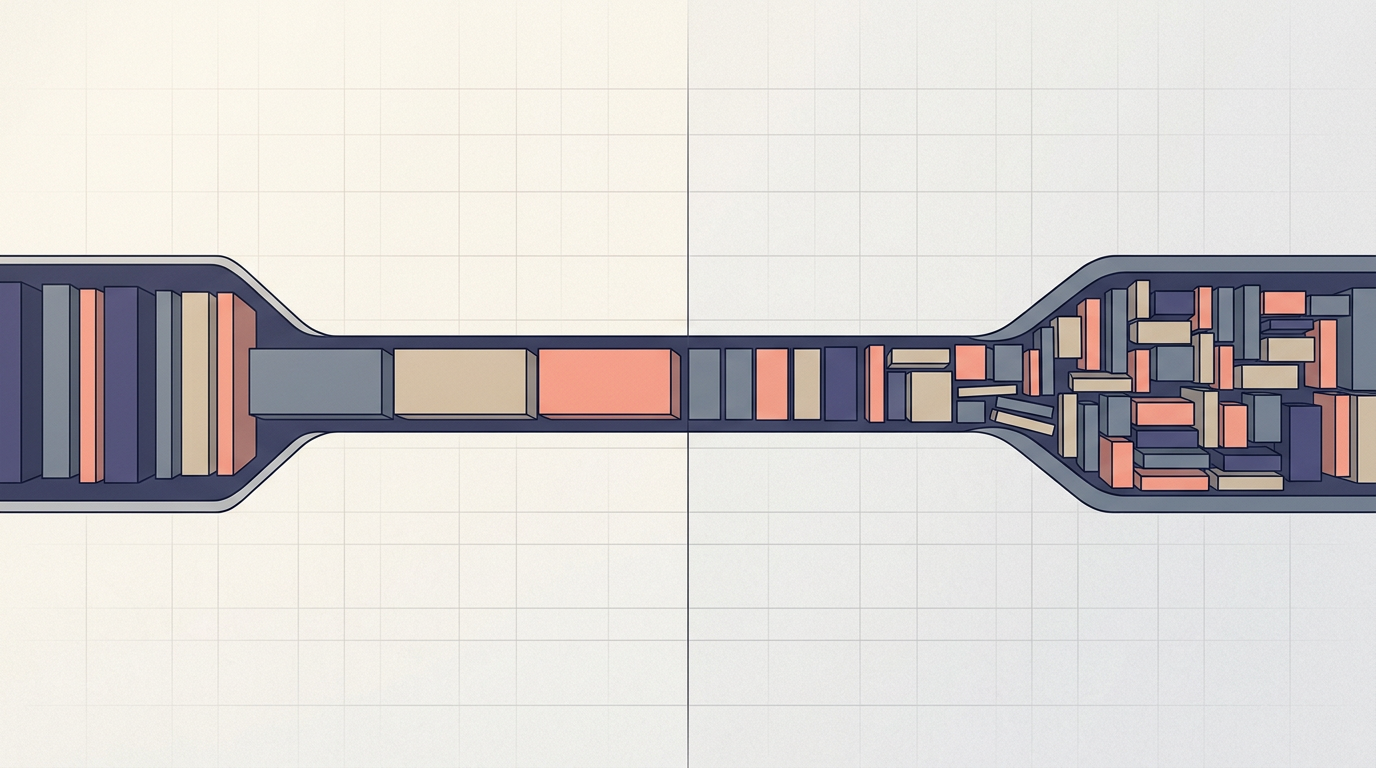

A discrepância no consumo de tokens é um fator determinante para quem busca extrair o máximo das ferramentas de IA. A tokenização funciona de forma distinta para cada idioma porque o vocabulário dos tokenizadores costuma ser otimizado para padrões frequentes no inglês. Assim, palavras simples em inglês podem representar um único token, enquanto termos equivalentes em português ou outras línguas podem ser fragmentados em várias unidades. Por exemplo, em muitos tokenizadores modernos, o termo "desarrollador" (espanhol) pode custar até três tokens, enquanto sua tradução "developer" (inglês) frequentemente consome apenas um. Esse fenômeno não é apenas uma curiosidade linguística, mas um gargalo operacional que impacta diretamente a capacidade de processamento e o limite de uso das assinaturas mensais.

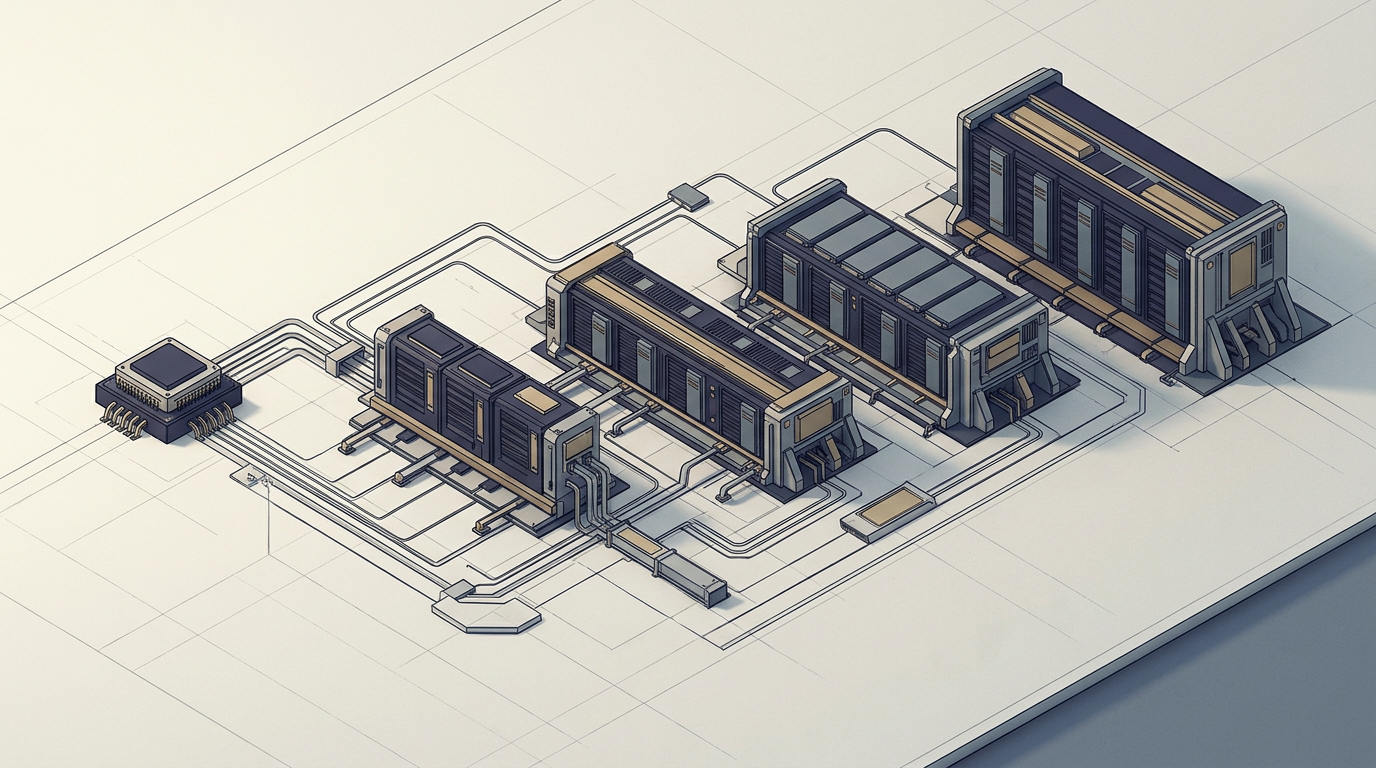

Mecanismos de inferência e performance

O custo computacional aumenta conforme a quantidade de tokens e a forma como o tokenizador do modelo foi desenhado. Enquanto o espanhol tende a apresentar uma eficiência relativa próxima ao inglês, idiomas como o árabe podem ter um custo de processamento substancialmente maior — segundo medições citadas pela reportagem, em modelos como o Claude Opus esse diferencial pode chegar a 76%. A leitura aqui é que a eficiência da inferência está ligada à proximidade do prompt com o corpus original de treinamento do modelo. Além da economia de tokens, diversos estudos, incluindo pesquisas da Microsoft, sugerem que o uso do inglês tende a produzir resultados superiores em tarefas de programação e lógica complexa, onde a precisão é fundamental.

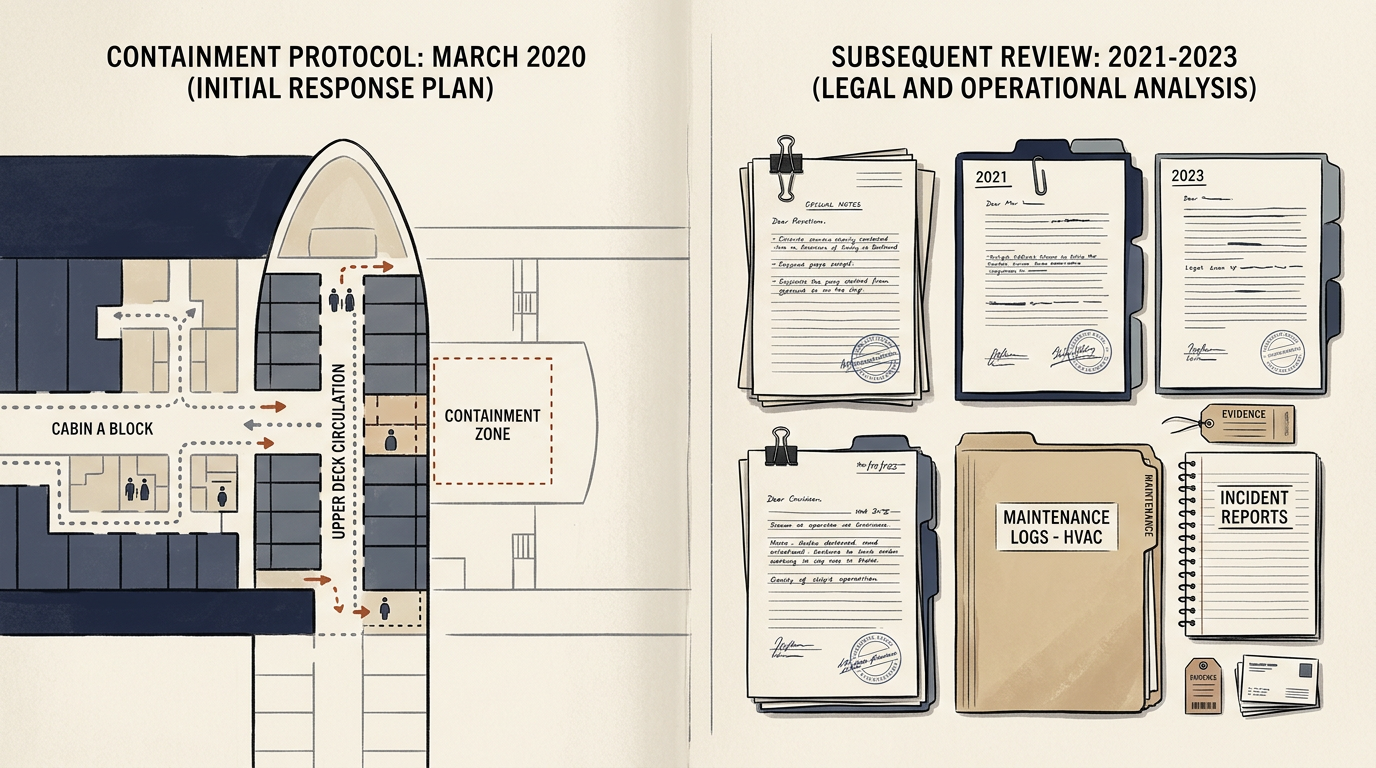

Implicações para o ecossistema global

Essa desigualdade linguística cria um desafio claro para desenvolvedores e empresas em mercados não anglófonos. Embora a "pseudotarifa plana" das assinaturas mensais oculte o custo marginal do token para o usuário comum, para aplicações em escala industrial a ineficiência linguística pode se traduzir em custos de API significativamente maiores. O mercado precisa considerar que a otimização de custos em projetos de IA passa, inevitavelmente, pela estratégia de prompting. Para reguladores e desenvolvedores, o cenário levanta questões sobre a soberania tecnológica e a necessidade de modelos mais equitativos em termos de processamento multilingue.

O futuro da otimização multilingue

O que permanece incerto é se a evolução dos modelos de linguagem buscará uma paridade de tokenização ou se o inglês permanecerá como a "língua franca" da computação de alto desempenho. A tendência é que, à medida que a demanda por IA cresce, a eficiência na inferência se torne um diferencial competitivo para empresas que dependem de grandes volumes de dados. Observar como os próximos lançamentos de modelos tratarão a tokenização de idiomas menos representados no treinamento inicial será crucial para entender a democratização real do acesso a essas tecnologias.

Com reportagem de La Nación

Source · La Nación — Tecnología